BLOG

Pamięć dla lokalnych modeli LLM: ile pamięci RAM potrzebujesz? (i kiedy liczy się szybkość)

Ostatnia aktualizacja:

Uruchomienie dużego modelu językowego na własnym sprzęcie to obecnie jedno z najbardziej praktycznych zastosowań sztucznej inteligencji. Niezależnie od tego, czy eksperymentujesz z asystentami programistycznymi, tworzysz prywatnego chatbota, czy po prostu interesuje Cię, do czego zdolne są modele open source, natychmiast nasuwa się jedno pytanie: ile pamięci faktycznie potrzebuję?

Odpowiedź zależy od modelu, który chcesz uruchomić, od tego, w jaki sposób zamierzasz to zrobić, oraz od tego, czy ważniejsze jest dla Ciebie dopasowanie modelu, czy też uzyskanie szybkich i płynnych wyników. Pojemność pamięci pozwala Ci w ogóle rozpocząć pracę. Szybkość pamięci decyduje o tym, jak płynnie będzie przebiegać praca, gdy już się w nią zaangażujesz.

Dlaczego pamięć stanowi wąskie gardło

Podczas lokalnego uruchamiania dużego modelu językowego cały model musi znajdować się w pamięci w trakcie generowania tekstu. W przeciwieństwie do gier lub edycji wideo, gdzie dane są w razie potrzeby pobierane do pamięci i z niej usuwane, podczas wnioskowania w modelu LLM ładowany jest pełny zestaw wag modelu i pozostaje on w pamięci. Każdy token generowany przez model wymaga przetworzenia przez te wagi.

To sprawia, że pojemność pamięci stanowi główny ogranicznik. Jeśli nie masz wystarczającej ilości pamięci RAM lub VRAM, by pomieścić model, albo nie będziesz w stanie go w ogóle uruchomić, albo część modelu zostanie przeniesiona do wolniejszej pamięci, co drastycznie obniży wydajność. W niektórych przypadkach mówimy tu o spowolnieniu od 5 do 30 razy.

Jednak pojemność to tylko połowa sukcesu. Gdy model zmieści się w pamięci, to szybkość, z jaką system może przekazywać te wagi do procesora, staje się głównym czynnikiem ograniczającym tempo generowania tokenów. To właśnie przepustowość pamięci – i właśnie dlatego szybkość oraz konfiguracja pamięci RAM mają większe znaczenie dla lokalnej sztucznej inteligencji niż w przypadku niemal każdego innego obciążenia na komputerach stacjonarnych.

Pamięć RAM a pamięć VRAM: która z nich ma większe znaczenie?

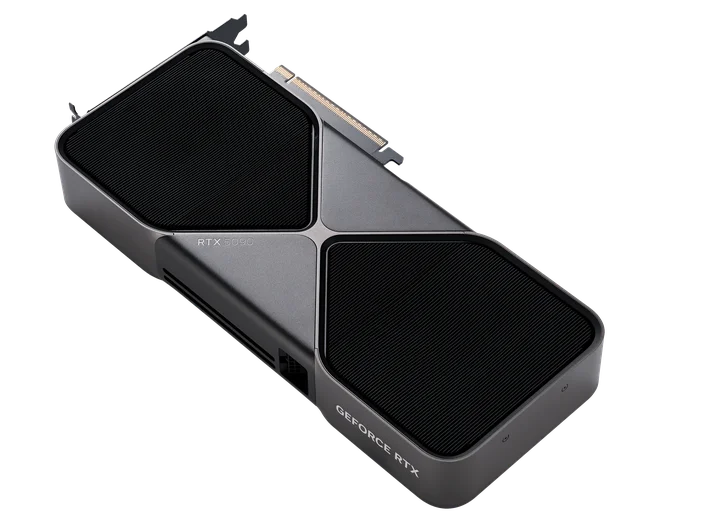

Jeśli dysponujesz dedykowanym procesorem graficznym z wystarczającą ilością pamięci VRAM, jest to najszybsze rozwiązanie. Pamięć procesora graficznego (VRAM) charakteryzuje się znacznie większą przepustowością niż pamięć RAM systemu – nowoczesny procesor graficzny, taki jak RTX 4090 lub RTX 5090, może zapewnić przepustowość pamięci przekraczającą 1 TB/s, podczas gdy nawet najszybsza pamięć RAM DDR5 osiąga maksymalnie około 90 GB/s w typowej konfiguracji dwukanałowej komputera stacjonarnego.

To właśnie ta różnica w przepustowości sprawia, że model, który w całości mieści się w pamięci VRAM, może generować 40 lub więcej tokenów na sekundę, podczas gdy ten sam model uruchomiony z pamięci RAM systemu może osiągnąć wydajność od 8 do 15 tokenów na sekundę nawet na szybkiej konfiguracji procesora. Oba rozwiązania są użyteczne, ale różnica w szybkości reakcji jest zauważalna.

Problem polega na tym, że konsumenckie procesory graficzne mają maksymalnie 24 GB pamięci VRAM (w kartach takich jak RTX 4090 i RTX 5090), co ogranicza możliwości do modeli o około 14 miliardach parametrów przy dobrej jakości lub do około 32 miliardów przy agresywnej kwantyzacji. Jeśli chcesz uruchamiać większe modele, o 70 mld parametrów i więcej, prawdopodobnie będziesz musiał polegać na pamięci RAM systemu, używać wielu kart graficznych lub pogodzić się z pewnym spadkiem wydajności przy częściowym odciążaniu.

Ile pamięci RAM potrzebujesz? Praktyczne zestawienie

W tym miejscu sprawy stają się bardziej konkretne. Ilość pamięci wymaganej przez model zależy od liczby jego parametrów oraz precyzji (poziomu kwantyzacji), z jaką jest uruchamiany. Ogólna zasada brzmi: przy kwantyzacji Q4 (4 bity) należy liczyć się z zapotrzebowaniem rzędu około 0,5–0,6 GB na miliard parametrów, plus dodatkowe zasoby na kontekst i system operacyjny.

8 GB: Poziom podstawowy

Dzięki 8 GB pamięci systemowej (lub VRAM) można bez problemu uruchamiać niewielkie modele o liczbie parametrów od 1 mld do 7 mld przy użyciu kwantyzacji 4-bitowej. Obejmuje to takie modele jak Llama 3.2 3B, Phi-4 Mini, Qwen 3 4B oraz Mistral 7B (przy Q4). Są one zaskakująco wydajne w zadaniach takich jak streszczanie, proste generowanie kodu oraz konwersacyjne pytania i odpowiedzi.

Na przyzwoitej karcie graficznej można spodziewać się około 40–50 tokenów na sekundę, a na procesorze – 15–20 tokenów na sekundę. To w zupełności wystarcza do interakcji typu czat.

16 GB: idealny wybór dla większości osób

16 GB otwiera drogę do modeli 7B i 8B przy wyższym stopniu kwantyzacji (Q8 dla lepszej jakości) oraz do modeli 13B i 14B przy Q4. Właśnie w tym zakresie modele takie jak Llama 3.1 8B, Qwen 3 8B i DeepSeek-R1-Distill 14B stają się praktyczne. Zyskujesz również wystarczającą rezerwę mocy, aby uruchamiać system operacyjny i inne aplikacje równolegle z modelem, bez ryzyka, że wszystko się zawiesi.

Dla większości osób zajmujących się lokalną sztuczną inteligencją 16 GB pamięci DDR5 to realistyczny punkt wyjścia. Pozwoli to uzyskać dobre wyniki przy korzystaniu z najpopularniejszych modeli open source i uniknąć ciągłych ograniczeń pamięciowych.

32 GB: Zaawansowana lokalna sztuczna inteligencja

Przy 32 GB można już bez problemu uruchamiać modele o 32 miliardach parametrów oraz modele o 70 miliardach parametrów z intensywną kwantyzacją (Q2 lub Q3). Modele takie jak Qwen 3 32B, DeepSeek-R1-Distill 32B i Gemma 3 27B dobrze się tu sprawdzają. Modele te oferują zauważalnie lepsze wnioskowanie, dłuższe spójne wyniki oraz lepszą wydajność w złożonych zadaniach w porównaniu z ich mniejszymi odpowiednikami.

Jeśli korzystasz z lokalnych modeli LLM do prac programistycznych, pomocy w pisaniu lub innych zadań, w których liczy się jakość wyników, to dopiero przy 32 GB zaczynasz odczuwać prawdziwą płynność działania. Zestaw taki jak CORSAIR VENGEANCE DDR5 64 GB (2x32 GB) o częstotliwości 6000 MT/s zapewnia pojemność i przepustowość niezbędne do obsługi tych obciążeń bez żadnych kompromisów.

64 GB i więcej: uruchamianie dużych modeli

Jeśli chcesz uruchamiać modele o rozmiarze 70 miliardów parametrów przy rozsądnych poziomach kwantyzacji (Q4 lub Q5), będziesz potrzebować 64 GB pamięci RAM oraz, w idealnym przypadku, konfiguracji z wieloma procesorami graficznymi (GPU) lub systemu obsługującego częściowe odciążanie procesorów graficznych. Model Llama 3.3 70B przy poziomie Q4 wymaga około 42 GB pamięci tylko na same wagi modelu, nie uwzględniając jeszcze okna kontekstowego i obciążenia systemu operacyjnego.

Na tym poziomie przepustowość pamięci nabiera jeszcze większego znaczenia. Każde wygenerowanie tokenu wymaga przetworzenia dziesiątek gigabajtów wag, a szybsza pamięć RAM bezpośrednio przekłada się na szybsze wyniki. Jest to konfiguracja klasy stacji roboczej, ale staje się coraz bardziej powszechna wśród profesjonalistów, którzy chcą przechowywać poufne dane na urządzeniu podczas pracy z otwartymi modelami klasy Frontier.

Dlaczego liczy się szybkość pamięci RAM, a nie tylko jej pojemność

Oto coś, co zaskakuje wiele osób: w przypadku lokalnego wnioskowania w modelu LLM przepustowość pamięci jest często ważniejsza niż sama moc obliczeniowa. Po wygenerowaniu pierwszego tokenu (co jest operacją obciążającą procesor) każdy kolejny token jest operacją obciążającą pamięć. Model musi przesyłać strumieniowo cały zestaw wag przez procesor dla każdego tokenu, a szybkość tego przesyłania zależy od przepustowości pamięci.

Testy porównawcze w rzeczywistych warunkach wyraźnie pokazują tę różnicę. Wykazano, że przejście z pamięci DDR5-4800 na DDR5-6000 zwiększa szybkość generowania tokenów o 20–23 procent w przypadku modeli takich jak Mistral 7B i Llama 3.1 8B działających na procesorze. To znacząca i zauważalna poprawa szybkości działania, wynikająca wyłącznie z zastosowania szybszej pamięci.

Ogromne znaczenie mają również konfiguracje dwukanałowe. Użycie dwóch modułów pamięci RAM w trybie dwukanałowym skutecznie podwaja dostępną przepustowość w porównaniu z jednym modułem. W praktyce może to oznaczać przyspieszenie przetwarzania o 30–50 procent. Jeśli budujesz lub modernizujesz system do lokalnej sztucznej inteligencji, zawsze stosuj dwa moduły w trybie dwukanałowym, nigdy pojedynczy moduł DIMM.

Kwantyzacja: jak zmieścić większe modele w mniejszej ilości pamięci

Kwantyzacja to technika, dzięki której lokalne modele LLM mogą być z powodzeniem stosowane na sprzęcie przeznaczonym dla użytkowników indywidualnych. Polega ona na kompresji wag modelu z pierwotnego formatu 16-bitowego zmiennoprzecinkowego (FP16) do mniejszych formatów, zazwyczaj 4-bitowego (Q4), 5-bitowego (Q5) lub 8-bitowego (Q8). Kompromisem jest niewielki spadek jakości wyników w zamian za znaczne zmniejszenie zapotrzebowania na pamięć.

W przypadku kwantyzacji Q4_K_M (najpopularniejszego formatu do użytku lokalnego) rozmiar modelu 8B zmniejsza się z około 16 GB do około 5–6 GB. Model 70B zmniejsza się ze 140 GB do około 40–42 GB. Oznacza to zmniejszenie zapotrzebowania na pamięć o 75 procent, a w większości praktycznych zastosowań różnica w jakości jest ledwo zauważalna.

Q5_K_M zapewnia nieco lepszą jakość przy około 15–20-procentowym wzroście zużycia pamięci i warto go rozważyć, jeśli dysponujesz odpowiednim zapasem pamięci. Q8 zachowuje niemal całą jakość oryginalnego modelu, ale zmniejsza zapotrzebowanie na pamięć jedynie o połowę; jest to najlepszy wybór, gdy dysponujesz dużą ilością pamięci i zależy Ci na jak najlepszym efekcie końcowym.

Narzędzia takie jak Ollama i LM Studio obsługują modele kwantyzowane w sposób natywny, więc nie musisz samodzielnie dokonywać żadnej konwersji. Wystarczy wybrać poziom kwantyzacji dostosowany do ilości dostępnej pamięci.

Długość kontekstu: ukryty koszt pamięci

Każdy element kontekstu (tekst przesłany do modelu oraz tekst przez niego wygenerowany) wymaga dodatkowej pamięci, niezależnie od samej pamięci potrzebnej na wagi modelu. Krótkie rozmowy nie stanowią problemu, ale w przypadku wprowadzania długich dokumentów lub przechowywania rozbudowanych historii czatów zapotrzebowanie na pamięć kontekstową może szybko wzrosnąć.

Orientacyjnie można przyjąć, że 8 tys. tokenów kontekstu zajmuje około 1 GB na każde 10 mld parametrów. Jeśli zwiększymy tę liczbę do 32 tys. tokenów, potrzeba dodatkowych 4 GB. Niektóre nowsze modele obsługują 128 tys. tokenów lub więcej, co w praktyce może podwoić całkowite zapotrzebowanie na pamięć.

Jeśli planujesz regularnie korzystać z długich kontekstów, na przykład wprowadzając do modelu całe bazy kodu lub obszerne dokumenty, należy zaplanować dodatkową pamięć, wykraczającą poza ilość wymaganą wyłącznie przez wagi modelu. Jest to kolejny powód, dla którego konfiguracje o pojemności 32 GB lub 64 GB są uzasadnione w przypadku poważnych zastosowań lokalnej sztucznej inteligencji.

Popularne modele i ich wymagania

Poniżej znajduje się krótkie zestawienie najczęściej stosowanych obecnie modeli lokalnych wraz z przybliżonymi wymaganiami pamięciowymi przy kwantyzacji Q4_K_M:

- Phi-4 Mini (3,8 GHz): ~2,3 GB, działa świetnie na niemal każdym sprzęcie

- Qwen 3.5 4B: ~3,4 GB, doskonały do prostych zadań wymagających zaawansowanego wnioskowania

- Llama 3.2 8B: ~5 GB, niezawodny, uniwersalny model o niewielkich rozmiarach

- Qwen 3 8B: ~5 GB, wysoka wydajność w zakresie przetwarzania wielojęzycznego i wnioskowania

- Qwen 3.5 9B: ~6,6 GB, najnowszy mały model o ulepszonych możliwościach

- DeepSeek-R1-Distill 14B: ~9 GB, doskonała zdolność wnioskowania przy niewielkich rozmiarach

- Gemma 3 12B: ~8 GB, wydajny model średniej klasy od Google

- Llama 4 Scout (109B MoE, 17B aktywnych): ~10 GB przy agresywnej kwantyzacji, najnowsza wersja Meta, działa zaskakująco dobrze dzięki architekturze MoE

- Qwen 3.5 27B: ~17 GB, wszechstronna karta graficzna, która mieści się w 24 GB pamięci VRAM

- Qwen 3 32B: ~20 GB, wysoka wydajność, obsługuje 24 GB pamięci VRAM

- Qwen 3.5 35B-A3B (MoE): ~24 GB, łącznie 35B, ale tylko 3B aktywne na token, bardzo wydajne

- Llama 3.3 70B: ~42 GB, jakość zbliżona do najnowszej wersji, wymaga dużej ilości pamięci RAM

- DeepSeek-R1-Distill 70B: ~42 GB, najwyższej klasy zdolności wnioskowania do użytku lokalnego

- GPT-OSS 120B: ~63 GB, model OpenAI z otwartą strukturą wagową, wymaga co najmniej 64 GB pamięci RAM typu unified lub systemowej

- Qwen 3.5 122B-A10B (MoE): ~81 GB, model flagowy z zaledwie 10 miliardami aktywnych parametrów

Podane wartości dotyczą wyłącznie wag modeli przy kwantyzacji Q4_K_M. Należy doliczyć od 2 do 8 GB na dane kontekstowe, obciążenie systemu operacyjnego oraz wszelkie inne aplikacje uruchomione równolegle. Modele typu MoE (Mixture of Experts), takie jak Llama 4 Scout i Qwen 3.5 35B-A3B, są szczególnie oszczędne pod względem pamięci podczas wnioskowania, ponieważ w danym momencie aktywny jest jedynie ułamek ich całkowitej liczby parametrów.

Wybór odpowiedniej pamięci dla lokalnej sztucznej inteligencji

Biorąc pod pamięć o wszystkim, co zostało powiedziane powyżej, oto jak należy podejść do kwestii konfiguracji pamięci w przypadku lokalnych modeli LLM:

Jeśli Twoja platforma obsługuje pamięć DDR5, wybierz właśnie tę technologię. Przewaga w zakresie przepustowości w porównaniu z DDR4 jest realna i ma bezpośredni wpływ na szybkość wnioskowania. Pamięć DDR5-6000 lub szybsza stanowi idealny kompromis między ceną, kompatybilnością i wydajnością w przypadku zadań związanych ze sztuczną inteligencją.

Zawsze korzystaj z trybu dwukanałowego. Dwa moduły pamięci RAM znacznie przewyższają wydajnością pojedynczy moduł o tej samej łącznej pojemności w przypadku wnioskowania w modelach LLM. Zestaw 2x16 GB znacznie przewyższa pojedynczy moduł 32 GB pod względem liczby tokenów na sekundę.

Wybierz pojemność pamięci odpowiednią do modeli, które chcesz uruchamiać. Jeśli eksperymentujesz głównie z modelami o rozmiarze od 7B do 8B, wystarczy 16 GB. Jeśli chcesz uruchamiać modele o rozmiarze od 14B do 32B lub zapewnić sobie rezerwę na przyszłe modele, lepszym wyborem będzie 32 GB. A jeśli planujesz korzystać z modeli o rozmiarze 70B, zaplanuj 64 GB.

Jeśli szukasz systemu, który dobrze radzi sobie z obecnymi lokalnymi modelami AI i pozostawia pole do rozwoju, trudno o lepszy zestaw niż CORSAIR VENGEANCE DDR5 64 GB (2x32 GB) o częstotliwości 6000 MT/s lub 6400 MT/s. Otrzymujesz pojemność wystarczającą dla dużych modeli, przepustowość zapewniającą szybkie wnioskowanie oraz konfigurację dwukanałową, która sprawia, że wszystko działa wydajnie. Jeśli budujesz bardziej kompaktową konfigurację skoncentrowaną na mniejszych modelach, zestaw 32 GB (2x16 GB) DDR5-6000 stanowi solidny i opłacalny punkt wyjścia.

Stworzona specjalnie z myślą o lokalnej sztucznej inteligencji: CORSAIR AI WORKSTATION 300

Jeśli poważnie myślisz o lokalnym uruchamianiu dużych modeli i nie chcesz budować komputera typu tower z wieloma kartami graficznymi, CORSAIR AI WORKSTATION 300 oferuje inne rozwiązanie. Została zbudowana w oparciu o procesor AMD Ryzen AI MAX+ 395 z zintegrowanym procesorem graficznym Radeon 8060S, który może uzyskać dostęp do maksymalnie 96 GB pamięci VRAM z 128 GB pamięci LPDDR5X-8000 systemu. To właśnie ta pojemność sprawia, że jest to interesujące rozwiązanie dla lokalnej sztucznej inteligencji: pojedynczy dyskretny procesor graficzny klasy konsumenckiej ma obecnie maksymalnie 32 GB pamięci VRAM, więc załadowanie czegoś takiego jak GPT-OSS 120B (około 63 GB przy MXFP4) na jedną kartę nie jest możliwe bez podzielenia modelu na wiele procesorów graficznych lub przeniesienia go do pamięci RAM systemu.

Kluczowym kompromisem jest architektura pamięci zunifikowanej. Rezygnujesz z surowej przepustowości dedykowanej pamięci VRAM GDDR7, ale w zamian zyskujesz do 96 GB pamięci dostępnej dla procesora graficznego z prędkością LPDDR5X. Oznacza to, że modele w zakresie parametrów od 70B do 120B, które w innym przypadku wymagałyby wielu oddzielnych procesorów graficznych lub znacznego odciążenia procesora centralnego, mogą działać całkowicie na ścieżce pamięci procesora graficznego na jednej maszynie, bez dzielenia warstw między kartami lub stronicowania wag przez PCIe.

System wyposażony jest również w procesor NPU AMD XDNA 2 o wydajności 50 TOPS, przeznaczony do prostszych zadań związanych ze sztuczną inteligencją, a także w port Ethernet 2,5 Gb/s, Wi-Fi 6E oraz kilka portów USB 4.0. Dla profesjonalistów zajmujących się danymi wrażliwymi – z branży prawniczej, medycznej czy finansowej – posiadanie takiego poziomu możliwości w zakresie sztucznej inteligencji w trybie całkowicie offline i w siedzibie firmy stanowi istotną praktyczną zaletę.

Pakiet oprogramowania CORSAIR AI

Prawidłowa instalacja i konfiguracja lokalnych narzędzi AI może być jednym z najbardziej frustrujących elementów tego procesu – konflikty zależności, wersje sterowników, kompatybilność środowisk programistycznych. Pakiet oprogramowania CORSAIR AI Software Stack to narzędzie z przewodnikiem, które ma na celu wyeliminowanie tych utrudnień. Pomaga ono wybrać i zainstalować odpowiednie narzędzia dla danego systemu – od środowisk AI i uczenia maszynowego po środowiska programistyczne i oprogramowanie kreatywne – a wszystko to dostosowane do posiadanego sprzętu.

JOIN OUR OFFICIAL CORSAIR COMMUNITIES

Join our official CORSAIR Communities! Whether you're new or old to PC Building, have questions about our products, or want to chat about the latest PC, tech, and gaming trends, our community is the place for you.