BLOG

Memória para LLMs locais: de quanta RAM precisa? (e quando a velocidade é importante)

Última atualização:

Executar um modelo de linguagem de grande dimensão no seu próprio hardware é uma das coisas mais práticas que pode fazer com a IA neste momento. Quer esteja a experimentar assistentes de programação, a criar um chatbot privado ou simplesmente curioso sobre o que os modelos de código aberto são capazes de fazer, há uma questão que surge imediatamente: de quanta memória preciso realmente?

A resposta depende do modelo que pretende executar, da forma como planeia fazê-lo e se o que mais lhe interessa é ajustar o modelo ou obter resultados rápidos e ágeis. A capacidade de memória permite-lhe entrar. A velocidade da memória determina a qualidade da experiência uma vez lá dentro.

Por que razão a memória é o ponto de estrangulamento

Quando se executa um modelo de linguagem de grande dimensão localmente, todo o modelo tem de permanecer na memória enquanto gera texto. Ao contrário dos jogos ou da edição de vídeo, em que os dados entram e saem da memória conforme necessário, a inferência de LLM carrega o conjunto completo de pesos do modelo e mantém-nos residentes. Cada token que o modelo gera requer uma passagem por esses pesos.

Isso faz com que a capacidade de memória seja o principal obstáculo. Se não tiver RAM ou VRAM suficiente para armazenar o modelo, ou não o consegue executar de todo, ou acaba por ter parte do modelo a ser transferida para um armazenamento mais lento, o que prejudica drasticamente o desempenho. Estamos a falar de uma redução de 5 a 30 vezes em alguns casos.

Mas a capacidade é apenas metade da história. Assim que o modelo cabe na memória, a velocidade a que o sistema consegue enviar esses pesos para o processador torna-se o principal fator limitante da rapidez com que os tokens são gerados. É isso que se chama largura de banda da memória, e é por isso que a velocidade e a configuração da RAM são mais importantes para a IA local do que para praticamente qualquer outra tarefa executada num computador de secretária.

RAM vs VRAM: Qual é que importa?

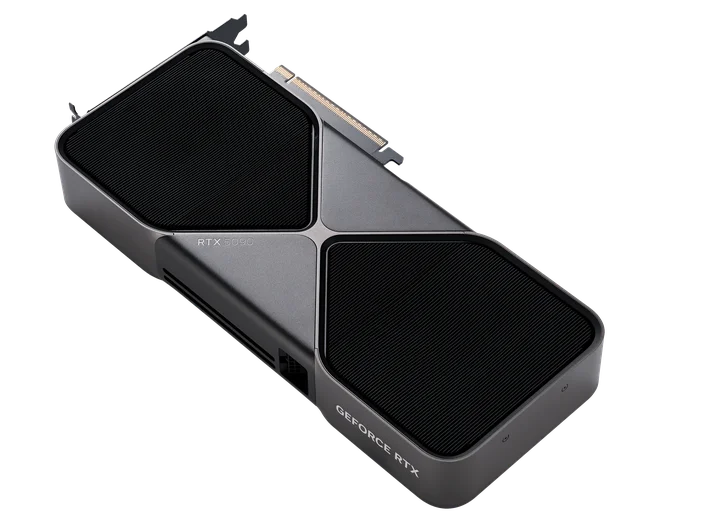

Se tiver uma GPU dedicada com VRAM suficiente, essa é a opção mais rápida. A memória da GPU (VRAM) tem uma largura de banda muito superior à da RAM do sistema; uma GPU moderna, como uma RTX 4090 ou RTX 5090, pode oferecer mais de 1 TB/s de largura de banda de memória, enquanto mesmo a RAM DDR5 mais rápida do sistema atinge um máximo de cerca de 90 GB/s numa configuração típica de computador de secretária de canal duplo.

Essa diferença de largura de banda é a razão pela qual um modelo que cabe inteiramente na VRAM consegue gerar 40 ou mais tokens por segundo, enquanto o mesmo modelo, quando executado a partir da memória RAM do sistema, pode atingir apenas 8 a 15 tokens por segundo numa configuração com CPU rápida. Ambos são utilizáveis, mas a diferença na capacidade de resposta é notória.

O problema é que as GPUs de consumo atingem um limite máximo de 24 GB de VRAM (em placas como a RTX 4090 e a RTX 5090), o que limita a execução a modelos com cerca de 14 mil milhões de parâmetros com boa qualidade, ou até cerca de 32 mil milhões com quantização agressiva. Se pretender executar modelos maiores, com 70 mil milhões de parâmetros ou mais, provavelmente terá de recorrer à RAM do sistema, utilizar várias GPUs ou aceitar algum compromisso de desempenho com o descarregamento parcial.

De quanta memória RAM precisa? Uma análise prática

É aqui que as coisas se tornam mais concretas. A quantidade de memória necessária para um modelo depende do número de parâmetros e da precisão (nível de quantização) com que o executa. Uma regra geral: com quantização Q4 (4 bits), pode contar com uma necessidade de cerca de 0,5 a 0,6 GB por mil milhões de parâmetros, além da sobrecarga para o contexto e o sistema operativo.

8 GB: Nível básico

Com 8 GB de memória total do sistema (ou VRAM), é possível executar confortavelmente modelos de pequena dimensão, com um intervalo de parâmetros entre 1B e 7B, utilizando quantização de 4 bits. Isso inclui modelos como o Llama 3.2 3B, o Phi-4 Mini, o Qwen 3 4B e o Mistral 7B (na configuração Q4). Estes modelos são surpreendentemente capazes para tarefas como resumo, geração de código simples e perguntas e respostas conversacionais.

Espere cerca de 40 a 50 tokens por segundo numa GPU decente, ou 15 a 20 tokens por segundo na CPU. É perfeitamente adequado para interações do tipo chat.

16 GB: a quantidade ideal para a maioria das pessoas

16 GB abre caminho para modelos de 7B e 8B com quantização mais elevada (Q8 para melhor qualidade) e modelos de 13B a 14B com Q4. É aqui que modelos como o Llama 3.1 8B, o Qwen 3 8B e o DeepSeek-R1-Distill 14B se tornam viáveis. Também obtém margem suficiente para executar o sistema operativo e outras aplicações em simultâneo com o modelo, sem que tudo fique paralisado.

Para a maioria das pessoas que estão a experimentar IA local, 16 GB de DDR5 é o ponto de partida mais realista. Obterá bons resultados com os modelos de código aberto mais populares e não sentirá que está constantemente limitado pela memória.

32 GB: IA local avançada

Com 32 GB, já é possível executar confortavelmente modelos com 32 mil milhões de parâmetros e modelos com 70 mil milhões de parâmetros com quantização intensa (Q2 ou Q3). Modelos como o Qwen 3 32B, o DeepSeek-R1-Distill 32B e o Gemma 3 27B encaixam-se bem aqui. Estes modelos oferecem um raciocínio visivelmente melhor, saídas mais longas e coerentes e um desempenho mais robusto em tarefas complexas, em comparação com os seus equivalentes de menor dimensão.

Se estiver a utilizar LLMs locais para trabalhos de desenvolvimento, assistência na redação ou qualquer outra tarefa em que a qualidade do resultado seja importante, é a partir dos 32 GB que a experiência começa a ser verdadeiramente satisfatória. Um kit como o CORSAIR VENGEANCE DDR5 de 64 GB (2x32 GB) a 6000 MT/s oferece-lhe a capacidade e a largura de banda necessárias para lidar com estas cargas de trabalho sem comprometer o desempenho.

64 GB e mais: Executar os grandes modelos

Se pretender executar modelos com 70 mil milhões de parâmetros a níveis de quantização razoáveis (Q4 ou Q5), necessitará de 64 GB de memória RAM do sistema e, idealmente, de uma configuração com várias GPUs ou de um sistema que suporte a descarga parcial para a GPU. O Llama 3.3 70B a Q4 requer cerca de 42 GB apenas para os pesos do modelo, sem contar com a janela de contexto e a sobrecarga do sistema operativo.

Neste nível, a largura de banda da memória torna-se ainda mais crucial. Cada geração de tokens requer o processamento de dezenas de gigabytes de pesos, e uma RAM mais rápida traduz-se diretamente numa saída mais rápida. Trata-se de uma configuração de nível de estação de trabalho, mas é cada vez mais comum entre profissionais que pretendem manter dados confidenciais no dispositivo enquanto trabalham com modelos abertos de ponta.

Por que a velocidade da RAM é importante, e não apenas a capacidade

Eis algo que surpreende muita gente: na inferência local de modelos LLM, a largura de banda da memória é frequentemente mais importante do que o poder de computação bruto. Após a geração do primeiro token (que é limitada pela computação), todos os tokens subsequentes são limitados pela memória. O modelo precisa de transmitir todo o seu conjunto de pesos através do processador para cada token, e a velocidade dessa transmissão é determinada pela largura de banda da memória.

Os testes de desempenho no mundo real mostram claramente a diferença. Verificou-se que a mudança de DDR5-4800 para DDR5-6000 melhora a velocidade de geração de tokens em 20 a 23 por cento em modelos como o Mistral 7B e o Llama 3.1 8B executados na CPU. Trata-se de uma melhoria significativa e percetível na capacidade de resposta, que se deve exclusivamente a uma memória mais rápida.

As configurações de canal duplo também são extremamente importantes. Utilizar dois módulos de RAM em modo de canal duplo duplica efetivamente a largura de banda disponível em comparação com um único módulo. Na prática, isso pode significar uma inferência 30 a 50 por cento mais rápida. Se estiver a montar ou a atualizar um sistema para IA local, utilize sempre dois módulos em canal duplo, nunca um único DIMM.

Quantização: Como acomodar modelos maiores em menos memória

A quantização é a técnica que torna os LLMs locais viáveis em hardware de consumo. Esta técnica comprime os pesos do modelo, passando do formato original de 16 bits em ponto flutuante (FP16) para representações mais compactas, normalmente de 4 bits (Q4), 5 bits (Q5) ou 8 bits (Q8). A contrapartida é uma ligeira redução na qualidade da saída em troca de uma redução significativa nos requisitos de memória.

Com a quantização Q4_K_M (o formato mais comum para utilização local), um modelo de 8 mil milhões de parâmetros passa de cerca de 16 GB para aproximadamente 5 a 6 GB. Um modelo de 70 mil milhões de parâmetros passa de 140 GB para cerca de 40 a 42 GB. Trata-se de uma redução de 75% na memória e, na maioria dos casos práticos, a diferença de qualidade é praticamente impercetível.

O Q5_K_M oferece uma qualidade ligeiramente superior, com um custo de memória cerca de 15 a 20 por cento superior, e vale a pena considerá-lo se tiver capacidade disponível. O Q8 preserva quase toda a qualidade do modelo original, mas apenas reduz os requisitos de memória para metade; é a escolha ideal quando se dispõe de bastante memória e se pretende obter o melhor resultado possível.

Ferramentas como o Ollama e o LM Studio suportam modelos quantizados de forma nativa, pelo que não é necessário efetuar qualquer conversão manualmente. Basta escolher o nível de quantização adequado à memória disponível.

Comprimento do contexto: o custo oculto da memória

Cada unidade de contexto (o texto que se envia ao modelo mais o texto que este gera) requer memória adicional, para além dos próprios pesos do modelo. As conversas curtas não representam problema, mas se se introduzirem documentos longos ou se mantiverem históricos de chat extensos, a memória de contexto pode aumentar rapidamente.

A título de orientação, 8 mil tokens de contexto acrescentam cerca de 1 GB por cada 10 mil milhões de parâmetros. Se aumentar para 32 mil tokens, terá um acréscimo de 4 GB. Alguns modelos mais recentes suportam 128 mil tokens ou mais, o que pode efetivamente duplicar os requisitos totais de memória.

Se pretender utilizar contextos longos regularmente, por exemplo, ao introduzir bases de código completas ou documentos extensos num modelo, reserve memória adicional para além da necessária apenas para os pesos do modelo. Esta é mais uma razão pela qual as configurações de 32 GB ou 64 GB fazem sentido para uma utilização séria da IA a nível local.

Modelos populares e o que precisam

Aqui está uma referência rápida a alguns dos modelos locais mais utilizados atualmente, indicando a memória aproximada necessária com quantização Q4_K_M:

- Phi-4 Mini (3,8 GHz): ~2,3 GB, funciona muito bem em praticamente qualquer sistema

- Qwen 3.5 4B: ~3,4 GB, excelente para tarefas simples com forte capacidade de raciocínio

- Llama 3.2 8B: ~5 GB, modelo pequeno e fiável para uso geral

- Qwen 3 8B: ~5 GB, excelente desempenho em multilinguismo e raciocínio

- Qwen 3.5 9B: ~6,6 GB, o mais recente modelo pequeno com capacidades melhoradas

- DeepSeek-R1-Distill 14B: ~9 GB, excelente capacidade de raciocínio num formato compacto

- Gemma 3 12B: ~8 GB, a opção eficiente de tamanho médio da Google

- Llama 4 Scout (109B MoE, 17B ativos): ~10 GB com quantização agressiva; a versão mais recente da Meta funciona surpreendentemente bem graças à arquitetura MoE

- Qwen 3.5 27B: ~17 GB, uma placa versátil e potente que cabe em 24 GB de VRAM

- Qwen 3 32B: ~20 GB, grande capacidade, compatível com 24 GB de VRAM

- Qwen 3.5 35B-A3B (MoE): ~24 GB, 35B no total, mas apenas 3B ativos por token, muito eficiente

- Llama 3.3 70B: ~42 GB, qualidade quase de ponta, requer uma quantidade substancial de RAM

- DeepSeek-R1-Distill 70B: ~42 GB, raciocínio de ponta para uso local

- GPT-OSS 120B: ~63 GB, o modelo de peso aberto da OpenAI, requer 64 GB ou mais de RAM unificada ou do sistema

- Qwen 3.5 122B-A10B (MoE): ~81 GB, modelo topo de gama com apenas 10 mil milhões de parâmetros ativos

Estes valores referem-se apenas aos pesos dos modelos com quantização Q4_K_M. Acrescente 2 a 8 GB para o contexto, a sobrecarga do sistema operativo e quaisquer outras aplicações que esteja a executar em simultâneo. Os modelos MoE (Mixture of Experts), como o Llama 4 Scout e o Qwen 3.5 35B-A3B, são especialmente eficientes em termos de memória durante a inferência, uma vez que apenas uma fração dos seus parâmetros totais está ativa por token.

Escolher a memória adequada para a IA local

Tendo em conta tudo o que foi referido acima, eis como deve encarar a configuração da memória para os LLMs locais:

Opte pela DDR5 se a sua plataforma for compatível. A vantagem em termos de largura de banda em relação à DDR4 é real e tem um impacto direto na velocidade de inferência. A DDR5-6000 ou superior atinge o equilíbrio ideal entre preço, compatibilidade e desempenho para cargas de trabalho de IA.

Utilize sempre a configuração de canal duplo. Duas memórias RAM oferecem um desempenho significativamente superior ao de uma única memória com a mesma capacidade total para a inferência de LLM. Um kit de 2x16 GB supera largamente uma única memória de 32 GB em termos de tokens por segundo.

Escolha a capacidade de memória adequada aos modelos que pretende utilizar. Se estiver principalmente a experimentar modelos de 7 a 8 mil milhões de parâmetros, 16 GB são suficientes. Se pretender utilizar modelos de 14 a 32 mil milhões de parâmetros ou reservar margem para modelos futuros, 32 GB é a melhor opção. E se estiver a pensar em modelos de 70 mil milhões de parâmetros, opte por 64 GB.

Para um sistema que lida bem com os atuais modelos de IA locais e deixa margem para crescimento, um kit como o CORSAIR VENGEANCE DDR5 de 64 GB (2x32 GB) a 6000 MT/s ou 6400 MT/s é difícil de superar. Obtém-se a capacidade para modelos de grande dimensão, a largura de banda para uma inferência rápida e a configuração de canal duplo que faz com que tudo funcione de forma eficiente. Se estiver a montar uma configuração mais compacta focada em modelos mais pequenos, um kit DDR5-6000 de 32 GB (2x16 GB) é um ponto de partida sólido e económico.

Concebida especificamente para IA local: a CORSAIR AI WORKSTATION 300

Se pretende realmente executar modelos de grande dimensão localmente e não quer montar uma torre com várias GPUs, a CORSAIR AI WORKSTATION 300 apresenta uma abordagem diferente. É construída em torno do processador AMD Ryzen AI MAX+ 395 com uma GPU integrada Radeon 8060S que pode aceder a até 96 GB de VRAM a partir dos 128 GB de memória LPDDR5X-8000 do sistema. É essa capacidade que a torna interessante para IA local: atualmente, uma única GPU discreta de consumo atinge um máximo de 32 GB de VRAM, pelo que carregar algo como o GPT-OSS 120B (cerca de 63 GB em MXFP4) numa única placa não é possível sem dividir o modelo por várias GPUs ou descarregá-lo para a RAM do sistema.

A arquitetura de memória unificada é o principal compromisso. Renuncia-se à largura de banda bruta da VRAM GDDR7 dedicada, mas, em troca, obtêm-se até 96 GB de memória acessível pela GPU a velocidades LPDDR5X. Isso significa que modelos na gama de parâmetros de 70B a 120B, que de outra forma exigiriam múltiplas GPUs discretas ou um descarregamento intensivo da CPU, podem ser executados inteiramente no caminho de memória da GPU numa única máquina, sem dividir camadas entre placas ou paginar pesos através de PCIe.

O sistema inclui também a NPU XDNA 2 da AMD, com 50 TOPS de aceleração de IA para tarefas mais simples, Ethernet de 2,5 Gbps, Wi-Fi 6E e várias portas USB 4.0. Para profissionais que trabalham com dados confidenciais — sejam eles da área jurídica, médica ou financeira —, dispor deste nível de capacidade de IA totalmente offline e no local constitui uma vantagem prática significativa.

A suíte de software CORSAIR AI

A instalação e configuração corretas de ferramentas de IA locais podem ser uma das partes mais frustrantes do processo, devido a conflitos de dependências, versões de controladores e compatibilidade de frameworks. O CORSAIR AI Software Stack é uma ferramenta de configuração guiada concebida para eliminar esses obstáculos. Ajuda-o a escolher e instalar as ferramentas adequadas para o seu sistema, desde frameworks de IA e aprendizagem automática até ambientes de desenvolvimento e software criativo, tudo adaptado ao seu hardware.

JOIN OUR OFFICIAL CORSAIR COMMUNITIES

Join our official CORSAIR Communities! Whether you're new or old to PC Building, have questions about our products, or want to chat about the latest PC, tech, and gaming trends, our community is the place for you.