BLOG

Gemma 4: O novo modelo aberto da Google e por que funciona melhor em computadores pessoais

Última atualização:

A Google acaba de lançar o Gemma 4, a sua família de modelos de pesos abertos mais avançada até à data, o que representa uma grande novidade para quem utiliza IA localmente em hardware comum. Lançado a 31 de março de 2026 sob uma licença Apache 2.0 totalmente permissiva, o Gemma 4 foi concebido para oferecer inteligência de ponta em GPUs de consumo e até mesmo em portáteis, sem necessidade de subscrição.

A gama inclui quatro tamanhos: E2B (2,3 mil milhões de parâmetros efetivos), E4B (4,5 mil milhões de parâmetros efetivos), uma variante «Mixture-of-Experts» de 26 mil milhões de parâmetros com apenas 4 mil milhões de parâmetros ativos e um modelo denso de 31 mil milhões de parâmetros. Isto permite-lhe ter tudo, desde modelos adequados para a periferia até modelos quase de ponta, numa única família, e tudo isto funciona no tipo de PC que os utilizadores já estão a montar.

O que distingue o Gemma 4

O Gemma 4 não é apenas maior, é mais inteligente em cada parâmetro. Alguns destaques:

- Raciocínio avançado e agentes: planeamento em várias etapas, matemática, programação e fluxos de trabalho autónomos prontos a usar.

- Multimodal: processa texto e imagens de forma nativa, com suporte de áudio nas variantes mais pequenas, E2B e E4B. A análise de documentos, o reconhecimento de gráficos e o OCR de escrita manual funcionam todos numa única solicitação.

- Contexto massivo: 128 mil tokens para os modelos E2B/E4B e 256 mil tokens para os modelos densos de 26 mil milhões e 31 mil milhões, capacidade suficiente para incluir uma base de código completa ou uma pilha de documentos.

- Multilíngue: treinado em mais de 140 idiomas, com forte suporte integrado para dezenas deles.

Está disponível no Hugging Face em variantes pré-treinadas e ajustadas para instruções, e funciona desde o primeiro dia com as ferramentas que já utiliza: Ollama, LM Studio, llama.cpp, vLLM e Transformers.

Por que razão os computadores pessoais de consumo são o ponto forte da Gemma 4

O Gemma 4 foi concebido tendo a inferência local como um objetivo prioritário, e os números comprovam isso. A NVIDIA e a Google colaboraram em otimizações desde o primeiro dia para as placas RTX, e o trabalho recente no llama.cpp reduziu o consumo de memória do cache KV em quase 40% em cenários de contexto longo.

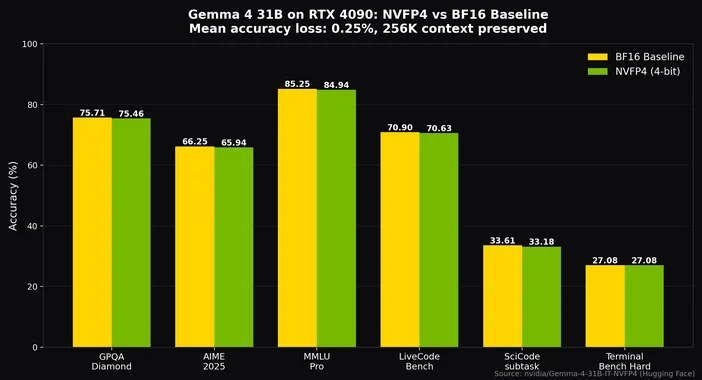

Com a quantização Q4_K_M, o ponto ideal para a maioria das configurações, é possível acomodar o modelo MoE de 26 mil milhões num cartão de 24 GB, como uma RTX 4090 ou 3090, com espaço para um contexto de 8 mil tokens, e ainda atingir bem mais de 20 tokens por segundo. Com a quantização NVFP4 da NVIDIA, até mesmo o modelo denso de 31B cabe numa única RTX 4090 com apenas ~0,25% de perda de precisão, preservando o contexto completo de 256K.

Um guia rápido de montagem

E2B / E4B (periferia e baixa latência): Uma RTX 3060 ou 4060 com 8 ou 12 GB de VRAM e um Ryzen 5 ou Core i5 moderno é mais do que suficiente. Combine-a com 32 GB de DDR5 e um sistema de refrigeração AIO silencioso se pretender realizar sessões prolongadas.

26B MoE / 31B denso (para raciocínio e multimodal): Opte por uma RTX 4090 (ou 3090, se já tiver uma), um Ryzen 7 / Core i7 ou superior, 64 GB de DDR5, um NVMe Gen4 rápido para o carregamento de modelos e uma fonte de alimentação de 850 W ou mais num gabinete com bom fluxo de ar. Algo como um CORSAIR iCUE LINK TITAN RX RGB 360 mm AIO mantém a GPU e a CPU a funcionar bem sob cargas de inferência sustentadas.

A série RTX 50 oferece ao Gemma 4 ainda mais margem de manobra para contextos mais amplos e uma inferência mais rápida.

Introdução rápida no seu PC

1. Instale o Ollama ou o LM Studio.

2. Recorra a um modelo Gemma 4 do Hugging Face (comece com o gemma4:e4b se for novo nisto, ou com o gemma4:31b se tiver VRAM suficiente).

3. Execute a inferência e espere 50, 100 ou mais tokens por segundo nas placas da série RTX 40 para as variantes mais pequenas.

4. Experimente a funcionalidade multimodal: insira uma imagem e um prompt e deixe-o analisar uma captura de ecrã, um gráfico ou uma fotografia.

Gemma 4 no dispositivo: agora também está disponível para dispositivos móveis

O foco na computação no dispositivo da Gemma 4 estende-se aos telemóveis. As variantes mais pequenas, E2B e E4B, funcionam com CPUs Arm e GPUs móveis, com latência quase nula para reconhecimento de voz, análise de imagens e assistentes integrados no dispositivo, sem necessidade de recorrer à nuvem. A pilha de IA no dispositivo da Google e o Android AICore tornam-na acessível em todo o sistema Android, e os programadores iOS podem utilizar a CPU e a GPU através do Metal.

O Gemma 4 é o sinal mais claro até agora de que os computadores de consumo de gama alta não são apenas máquinas para jogos, mas verdadeiras estações de trabalho de IA. Peso aberto, uma licença permissiva, raciocínio de ponta e uma janela de contexto de 256K que cabe efetivamente numa única GPU. Se já tens uma configuração moderna da CORSAIR, estás quase a ter uma verdadeira estação de trabalho de IA local. Se estiver a montar uma, planeie uma placa de 24 GB, 64 GB de DDR5 e um circuito de refrigeração que não vacile sob carga sustentada.

Quer executar o Gemma localmente? Conheça a CORSAIR AI Workstation 300

Se procura uma forma sem compromissos de executar o Gemma 4 (e outros modelos abertos) inteiramente no seu próprio hardware, a CORSAIR AI Workstation 300 foi concebida especificamente para esse fim. Combina um AMD Ryzen AI Max+ 395 com a iGPU Radeon 8060S e até 96 GB de VRAM unificada de um total de 128 GB de memória LPDDR5X-8000, proporcionando-lhe capacidade suficiente para carregar e ajustar variantes Gemma de grande dimensão localmente, sem necessidade de paging para o disco. Uma NPU dedicada de 50 TOPS acelera a inferência, e todo o sistema cabe num chassis de 4,4 L que pode colocar na sua secretária. Para programadores e investigadores que procuram privacidade, baixa latência e custos nulos por token, esta é uma das melhores formas de colocar o Gemma a funcionar.

PRODUTOS NO ARTIGO

JOIN OUR OFFICIAL CORSAIR COMMUNITIES

Join our official CORSAIR Communities! Whether you're new or old to PC Building, have questions about our products, or want to chat about the latest PC, tech, and gaming trends, our community is the place for you.