BLOG

Mémoire pour les LLM locaux : de combien de RAM avez-vous besoin ? (et quand la vitesse est-elle un facteur déterminant ?)

Dernière mise à jour :

Exécuter un grand modèle linguistique sur son propre matériel est l'une des applications les plus concrètes de l'IA à l'heure actuelle. Que vous testiez des assistants de programmation, développiez un chatbot privé ou soyez simplement curieux de découvrir les capacités des modèles open source, une question se pose immédiatement : de combien de mémoire ai-je réellement besoin ?

La réponse dépend du modèle que vous souhaitez exécuter, de la manière dont vous comptez le faire, et de ce qui vous importe le plus : l'ajustement du modèle ou l'obtention de résultats rapides et réactifs. La capacité de mémoire vous permet d'accéder au système. La vitesse de la mémoire détermine la qualité de l'expérience une fois que vous y êtes.

Pourquoi la mémoire constitue-t-elle un goulot d'étranglement ?

Lorsque vous exécutez un grand modèle linguistique en local, l'intégralité du modèle doit rester en mémoire pendant qu'il génère du texte. Contrairement aux jeux vidéo ou au montage vidéo, où les données sont chargées et déchargées de la mémoire selon les besoins, l'inférence d'un grand modèle linguistique charge l'ensemble complet des poids du modèle et les maintient en mémoire. Chaque token généré par le modèle doit passer par ces poids.

C'est donc la capacité mémoire qui constitue le principal goulot d'étranglement. Si vous ne disposez pas de suffisamment de RAM ou de VRAM pour contenir le modèle, soit vous ne pouvez pas l'exécuter du tout, soit une partie du modèle se retrouve stockée sur un support de stockage plus lent, ce qui réduit considérablement les performances. On parle ici d'un ralentissement de 5 à 30 fois dans certains cas.

Mais la capacité n'est qu'une partie du problème. Une fois que le modèle tient en mémoire, c'est la vitesse à laquelle votre système peut transmettre ces poids au processeur qui devient le principal facteur limitant la rapidité avec laquelle les tokens sont générés. C'est ce qu'on appelle la bande passante mémoire, et c'est pourquoi la vitesse et la configuration de la RAM sont plus importantes pour l'IA locale que pour presque toutes les autres charges de travail sur ordinateur de bureau.

RAM ou VRAM : laquelle est la plus importante ?

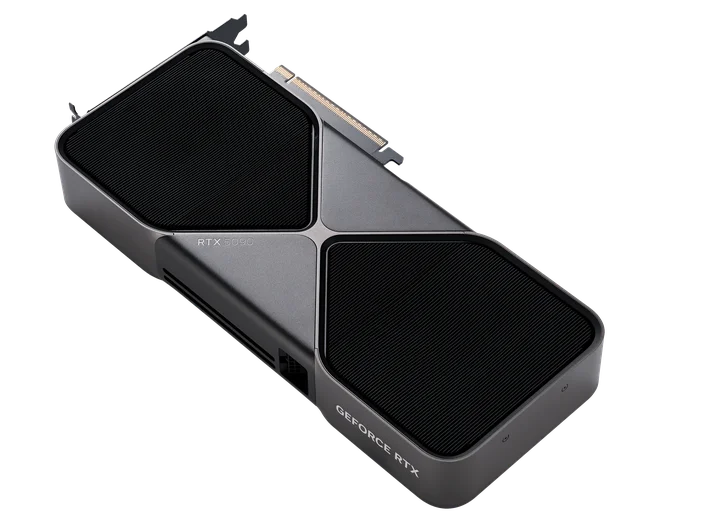

Si vous disposez d'un GPU dédié doté d'une mémoire vidéo (VRAM) suffisante, c'est la solution la plus rapide. La mémoire vidéo (VRAM) offre une bande passante bien supérieure à celle de la mémoire vive (RAM) du système : un GPU moderne comme le RTX 4090 ou le RTX 5090 peut atteindre plus de 1 To/s de bande passante mémoire, alors que même la mémoire vive DDR5 la plus rapide plafonne à environ 90 Go/s dans une configuration de bureau classique à double canal.

C'est en raison de ce déficit de bande passante qu'un modèle qui tient entièrement dans la mémoire VRAM peut générer 40 tokens ou plus par seconde, alors que le même modèle exécuté à partir de la mémoire vive du système ne parvient qu'à produire entre 8 et 15 tokens par seconde, même avec un processeur performant. Les deux solutions sont viables, mais la différence de réactivité est notable.

Le problème, c'est que les cartes graphiques grand public sont limitées à 24 Go de mémoire vidéo (sur des modèles comme la RTX 4090 et la RTX 5090), ce qui vous limite à des modèles d'environ 14 milliards de paramètres avec une bonne qualité, ou jusqu'à environ 32 milliards avec une quantification poussée. Si vous souhaitez exécuter des modèles plus volumineux, de 70 milliards de paramètres et plus, vous devrez probablement vous appuyer sur la mémoire vive (RAM) du système, utiliser plusieurs GPU ou accepter un certain compromis en termes de performances avec un déchargement partiel.

De combien de mémoire vive avez-vous besoin ? Une analyse pratique

C'est là que les choses se concrétisent. La quantité de mémoire requise par un modèle dépend du nombre de ses paramètres et de la précision (niveau de quantification) à laquelle vous l'exécutez. En gros, on peut dire qu'avec une quantification de niveau Q4 (4 bits), il faut compter environ 0,5 à 0,6 Go par milliard de paramètres, auxquels s'ajoute la mémoire nécessaire au contexte et au système d'exploitation.

8 Go : modèle d'entrée de gamme

Avec 8 Go de mémoire système totale (ou VRAM), vous pouvez facilement exécuter des modèles de petite taille, dont le nombre de paramètres se situe entre 1 et 7 milliards, en utilisant une quantification sur 4 bits. Cela inclut des modèles tels que Llama 3.2 3B, Phi-4 Mini, Qwen 3 4B et Mistral 7B (en Q4). Ces modèles sont étonnamment performants pour des tâches telles que la synthèse, la génération de code simple et les questions-réponses conversationnelles.

Comptez environ 40 à 50 tokens par seconde avec une carte graphique correcte, ou 15 à 20 tokens par seconde avec un processeur. C'est tout à fait suffisant pour des interactions de type chat.

16 Go : la capacité idéale pour la plupart des gens

Avec 16 Go, on peut utiliser des modèles de 7 et 8 milliards de paramètres avec une quantification plus élevée (Q8 pour une meilleure qualité) et des modèles de 13 à 14 milliards de paramètres avec une quantification Q4. C'est là que des modèles comme Llama 3.1 8B, Qwen 3 8B et DeepSeek-R1-Distill 14B deviennent viables. Vous disposez également d'une marge suffisante pour faire tourner le système d'exploitation et d'autres applications en parallèle du modèle sans que tout ne se bloque.

Pour la plupart des personnes qui s'essaient à l'IA locale, 16 Go de DDR5 constituent un point de départ réaliste. Vous obtiendrez de bons résultats avec les modèles open source les plus courants et ne serez pas constamment limité en mémoire.

32 Go : IA locale performante

Avec 32 Go, vous pouvez facilement faire tourner des modèles à 32 milliards de paramètres et des modèles à 70 milliards de paramètres avec une quantification poussée (Q2 ou Q3). Des modèles tels que Qwen 3 32B, DeepSeek-R1-Distill 32B et Gemma 3 27B s'inscrivent parfaitement dans cette catégorie. Ces modèles offrent un raisonnement nettement meilleur, des sorties cohérentes plus longues et des performances supérieures sur des tâches complexes par rapport à leurs homologues de plus petite taille.

Si vous utilisez des modèles de langage (LLM) locaux pour le développement, l'aide à la rédaction ou toute autre tâche où la qualité du résultat est primordiale, c'est à partir de 32 Go que l'expérience commence à être vraiment satisfaisante. Un kit comme le CORSAIR VENGEANCE DDR5 64 Go (2x32 Go) à 6 000 MT/s vous offre la capacité et la bande passante nécessaires pour gérer ces charges de travail sans compromis.

64 Go et au-delà : l'exécution des grands modèles

Si vous souhaitez exécuter des modèles de 70 milliards de paramètres avec des niveaux de quantification raisonnables (Q4 ou Q5), vous aurez besoin de 64 Go de mémoire vive, et idéalement d'une configuration multi-GPU ou d'un système prenant en charge le déchargement partiel sur GPU. Llama 3.3 70B en Q4 nécessite environ 42 Go rien que pour les poids du modèle, sans compter la fenêtre de contexte et la surcharge du système d'exploitation.

À ce niveau, la bande passante mémoire devient encore plus cruciale. Chaque génération de jetons nécessite le traitement en continu de dizaines de gigaoctets de paramètres, et une mémoire vive plus rapide se traduit directement par un traitement plus rapide. Il s'agit d'une configuration de type station de travail, mais elle est de plus en plus courante chez les professionnels qui souhaitent conserver des données sensibles sur leur appareil tout en travaillant avec des modèles ouverts de pointe.

Pourquoi la vitesse de la mémoire vive (RAM) est importante, et pas seulement sa capacité

Voici un fait qui en surprend plus d'un : pour l'inférence LLM locale, la bande passante mémoire est souvent plus importante que la puissance de calcul brute. Une fois le premier token généré (ce qui est une opération gourmande en calcul), chaque token suivant est une opération gourmande en mémoire. Le modèle doit faire passer l'intégralité de son ensemble de poids par le processeur pour chaque token, et la vitesse de ce transfert dépend de la bande passante de votre mémoire.

Les tests de performance en conditions réelles montrent clairement la différence. Il a été démontré que le passage de la DDR5-4800 à la DDR5-6000 améliore la vitesse de génération de tokens de 20 à 23 % pour des modèles tels que Mistral 7B et Llama 3.1 8B fonctionnant sur un processeur. Il s'agit là d'une amélioration significative et perceptible de la réactivité, qui résulte uniquement d'une mémoire plus rapide.

Les configurations à double canal jouent également un rôle crucial. L'utilisation de deux barrettes de RAM en mode double canal permet de doubler la bande passante disponible par rapport à une seule barrette. Concrètement, cela peut se traduire par une accélération de 30 à 50 % des opérations d'inférence. Si vous assemblez ou mettez à niveau un système destiné à l'IA locale, utilisez toujours deux barrettes en mode double canal, jamais une seule barrette DIMM.

Quantification : comment faire tenir des modèles plus volumineux dans moins de mémoire

La quantification est la technique qui permet d'utiliser les grands modèles de langage (LLM) locaux sur du matériel grand public. Elle consiste à compresser les poids du modèle, initialement au format à virgule flottante 16 bits (FP16), en représentations plus compactes, généralement de 4 bits (Q4), 5 bits (Q5) ou 8 bits (Q8). Le compromis consiste en une légère baisse de la qualité des résultats en échange d'une réduction considérable des besoins en mémoire.

Avec la quantification Q4_K_M (le format le plus répandu pour une utilisation locale), un modèle de 8 milliards de paramètres passe d'environ 16 Go à environ 5 ou 6 Go. Un modèle de 70 milliards de paramètres passe de 140 Go à environ 40 ou 42 Go. Cela représente une réduction de 75 % de l'espace mémoire, et dans la plupart des cas d'utilisation concrets, la différence de qualité est à peine perceptible.

Q5_K_M offre une qualité légèrement supérieure pour un coût en mémoire supérieur d'environ 15 à 20 %, et mérite d'être envisagé si vous disposez de la marge nécessaire. Q8 conserve la quasi-totalité de la qualité du modèle d'origine, mais ne réduit les besoins en mémoire que de moitié ; c'est le choix à privilégier lorsque vous disposez de beaucoup de mémoire et que vous souhaitez obtenir le meilleur résultat possible.

Des outils comme Ollama et LM Studio prennent en charge les modèles quantifiés de manière native ; vous n'avez donc pas besoin de procéder vous-même à une conversion. Il vous suffit de choisir le niveau de quantification adapté à la mémoire dont vous disposez.

Longueur du contexte : le coût caché de la mémoire

Chaque élément de contexte (le texte que vous envoyez au modèle ainsi que celui qu'il génère) nécessite de la mémoire supplémentaire, en plus de celle requise pour les poids du modèle. Les conversations courtes ne posent pas de problème, mais si vous alimentez le modèle avec de longs documents ou conservez des historiques de discussion étendus, la mémoire de contexte peut rapidement s'accumuler.

À titre indicatif, 8 000 tokens de contexte ajoutent environ 1 Go pour 10 milliards de paramètres. Si vous passez à 32 000 tokens, cela représente 4 Go supplémentaires. Certains modèles plus récents prennent en charge 128 000 tokens ou plus, ce qui peut effectivement doubler vos besoins totaux en mémoire.

Si vous prévoyez d'utiliser régulièrement des contextes volumineux, par exemple en intégrant des bases de code entières ou des documents volumineux dans un modèle, prévoyez une mémoire supplémentaire au-delà de celle requise par les poids du modèle seul. C'est une raison supplémentaire pour laquelle les configurations de 32 Go ou 64 Go sont tout à fait indiquées pour une utilisation locale intensive de l'IA.

Les mannequins populaires et ce dont elles ont besoin

Voici un tableau récapitulatif présentant certains des modèles locaux les plus utilisés actuellement, avec une estimation de la mémoire requise pour une quantification Q4_K_M :

- Phi-4 Mini (3,8 GHz): environ 2,3 Go, fonctionne très bien sur presque tous les systèmes

- Qwen 3.5 4B: environ 3,4 Go, idéal pour les tâches légères nécessitant un raisonnement solide

- Llama 3.2 8B: environ 5 Go, petit modèle polyvalent et fiable

- Qwen 3 8B: environ 5 Go, excellentes performances en matière de multilinguisme et de raisonnement

- Qwen 3.5 9B: environ 6,6 Go, dernier modèle compact doté de capacités améliorées

- DeepSeek-R1-Distill 14B: environ 9 Go, une excellente capacité de raisonnement dans un format compact

- Gemma 3 12B: environ 8 Go, l'option moyenne-gamme performante de Google

- Llama 4 Scout (109 milliards de paramètres, 17 milliards actifs): environ 10 Go avec une quantification agressive ; la dernière version de Meta fonctionne étonnamment bien grâce à l'architecture MoE

- Qwen 3.5 27B: environ 17 Go, une carte polyvalente et performante qui tient dans une mémoire vidéo de 24 Go

- Qwen 3 32B: environ 20 Go, performances élevées, compatible avec 24 Go de mémoire vidéo

- Qwen 3.5 35B-A3B (MoE): environ 24 Go, 35 milliards au total mais seulement 3 milliards actifs par jeton, très efficace

- Llama 3.3 70B: environ 42 Go, qualité proche de celle des modèles de pointe, nécessite une quantité importante de RAM

- DeepSeek-R1-Distill 70B: environ 42 Go, capacités de raisonnement de haut niveau pour une utilisation locale

- GPT-OSS 120B: environ 63 Go ; ce modèle à poids ouvert d'OpenAI nécessite au moins 64 Go de mémoire vive unifiée ou système

- Qwen 3.5 122B-A10B (MoE): environ 81 Go, modèle haut de gamme avec seulement 10 milliards de paramètres actifs

Ces chiffres concernent uniquement les poids des modèles avec une quantification Q4_K_M. Il faut compter entre 2 et 8 Go supplémentaires pour le contexte, la surcharge du système d'exploitation et toute autre application que vous exécutez en parallèle. Les modèles MoE (Mixture of Experts) tels que Llama 4 Scout et Qwen 3.5 35B-A3B sont particulièrement économes en mémoire lors de l'inférence, car seule une fraction de leurs paramètres totaux est active par token.

Choisir la mémoire adaptée à l'IA locale

Compte tenu de tout ce qui précède, voici comment aborder la configuration de la mémoire pour les LLM locaux :

Optez pour la DDR5 si votre plateforme la prend en charge. L'avantage en termes de bande passante par rapport à la DDR4 est bien réel et a un impact direct sur la vitesse d'inférence. La DDR5-6000 ou une version plus rapide offre le meilleur compromis entre prix, compatibilité et performances pour les charges de travail d'IA.

Utilisez toujours la configuration double canal. Pour l'inférence LLM, deux barrettes de RAM offrent des performances nettement supérieures à celles d'une seule barrette de même capacité totale. Un kit de 2 barrettes de 16 Go surpasse largement une seule barrette de 32 Go en termes de tokens par seconde.

Choisissez la capacité en fonction des modèles que vous souhaitez exécuter. Si vous travaillez principalement avec des modèles de 7 à 8 milliards de paramètres, 16 Go suffiront. Si vous souhaitez exécuter des modèles de 14 à 32 milliards de paramètres ou garder une marge de manœuvre pour de futurs modèles, visez plutôt 32 Go. Et si vous envisagez des modèles de 70 milliards de paramètres, prévoyez 64 Go.

Pour un système capable de gérer efficacement les modèles d'IA locaux actuels tout en laissant une marge de progression, un kit tel que le CORSAIR VENGEANCE DDR5 64 Go (2x32 Go) à 6000 MT/s ou 6400 MT/s est difficile à battre. Vous bénéficiez de la capacité nécessaire pour les modèles volumineux, de la bande passante pour une inférence rapide et d'une configuration double canal qui garantit un fonctionnement efficace. Si vous constituez une configuration plus compacte axée sur des modèles plus petits, un kit DDR5-6000 de 32 Go (2x16 Go) constitue un point de départ solide et économique.

Conçue spécialement pour l'IA locale : la CORSAIR AI WORKSTATION 300

Si vous envisagez sérieusement d'exécuter des modèles volumineux en local et que vous ne souhaitez pas assembler une tour multi-GPU, la CORSAIR AI WORKSTATION 300 propose une approche différente. Elle s'articule autour du processeur AMD Ryzen AI MAX+ 395, doté d'un GPU intégré Radeon 8060S capable d'accéder à jusqu'à 96 Go de VRAM à partir des 128 Go de mémoire LPDDR5X-8000 du système. C'est cette capacité qui la rend intéressante pour l'IA locale : un GPU grand public discret unique plafonne aujourd'hui à 32 Go de VRAM, il n'est donc pas possible de charger un modèle tel que GPT-OSS 120B (environ 63 Go en MXFP4) sur une seule carte sans répartir le modèle sur plusieurs GPU ou le décharger vers la mémoire vive du système.

L'architecture de mémoire unifiée constitue le principal compromis. Vous renoncez à la bande passante brute d'une mémoire VRAM GDDR7 dédiée, mais en échange, vous bénéficiez de jusqu'à 96 Go de mémoire accessible au GPU à des vitesses LPDDR5X. Cela signifie que les modèles dont le nombre de paramètres se situe entre 70 et 120 milliards, qui nécessiteraient autrement plusieurs GPU discrets ou un déchargement important du CPU, peuvent s'exécuter entièrement sur le chemin mémoire du GPU sur une seule machine, sans avoir à répartir les couches entre plusieurs cartes ni à paginer les poids via PCIe.

Le système intègre également le NPU XDNA 2 d'AMD, offrant une accélération IA de 50 TOPS pour les tâches moins exigeantes, ainsi qu'une connexion Ethernet à 2,5 Gbps, le Wi-Fi 6E et plusieurs ports USB 4.0. Pour les professionnels travaillant avec des données sensibles – qu'il s'agisse du secteur juridique, médical ou financier –, disposer d'un tel niveau de capacités IA en mode entièrement hors ligne et sur site constitue un avantage pratique considérable.

La suite logicielle CORSAIR AI

L'installation et la configuration correctes des outils d'IA locaux peuvent constituer l'une des étapes les plus frustrantes du processus : conflits de dépendances, versions de pilotes, compatibilité des frameworks. La suite logicielle CORSAIR AI est un outil de configuration guidée conçu pour éliminer ces difficultés. Elle vous aide à choisir et à installer les outils adaptés à votre système, qu'il s'agisse de frameworks d'IA et d'apprentissage automatique, d'environnements de développement ou de logiciels créatifs, le tout sur mesure pour votre matériel.

JOIN OUR OFFICIAL CORSAIR COMMUNITIES

Join our official CORSAIR Communities! Whether you're new or old to PC Building, have questions about our products, or want to chat about the latest PC, tech, and gaming trends, our community is the place for you.