BLOG

Hukommelse til lokale store sprogmodeller: Hvor meget RAM har du brug for? (og hvornår hastigheden betyder noget)

Sidst opdateret:

At køre en stor sprogmodel på din egen hardware er en af de mest praktiske ting, du kan gøre med AI lige nu. Uanset om du eksperimenterer med programmeringsassistenter, udvikler en privat chatbot eller bare er nysgerrig efter at se, hvad open source-modeller kan, dukker der straks et spørgsmål op: Hvor meget hukommelse har jeg egentlig brug for?

Svaret afhænger af, hvilken model du vil køre, hvordan du planlægger at køre den, og om du lægger mest vægt på at få modellen til at passe overhovedet eller på at få hurtige, responsive resultater. Hukommelseskapaciteten er det, der får dig ind ad døren. Hukommelseshastigheden afgør, hvor god oplevelsen føles, når du først er kommet ind.

Hvorfor hukommelsen er flaskehalsen

Når man kører en stor sprogmodel lokalt, skal hele modellen ligge i hukommelsen, mens den genererer tekst. I modsætning til spil eller videoredigering, hvor data strømmer ind og ud af hukommelsen efter behov, indlæser LLM-inferens det fulde sæt af modelvægte og holder dem i hukommelsen. Hvert eneste token, som modellen genererer, skal behandles gennem disse vægte.

Det betyder, at hukommelseskapaciteten er den afgørende begrænsning. Hvis du ikke har nok RAM eller VRAM til at rumme modellen, kan du enten slet ikke køre den, eller også ender en del af modellen med at blive flyttet over på en langsommere lagerplads, hvilket forringer ydeevnen drastisk. I nogle tilfælde taler vi om en hastighed, der er 5 til 30 gange langsommere.

Men kapaciteten er kun den ene side af sagen. Når modellen først er lastet ind i hukommelsen, bliver den hastighed, hvormed systemet kan sende disse vægtværdier til processoren, den primære begrænsende faktor for, hvor hurtigt resultaterne kommer ud. Det er hukommelsesbåndbredde, og det er grunden til, at RAM-hastighed og -konfiguration har større betydning for lokal AI end for næsten enhver anden opgave på en stationær computer.

RAM eller VRAM: Hvad er vigtigst?

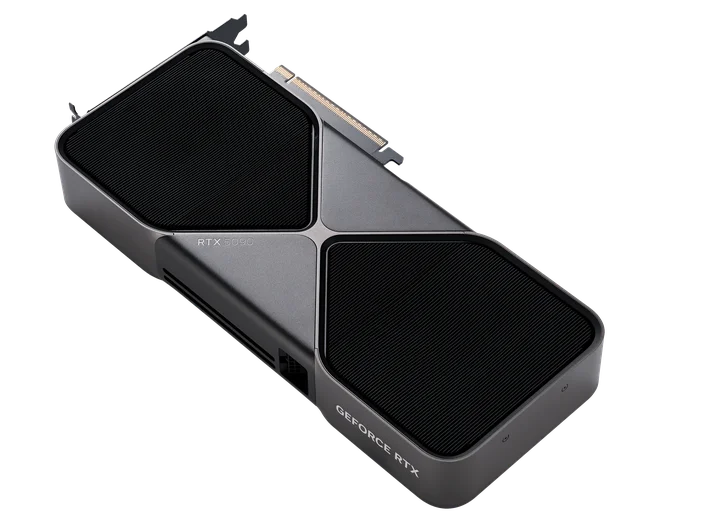

Hvis du har et dedikeret grafikkort med tilstrækkelig VRAM, er det den hurtigste løsning. Grafikkortets hukommelse (VRAM) har en langt større båndbredde end system-RAM; et moderne grafikkort som f.eks. et RTX 4090 eller RTX 5090 kan levere over 1 TB/s i hukommelsesbåndbredde, mens selv hurtig DDR5-system-RAM kun når op på omkring 90 GB/s i en typisk desktop-konfiguration med to kanaler.

Det er netop denne forskel i båndbredde, der gør, at en model, der kan rummes fuldt ud i VRAM, kan generere 40 eller flere tokens i sekundet, mens den samme model, der kører fra system-RAM, måske kun når op på 8 til 15 tokens i sekundet på en hurtig CPU-konfiguration. Begge løsninger er brugbare, men forskellen i reaktionsevne er mærkbar.

Hagen er, at GPU'er til forbrugermarkedet har en maksimal VRAM-kapacitet på 24 GB (på kort som RTX 4090 og RTX 5090), hvilket begrænser dig til modeller med ca. 14 mia. parametre i god kvalitet eller op til ca. 32 mia. med aggressiv kvantisering. Hvis du vil køre større modeller, 70 mia. parametre og derover, bliver du sandsynligvis nødt til at benytte system-RAM, bruge flere GPU'er eller acceptere en vis ydeevnekompromis med delvis offloading.

Hvor meget RAM har du brug for? En praktisk oversigt

Nu bliver det konkret. Den mængde hukommelse, en model kræver, afhænger af antallet af parametre og den præcision (kvantisering), den kører med. En grov tommelfingerregel: Ved Q4-kvantisering (4-bit) skal man regne med at bruge omkring 0,5 til 0,6 GB pr. milliard parametre, plus ekstra plads til kontekst og operativsystemet.

8 GB: Startpunkt

Med 8 GB samlet systemhukommelse (eller VRAM) kan du uden problemer køre mindre modeller i parameterområdet 1B til 7B ved hjælp af 4-bit-kvantisering. Det omfatter modeller som Llama 3.2 3B, Phi-4 Mini, Qwen 3 4B og Mistral 7B (ved Q4). Disse er overraskende effektive til opgaver som sammenfatning, enkel kodegenerering og dialogbaseret Q&A.

Du kan forvente omkring 40 til 50 tokens i sekundet på et ordentligt grafikkort eller 15 til 20 tokens i sekundet på en CPU. Det er helt fint til interaktioner i chat-stil.

16 GB: Det perfekte valg for de fleste

16 GB åbner mulighed for 7B- og 8B-modeller med højere kvantisering (Q8 for bedre kvalitet) samt 13B- til 14B-modeller ved Q4. Det er her, modeller som Llama 3.1 8B, Qwen 3 8B og DeepSeek-R1-Distill 14B bliver anvendelige. Du får også tilstrækkelig kapacitet til at køre operativsystemet og andre apps sideløbende med modellen, uden at det hele går i stå.

For de fleste, der eksperimenterer med lokal AI, er 16 GB DDR5 et realistisk udgangspunkt. Du vil opnå gode resultater med de mest populære open source-modeller og vil ikke konstant føle, at du mangler hukommelse.

32 GB: Avanceret lokal AI

Med 32 GB har du rigelig kapacitet til at køre modeller med 32 milliarder parametre uden problemer og modeller med 70 milliarder parametre med kraftig kvantisering (Q2 eller Q3). Modeller som Qwen 3 32B, DeepSeek-R1-Distill 32B og Gemma 3 27B passer godt her. Disse modeller tilbyder mærkbart bedre ræsonnement, længere sammenhængende output og stærkere ydeevne på komplekse opgaver sammenlignet med deres mindre modstykker.

Hvis du bruger lokale store sprogmodeller (LLM'er) til udviklingsarbejde, skrivehjælp eller andre opgaver, hvor kvaliteten af resultatet er afgørende, er det først ved 32 GB, at oplevelsen virkelig begynder at føles god. Et sæt som f.eks. CORSAIR VENGEANCE DDR5 64 GB (2x32 GB) med 6000 MT/s giver dig den nødvendige kapacitet og båndbredde til at håndtere disse arbejdsopgaver uden at gå på kompromis.

64 GB og mere: Kørsel af store modeller

Hvis du vil køre modeller med 70 milliarder parametre ved rimelige kvantiseringniveauer (Q4 eller Q5), skal du have 64 GB system-RAM og helst en opsætning med flere GPU'er eller et system, der understøtter delvis GPU-aflastning. Llama 3.3 70B ved Q4 kræver ca. 42 GB alene til modelvægtningerne, før der tages højde for kontekstvinduet og operativsystemets overhead.

På dette niveau bliver hukommelsesbåndbredden endnu mere afgørende. Hver generering af tokens kræver, at der strømmes gennem snesevis af gigabyte med vægtparametre, og hurtigere RAM betyder direkte hurtigere resultater. Dette er en opsætning i workstation-klassen, men det bliver stadig mere almindeligt blandt fagfolk, der ønsker at opbevare følsomme data lokalt på enheden, mens de arbejder med banebrydende åbne modeller.

Hvorfor RAM-hastighed er vigtig – ikke kun kapaciteten

Her er noget, der overrasker mange: Når det gælder lokal LLM-inferens, er hukommelsesbåndbredden ofte vigtigere end den rene regnekraft. Når det første token er genereret (hvilket er regneintensivt), er hvert efterfølgende token hukommelsesintensivt. Modellen skal sende hele sit vægtsæt gennem processoren for hvert token, og hastigheden på denne datastrøm afhænger af din hukommelsesbåndbredde.

Praktiske tests viser tydeligt forskellen. Det er påvist, at et skift fra DDR5-4800 til DDR5-6000 øger hastigheden for generering af token med 20 til 23 procent for modeller som Mistral 7B og Llama 3.1 8B, der kører på CPU. Det er en markant og mærkbar forbedring af reaktionsevnen, og den skyldes udelukkende hurtigere hukommelse.

Konfigurationer med to kanaler har også enorm betydning. Når man bruger to RAM-moduler i dual-channel-tilstand, fordobles den tilgængelige båndbredde i praksis i forhold til et enkelt modul. I praksis kan det betyde en 30 til 50 procent hurtigere inferens. Hvis du bygger eller opgraderer et system til lokal AI, skal du altid bruge to moduler i dual-channel-tilstand og aldrig et enkelt DIMM.

Kvantisering: Sådan får man større modeller til at passe i mindre hukommelse

Kvantisering er den teknik, der gør lokale store sprogmodeller (LLM'er) anvendelige på almindelig hardware. Den komprimerer modelvægtningerne fra deres oprindelige 16-bit flydende komma (FP16) til mindre repræsentationer, typisk 4-bit (Q4), 5-bit (Q5) eller 8-bit (Q8). Kompromiset er en mindre forringelse af outputkvaliteten til gengæld for en markant reduktion i hukommelseskravene.

Ved Q4_K_M-kvantisering (det mest udbredte format til lokal brug) falder størrelsen på en 8B-model fra ca. 16 GB til omkring 5–6 GB. En 70B-model falder fra 140 GB til ca. 40–42 GB. Det svarer til en reduktion på 75 procent i hukommelsesbehov, og i de fleste praktiske anvendelsessituationer er kvalitetsforskellen næsten ikke mærkbar.

Q5_K_M tilbyder en anelse bedre kvalitet til en omtrent 15 til 20 procent højere hukommelsesomkostning og er værd at overveje, hvis du har plads til det. Q8 bevarer næsten hele den oprindelige modelkvalitet, men halverer kun hukommelseskravene; det er det rette valg, når du har rigeligt med hukommelse og ønsker det bedst mulige resultat.

Værktøjer som Ollama og LM Studio understøtter kvantiserede modeller direkte, så du behøver ikke selv at foretage nogen konvertering. Du skal blot vælge det kvantiseringsniveau, der passer til den hukommelse, du har til rådighed.

Kontekstlængde: Den skjulte hukommelsesomkostning

Hvert eneste stykke kontekst (den tekst, du sender til modellen, samt den tekst, den genererer) kræver ekstra hukommelse ud over selve modellens vægtværdier. Korte samtaler er ikke noget problem, men hvis du indlæser lange dokumenter eller opbevarer omfattende chatlogge, kan konteksthukommelsen hurtigt fylde meget.

Som en grov retningslinje tilføjer 8K kontekst-tokens ca. 1 GB pr. 10 mia. parametre. Øger man det til 32K tokens, bliver det 4 GB ekstra. Nogle nyere modeller understøtter 128K tokens eller mere, hvilket reelt kan fordoble det samlede hukommelsesbehov.

Hvis du har planer om regelmæssigt at bruge lange tekster, f.eks. ved at indlæse hele kodebaser eller lange dokumenter i en model, bør du afsætte ekstra hukommelse ud over det, som modellens vægte i sig selv kræver. Dette er endnu en grund til, at konfigurationer på 32 GB eller 64 GB er en fornuftig løsning til seriøs lokal brug af AI.

Populære modeller og deres behov

Her er en hurtig oversigt over nogle af de mest anvendte lokale modeller i øjeblikket, med angivelse af det omtrentlige hukommelsesbehov ved Q4_K_M-kvantisering:

- Phi-4 Mini (3,8 GHz): ~2,3 GB, kører fint på næsten alt

- Qwen 3.5 4B: ~3,4 GB, fremragende til enkle opgaver med stærk logisk ræsonnement

- Llama 3.2 8B: ~5 GB, pålidelig lille model til generelle formål

- Qwen 3 8B: ~5 GB, fremragende ydeevne inden for flersprogethed og logisk ræsonnement

- Qwen 3.5 9B: ~6,6 GB, den nyeste lille model med forbedrede funktioner

- DeepSeek-R1-Distill 14B: ~9 GB, fremragende ræsonnement i et kompakt format

- Gemma 3 12B: ~8 GB, Googles effektive mellemstørrelse

- Llama 4 Scout (109B MoE, 17B aktive): ~10 GB ved aggressiv kvantisering, Metas nyeste model, kører overraskende godt takket være MoE-arkitekturen

- Qwen 3.5 27B: ~17 GB, en stærk allround-model, der passer til 24 GB VRAM

- Qwen 3 32B: ~20 GB, stor ydeevne, passer til 24 GB VRAM

- Qwen 3.5 35B-A3B (MoE): ~24 GB, i alt 35B, men kun 3B er aktive pr. token, meget effektiv

- Llama 3.3 70B: ~42 GB, næsten topkvalitet, kræver betydelig mængde RAM

- DeepSeek-R1-Distill 70B: ~42 GB, førsteklasses ræsonnement til lokal brug

- GPT-OSS 120B: ~63 GB, OpenAIs model med åben vægt, kræver mindst 64 GB samlet RAM eller system-RAM

- Qwen 3.5 122B-A10B (MoE): ~81 GB, flagskibsklasse med kun 10 milliarder aktive parametre

Disse tal gælder udelukkende for modelvægt ved Q4_K_M-kvantisering. Der skal lægges 2 til 8 GB til for kontekst, OS-overhead og eventuelle andre programmer, du kører sideløbende. MoE-modeller (Mixture of Experts) som Llama 4 Scout og Qwen 3.5 35B-A3B er særligt hukommelseseffektive under inferens, da kun en brøkdel af deres samlede parametre er aktive pr. token.

Valg af den rigtige hukommelse til lokal AI

På baggrund af ovenstående kan du her se, hvordan du bør tilgå din hukommelsesopsætning til lokale LLM'er:

Vælg DDR5, hvis din platform understøtter det. Fordelen i båndbredde i forhold til DDR4 er reel og har direkte indflydelse på inferenshastigheden. DDR5-6000 eller hurtigere rammer det perfekte balancepunkt mellem pris, kompatibilitet og ydeevne til AI-opgaver.

Brug altid dual-channel. To RAM-moduler giver en markant bedre ydeevne end et enkelt modul med samme samlede kapacitet til LLM-inferens. Et sæt bestående af to 16 GB-moduler slår et enkelt 32 GB-modul med stor margin, målt i tokens pr. sekund.

Vælg den mængde hukommelse, der passer til de modeller, du vil køre. Hvis du primært eksperimenterer med modeller på 7B til 8B, er 16 GB tilstrækkeligt. Hvis du vil køre modeller på 14B til 32B eller sikre dig plads til fremtidige modeller, er 32 GB det bedste valg. Og hvis du har planer om at arbejde med 70B-modeller, bør du regne med 64 GB.

Hvis man leder efter et system, der klarer de nuværende lokale AI-modeller uden problemer og samtidig giver plads til fremtidig udvidelse, er et sæt som CORSAIR VENGEANCE DDR5 64 GB (2x32 GB) med 6000 MT/s eller 6400 MT/s svært at slå. Du får kapaciteten til store modeller, båndbredden til hurtig inferens og den dual-channel-konfiguration, der får det hele til at fungere effektivt. Hvis du bygger en mere kompakt opsætning med fokus på mindre modeller, er et 32 GB (2x16 GB) DDR5-6000-sæt et solidt og omkostningseffektivt udgangspunkt.

Specielt udviklet til lokal AI: CORSAIR AI WORKSTATION 300

Hvis du seriøst overvejer at køre store modeller lokalt og ikke ønsker at bygge en tower-pc med flere GPU'er, tager CORSAIR AI WORKSTATION 300 en anden tilgang. Den er bygget op omkring AMD's Ryzen AI MAX+ 395-processor med en integreret Radeon 8060S-GPU, der kan få adgang til op til 96 GB VRAM fra systemets 128 GB LPDDR5X-8000-hukommelse. Det er netop denne kapacitet, der gør den interessant til lokal AI: En enkelt diskret forbruger-GPU har i dag en maksimal VRAM-kapacitet på 32 GB, så det er ikke muligt at indlæse noget som GPT-OSS 120B (ca. 63 GB ved MXFP4) på et enkelt kort uden at opdele modellen på flere GPU'er eller udlægge den til system-RAM.

Den samlede hukommelsesarkitektur er det centrale kompromis. Du giver afkald på den rå båndbredde fra dedikeret GDDR7 VRAM, men til gengæld får du op til 96 GB GPU-tilgængelig hukommelse ved LPDDR5X-hastigheder. Det betyder, at modeller i parameterområdet 70B til 120B, som ellers ville kræve flere diskrete GPU'er eller tung CPU-aflastning, kan køre udelukkende på GPU-hukommelsesbanen på en enkelt maskine, uden at lagene skal fordeles på tværs af kort eller vægtene skal pagineres via PCIe.

Systemet indeholder desuden AMD's XDNA 2 NPU med 50 TOPS AI-acceleration til mindre krævende opgaver, 2,5 Gbps Ethernet, Wi-Fi 6E samt flere USB 4.0-porte. For fagfolk, der arbejder med følsomme data inden for eksempelvis jura, medicin og finans, udgør det en betydelig praktisk fordel at have denne grad af AI-kapacitet til rådighed helt offline og lokalt.

CORSAIRs AI-softwarestak

At få lokale AI-værktøjer installeret og konfigureret korrekt kan være en af de mest frustrerende dele af processen – med afhængighedskonflikter, driverversioner og kompatibilitetsproblemer med rammeværker. CORSAIR AI Software Stack er et vejledende installationsværktøj, der er udviklet til at fjerne disse problemer. Det hjælper dig med at vælge og installere de rigtige værktøjer til dit system, lige fra AI- og maskinlæringsrammeværker til udviklingsmiljøer og kreativt software – alt sammen skræddersyet til din hardware.

JOIN OUR OFFICIAL CORSAIR COMMUNITIES

Join our official CORSAIR Communities! Whether you're new or old to PC Building, have questions about our products, or want to chat about the latest PC, tech, and gaming trends, our community is the place for you.