BLOG

Gemma 4: Googles nye åbne model, og hvorfor den fungerer bedst på almindelige pc'er

Sidst opdateret:

Google har netop lanceret Gemma 4, sin hidtil mest avancerede model-serie med åbne vægtparametre, og det er en stor nyhed for alle, der kører AI lokalt på almindelig hardware. Gemma 4, der blev udgivet den 31. marts 2026 under en fuldt fri Apache 2.0-licens, er udviklet til at levere banebrydende intelligens på almindelige GPU'er og endda bærbare computere – helt uden abonnement.

Serien omfatter fire størrelser: E2B (2,3 mia. effektive parametre), E4B (4,5 mia. effektive), en 26B Mixture-of-Experts-variant med kun 4 mia. aktive parametre og en 31B-model med tæt struktur. Det giver dig alt fra edge-venlige modeller til modeller tæt på grænsen inden for en enkelt serie, og det hele kører på den type pc'er, som pc-entusiaster allerede samler.

Hvad der gør Gemma 4 til noget særligt

Gemma 4 er ikke bare større, den er også mere avanceret på alle parametre. Her er nogle af højdepunkterne:

- Avanceret logisk ræsonnement og agenter: flertrinsplanlægning, matematik, programmering og autonome arbejdsgange lige fra starten.

- Multimodal: håndterer tekst og billeder direkte, med lydunderstøttelse på de mindre modeller E2B og E4B. Dokumentanalyse, diagramgenkendelse og OCR af håndskrift fungerer alle i én og samme kommando.

- Omfattende kontekst: 128.000 tokens til E2B/E4B og hele 256.000 tokens til 26B MoE- og 31B-modellerne – nok til at rumme en hel kodebase eller en stak dokumenter.

- Flersproget: Trænet på over 140 sprog med solid indbygget understøttelse af snesevis af dem.

Den leveres i foruddannede og instruktionsoptimerede varianter på Hugging Face og fungerer fra dag ét sammen med de værktøjer, du allerede bruger: Ollama, LM Studio, llama.cpp, vLLM og Transformers.

Hvorfor forbruger-pc'er er Gemma 4's styrke

Gemma 4 er udviklet med lokal inferens som et hovedmål, og tallene underbygger dette. NVIDIA og Google har samarbejdet om optimeringer, der er klar fra dag ét, til RTX-kort, og det seneste arbejde med llama.cpp har reduceret brugen af KV-cache-hukommelse med næsten 40 % i scenarier med lange kontekster.

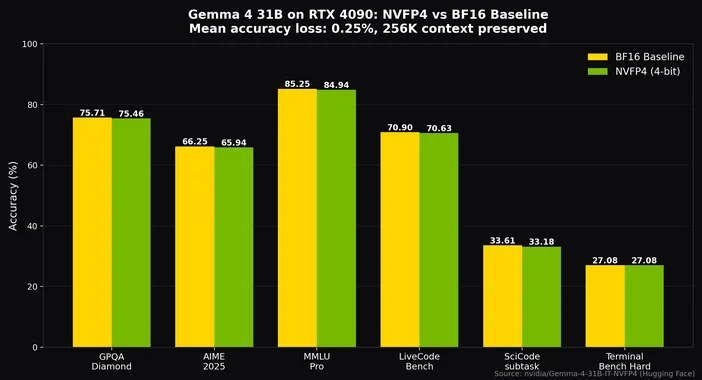

Med Q4_K_M-kvantisering, som er det optimale valg for de fleste modeller, kan man få plads til 26B MoE på et 24 GB-kort som et RTX 4090 eller 3090 med plads til en 8K-token-kontekst og stadig nå langt over 20 tokens i sekundet. Med NVIDIAs NVFP4-kvantisering passer selv den tætte 31B-model på et enkelt RTX 4090 med kun ~0,25 % nøjagtighedstab, samtidig med at den fulde 256K-kontekst bevares.

En hurtig guide til opbygning

E2B / E4B (edge og lav latenstid): Et RTX 3060- eller 4060-grafikkort med 8 eller 12 GB VRAM og en moderne Ryzen 5- eller Core i5-processor er rigeligt. Kombiner det med 32 GB DDR5-hukommelse og et støjsvagt AIO-kølesystem, hvis du planlægger at køre lange sessioner.

26B MoE / 31B tæt (til ræsonnement og multimodal): Gå efter et RTX 4090 (eller 3090, hvis du allerede har et), en Ryzen 7 / Core i7 eller bedre, 64 GB DDR5, en hurtig Gen4 NVMe til modelindlæsning og en strømforsyning på 850 W eller mere i et kabinet med god luftgennemstrømning. Noget i stil med en CORSAIR iCUE LINK TITAN RX RGB 360 mm AIO holder GPU'en og CPU'en tilfredse under vedvarende inferensbelastninger.

RTX 50-serien giver Gemma 4 endnu mere ydeevne til større opgaver og hurtigere inferens.

Hurtigstart på din pc

1. Installer Ollama eller LM Studio.

2. Hent en Gemma 4-model fra Hugging Face (start med gemma4:e4b, hvis du er nybegynder, eller gemma4:31b, hvis du har VRAM).

3. Kør inferens, og forvent 50, 100+ tokens/sek. på RTX 40-serien for de mindre modeller.

4. Prøv den multimodale funktion: Indsæt et billede sammen med en beskrivelse, og lad den analysere et skærmbillede, et diagram eller et foto.

Gemma 4 On-Device: Nu også til mobilen

Gemma 4's edge-fokus omfatter også mobiltelefoner. De mindre varianter, E2B og E4B, kører på Arm-CPU'er og mobile GPU'er med næsten ingen forsinkelse ved talegenkendelse, billedanalyse og enhedsbaserede assistenter – helt uden brug af skyen. Googles AI Edge-stack og Android AICore gør det tilgængeligt på tværs af hele Android-systemet, og iOS-udviklere kan udnytte CPU og GPU via Metal.

Gemma 4 er det hidtil tydeligste tegn på, at high-end-pc'er til forbrugere ikke blot er gaming-maskiner, men reelle AI-arbejdsstationer. Åbne vægtninger, en lempelig licens, banebrydende ræsonnement og et kontekstvindue på 256K, der rent faktisk kan rummes på en enkelt GPU. Hvis du allerede har en moderne CORSAIR-konfiguration, er du godt på vej til at få en rigtig lokal AI-arbejdsstation. Hvis du er ved at sammensætte en, skal du regne med et 24 GB-kort, 64 GB DDR5 og et kølesystem, der ikke vakler under vedvarende belastning.

Vil du køre Gemma lokalt? Mød CORSAIR AI Workstation 300

Hvis du ønsker en løsning uden kompromiser, hvor du kan køre Gemma 4 (og andre åbne modeller) udelukkende på din egen hardware, er CORSAIR AI Workstation 300 skræddersyet til formålet. Den kombinerer en AMD Ryzen AI Max+ 395 med Radeon 8060S iGPU og op til 96 GB samlet VRAM ud af 128 GB LPDDR5X-8000-hukommelse, hvilket giver dig tilstrækkelig kapacitet til at indlæse og finjustere store Gemma-varianter lokalt uden at skulle udlæse til disk. En dedikeret 50 TOPS NPU fremskynder inferens, og hele systemet passer i et 4,4 liters kabinet, som du kan placere på dit skrivebord. For udviklere og forskere, der ønsker privatliv, lav latenstid og ingen omkostninger pr. token, er det en af de bedste måder at sætte Gemma i arbejde på.

PRODUKTER I ARTIKEL

JOIN OUR OFFICIAL CORSAIR COMMUNITIES

Join our official CORSAIR Communities! Whether you're new or old to PC Building, have questions about our products, or want to chat about the latest PC, tech, and gaming trends, our community is the place for you.