BLOG

Geheugen voor lokale LLM’s: hoeveel RAM heb je nodig? (en wanneer snelheid belangrijk is)

Laatst bijgewerkt:

Het draaien van een groot taalmodel op je eigen hardware is momenteel een van de meest praktische toepassingen van AI. Of je nu experimenteert met programmeerassistenten, een eigen chatbot bouwt of gewoon nieuwsgierig bent naar wat open-source modellen kunnen, er is één vraag die meteen opkomt: hoeveel geheugen heb ik eigenlijk nodig?

Het antwoord hangt af van het model dat je wilt uitvoeren, hoe je dat wilt doen en of je meer waarde hecht aan het fitten van het model of aan snelle, responsieve resultaten. De geheugencapaciteit zorgt ervoor dat je binnenkomt. De geheugensnelheid bepaalt hoe prettig de ervaring is als je eenmaal binnen bent.

Waarom het geheugen het knelpunt is

Wanneer je een groot taalmodel lokaal uitvoert, moet het volledige model in het geheugen aanwezig zijn terwijl het tekst genereert. In tegenstelling tot gaming of videobewerking, waarbij gegevens naar behoefte in en uit het geheugen worden gestreamd, laadt de LLM-inferentie de volledige set modelgewichten en houdt deze in het geheugen. Elk afzonderlijk token dat het model genereert, moet door die gewichten worden verwerkt.

Dat maakt de geheugencapaciteit de beperkende factor. Als je niet genoeg RAM of VRAM hebt om het model te laden, kun je het ofwel helemaal niet uitvoeren, ofwel komt een deel van het model terecht op tragere opslag, wat de prestaties drastisch vermindert. In sommige gevallen gaat het dan om een vertraging van 5 tot 30 keer.

Maar de capaciteit is slechts het halve verhaal. Zodra het model in het geheugen past, wordt de snelheid waarmee je systeem die gewichten aan de processor kan doorgeven de belangrijkste beperkende factor voor de snelheid waarmee tokens worden gegenereerd. Dat is geheugenbandbreedte, en daarom zijn de snelheid en configuratie van het RAM-geheugen voor lokale AI belangrijker dan voor bijna elke andere desktoptaak.

RAM versus VRAM: wat is belangrijker?

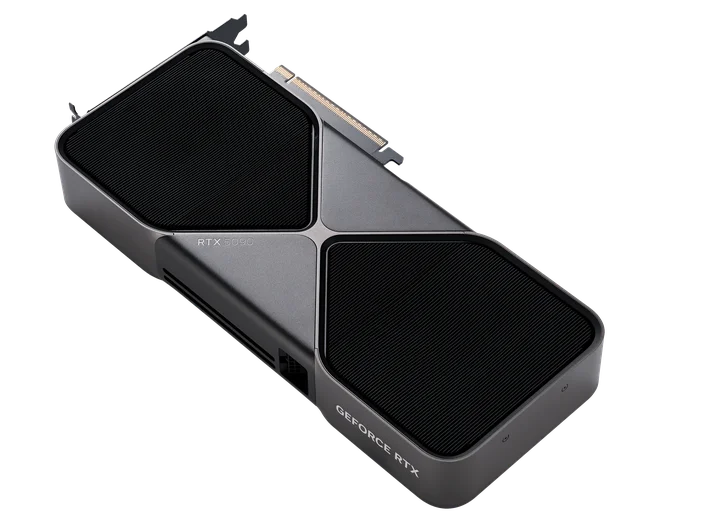

Als je een aparte grafische kaart hebt met voldoende VRAM, is dat de snelste manier. Het geheugen van een grafische kaart (VRAM) heeft een veel grotere bandbreedte dan het systeemgeheugen; een moderne grafische kaart zoals een RTX 4090 of RTX 5090 kan meer dan 1 TB/s aan geheugenbandbreedte leveren, terwijl zelfs snel DDR5-systeemgeheugen in een standaard dual-channel desktopconfiguratie maximaal ongeveer 90 GB/s haalt.

Door dat verschil in bandbreedte kan een model dat volledig in het VRAM past 40 of meer tokens per seconde genereren, terwijl hetzelfde model dat vanuit het systeem-RAM draait op een snelle CPU-configuratie slechts 8 tot 15 tokens per seconde haalt. Beide zijn bruikbaar, maar het verschil in reactiesnelheid is merkbaar.

Het addertje onder het gras is dat GPU’s voor consumenten maximaal 24 GB VRAM hebben (bij kaarten als de RTX 4090 en RTX 5090), waardoor je beperkt bent tot modellen met ongeveer 14 miljard parameters bij goede kwaliteit, of tot ongeveer 32 miljard bij agressieve kwantisering. Als je grotere modellen wilt draaien, met 70 miljard parameters en meer, zul je waarschijnlijk een beroep moeten doen op het systeem-RAM, meerdere GPU's moeten gebruiken of genoegen moeten nemen met enige prestatievermindering door gedeeltelijke offloading.

Hoeveel RAM heb je nodig? Een praktisch overzicht

Hier wordt het concreet. De hoeveelheid geheugen die een model nodig heeft, hangt af van het aantal parameters en de precisie (kwantisatieniveau) waarop je het uitvoert. Een ruwe vuistregel: bij Q4-kwantisatie (4-bit) kun je rekenen op ongeveer 0,5 tot 0,6 GB per miljard parameters, plus overhead voor context en het besturingssysteem.

8 GB: instapmodel

Met in totaal 8 GB systeemgeheugen (of VRAM) kun je met 4-bits kwantisering moeiteloos kleine modellen draaien in het parameterbereik van 1B tot 7B. Daaronder vallen modellen als Llama 3.2 3B, Phi-4 Mini, Qwen 3 4B en Mistral 7B (bij Q4). Deze zijn verrassend capabel voor taken zoals samenvattingen maken, eenvoudige codegeneratie en conversatiegerichte vraag-en-antwoord.

Reken op ongeveer 40 tot 50 tokens per seconde op een degelijke GPU, of 15 tot 20 tokens per seconde op de CPU. Dit is prima bruikbaar voor interacties in chatvorm.

16 GB: voor de meeste mensen precies genoeg

Met 16 GB kun je 7B- en 8B-modellen met een hogere kwantisering (Q8 voor betere kwaliteit) en 13B- tot 14B-modellen met Q4 gebruiken. Dit is waar modellen als Llama 3.1 8B, Qwen 3 8B en DeepSeek-R1-Distill 14B praktisch toepasbaar worden. Je krijgt ook voldoende ruimte om het besturingssysteem en andere apps naast het model te draaien zonder dat alles tot stilstand komt.

Voor de meeste mensen die met lokale AI experimenteren, is 16 GB DDR5 een realistische startcapaciteit. Je zult goede resultaten behalen met de populairste open-source modellen en je zult niet voortdurend te maken hebben met geheugenbeperkingen.

32 GB: Krachtige lokale AI

Met 32 GB kun je zonder problemen modellen met 32 miljard parameters draaien en modellen met 70 miljard parameters met sterke kwantisering (Q2 of Q3). Modellen zoals Qwen 3 32B, DeepSeek-R1-Distill 32B en Gemma 3 27B passen hier goed bij. Deze modellen bieden merkbaar betere redeneringen, langere samenhangende outputs en sterkere prestaties bij complexe taken in vergelijking met hun kleinere tegenhangers.

Als je lokale LLM’s gebruikt voor ontwikkelingswerk, schrijfhulp of andere taken waarbij de kwaliteit van de output van belang is, begint de ervaring pas echt goed aan te voelen vanaf 32 GB. Een kit zoals de CORSAIR VENGEANCE DDR5 64 GB (2x32 GB) met 6000 MT/s biedt je de capaciteit en bandbreedte om deze taken zonder concessies uit te voeren.

64 GB en meer: grote modellen draaien

Als je modellen met 70 miljard parameters wilt draaien op redelijke kwantisatieniveaus (Q4 of Q5), heb je 64 GB systeem-RAM nodig, en idealiter een opstelling met meerdere GPU’s of een systeem dat gedeeltelijke GPU-offloading ondersteunt. Llama 3.3 70B op Q4 vereist ongeveer 42 GB alleen al voor de modelgewichten, nog afgezien van de contextwindow en de overhead van het besturingssysteem.

Op dit niveau wordt de geheugenbandbreedte nog belangrijker. Bij elke generatie van tokens moeten tientallen gigabytes aan gewichten worden doorlopen, en sneller RAM-geheugen leidt direct tot snellere resultaten. Dit is een opstelling van werkstationklasse, maar het komt steeds vaker voor bij professionals die gevoelige gegevens op het apparaat zelf willen bewaren terwijl ze werken met open modellen van de allernieuwste generatie.

Waarom de snelheid van het RAM-geheugen belangrijk is, en niet alleen de capaciteit

Dit zal voor veel mensen een verrassing zijn: bij lokale LLM-inferentie is geheugenbandbreedte vaak belangrijker dan pure rekenkracht. Nadat het eerste token is gegenereerd (wat rekenintensief is), is elk volgend token geheugenintensief. Het model moet voor elk token zijn volledige gewichtset door de processor sturen, en de snelheid van dat doorsturen wordt bepaald door je geheugenbandbreedte.

Praktijktests laten het verschil duidelijk zien. Het is aangetoond dat de overstap van DDR5-4800 naar DDR5-6000 de snelheid van het genereren van tokens met 20 tot 23 procent verbetert voor modellen als Mistral 7B en Llama 3.1 8B die op een CPU draaien. Dat is een aanzienlijke, merkbare verbetering in de reactiesnelheid, die uitsluitend te danken is aan sneller geheugen.

Ook dual-channel-configuraties zijn van groot belang. Door twee RAM-modules in dual-channel-modus te gebruiken, verdubbelt de beschikbare bandbreedte in feite ten opzichte van één enkele module. In de praktijk kan dat een 30 tot 50 procent snellere inferentie opleveren. Als je een systeem voor lokale AI bouwt of upgradet, gebruik dan altijd twee modules in dual-channel-modus, en nooit slechts één DIMM.

Kwantificering: hoe grotere modellen in minder geheugen passen

Kwantificering is de techniek die lokale LLM’s bruikbaar maakt op consumentenhardware. Hierbij worden de modelgewichten gecomprimeerd van hun oorspronkelijke 16-bits drijvende-kommagetal (FP16) naar kleinere representaties, meestal 4-bits (Q4), 5-bits (Q5) of 8-bits (Q8). De afweging is een lichte vermindering van de uitvoerkwaliteit in ruil voor een enorme vermindering van de geheugenvereisten.

Bij Q4_K_M-kwantisering (het meest gangbare formaat voor lokaal gebruik) neemt de bestandsgrootte van een 8B-model af van ongeveer 16 GB tot zo’n 5 à 6 GB. Een 70B-model gaat van 140 GB naar ongeveer 40 à 42 GB. Dat is een besparing van 75 procent aan opslagruimte, en in de meeste praktische toepassingen is het verschil in kwaliteit nauwelijks merkbaar.

Q5_K_M biedt een iets betere kwaliteit tegen ongeveer 15 tot 20 procent hogere geheugenkosten, en is het overwegen waard als je daar de ruimte voor hebt. Q8 behoudt vrijwel de volledige kwaliteit van het oorspronkelijke model, maar halveert de geheugenvereisten slechts; dit is de juiste keuze als je over voldoende geheugen beschikt en de best mogelijke uitvoer wilt.

Tools zoals Ollama en LM Studio ondersteunen kwantiseerde modellen standaard, dus je hoeft zelf geen conversie uit te voeren. Kies gewoon het kwantisatieniveau dat past bij je beschikbare geheugen.

Contextlengte: de verborgen geheugenkosten

Elk stukje context (de tekst die je naar het model stuurt plus de tekst die het genereert) vereist extra geheugen, bovenop de modelgewichten zelf. Korte gesprekken zijn geen probleem, maar als je lange documenten invoert of uitgebreide chatgeschiedenissen bijhoudt, kan het contextgeheugen snel oplopen.

Als ruwe schatting geldt dat 8K contexttokens ongeveer 1 GB extra geheugen vereisen per 10 miljard parameters. Als je dat opschroeft naar 32K tokens, kom je uit op nog eens 4 GB extra. Sommige nieuwere modellen ondersteunen 128K tokens of meer, waardoor je totale geheugenbehoefte in feite kan verdubbelen.

Als u van plan bent regelmatig met lange contexten te werken, bijvoorbeeld door volledige codebases of omvangrijke documenten in een model in te voeren, moet u rekening houden met extra geheugenbehoefte bovenop wat de modelgewichten alleen al vereisen. Dit is nog een reden waarom configuraties van 32 GB of 64 GB zinvol zijn voor serieus lokaal AI-gebruik.

Populaire modellen en wat ze nodig hebben

Hier volgt een beknopt overzicht van enkele van de momenteel meest gebruikte lokale modellen, met vermelding van de geschatte benodigde geheugencapaciteit bij Q4_K_M-kwantisering:

- Phi-4 Mini (3,8 GHz): ~2,3 GB, werkt uitstekend op vrijwel elk apparaat

- Qwen 3.5 4B: ~3,4 GB, uitstekend geschikt voor lichte taken met krachtige redeneringen

- Llama 3.2 8B: ~5 GB, betrouwbaar klein model voor algemeen gebruik

- Qwen 3 8B: ~5 GB, uitstekende prestaties op het gebied van meertaligheid en redeneren

- Qwen 3.5 9B: ~6,6 GB, het nieuwste kleine model met verbeterde mogelijkheden

- DeepSeek-R1-Distill 14B: ~9 GB, uitstekende redeneercapaciteit in een compact formaat

- Gemma 3 12B: ~8 GB, de efficiënte middenklasse-optie van Google

- Llama 4 Scout (109 miljard MoE, 17 miljard actief): ~10 GB bij agressieve kwantisering, Meta’s nieuwste model, presteert verrassend goed dankzij de MoE-architectuur

- Qwen 3.5 27B: ~17 GB, krachtige allrounder die past in 24 GB VRAM

- Qwen 3 32B: ~20 GB, krachtige prestaties, past in 24 GB VRAM

- Qwen 3.5 35B-A3B (MoE): ~24 GB, in totaal 35B maar slechts 3B actief per token, zeer efficiënt

- Llama 3.3 70B: ~42 GB, bijna-frontier-kwaliteit, vereist veel RAM

- DeepSeek-R1-Distill 70B: ~42 GB, geavanceerde redeneringsmogelijkheden voor lokaal gebruik

- GPT-OSS 120B: ~63 GB, het open-weight-model van OpenAI, vereist minimaal 64 GB unified of systeem-RAM

- Qwen 3.5 122B-A10B (MoE): ~81 GB, vlaggenschipklasse met slechts 10 miljard actieve parameters

Deze cijfers hebben uitsluitend betrekking op de modelgewichten bij Q4_K_M-kwantisering. Reken 2 tot 8 GB extra voor contextgegevens, overhead van het besturingssysteem en eventuele andere applicaties die je tegelijkertijd draait. MoE-modellen (Mixture of Experts), zoals Llama 4 Scout en Qwen 3.5 35B-A3B, zijn bijzonder geheugenefficiënt tijdens de inferentie, omdat per token slechts een fractie van hun totale parameters actief is.

Het juiste geheugen kiezen voor lokale AI

Op basis van het bovenstaande kun je als volgt nadenken over je geheugenconfiguratie voor lokale LLM’s:

Kies voor DDR5 als je platform dit ondersteunt. Het voordeel in bandbreedte ten opzichte van DDR4 is reëel en heeft een directe invloed op de inferentiesnelheid. DDR5-6000 of sneller biedt de ideale balans tussen prijs, compatibiliteit en prestaties voor AI-workloads.

Gebruik altijd dual-channel. Bij LLM-inferentie presteren twee RAM-modules aanzienlijk beter dan één module met dezelfde totale capaciteit. Een set van 2 x 16 GB presteert qua tokens per seconde aanzienlijk beter dan één module van 32 GB.

Kies de juiste hoeveelheid geheugen voor de modellen die je wilt draaien. Als je vooral experimenteert met modellen van 7B tot 8B, is 16 GB voldoende. Als je modellen van 14B tot 32B wilt draaien of ruimte wilt houden voor toekomstige modellen, is 32 GB een betere keuze. En als je modellen van 70B op het oog hebt, ga dan uit van 64 GB.

Voor een systeem dat de huidige lokale AI-modellen goed aankan en ruimte biedt om uit te breiden, is een set als de CORSAIR VENGEANCE DDR5 64 GB (2x32 GB) met 6000 MT/s of 6400 MT/s moeilijk te overtreffen. Je krijgt de capaciteit voor grote modellen, de bandbreedte voor snelle inferentie en de dual-channelconfiguratie die ervoor zorgt dat alles efficiënt werkt. Als je een compactere opstelling bouwt die gericht is op kleinere modellen, is een 32GB (2x16GB) DDR5-6000-kit een solide en kosteneffectief startpunt.

Speciaal ontworpen voor lokale AI: de CORSAIR AI WORKSTATION 300

Als je serieus van plan bent om lokaal met grote modellen te werken en geen tower met meerdere GPU’s wilt bouwen, biedt de CORSAIR AI WORKSTATION 300 een andere aanpak. Het is gebouwd rond AMD's Ryzen AI MAX+ 395-processor met een geïntegreerde Radeon 8060S GPU die toegang heeft tot maximaal 96 GB VRAM uit het 128 GB LPDDR5X-8000-geheugen van het systeem. Die capaciteit maakt het interessant voor lokale AI: een enkele discrete consumenten-GPU heeft tegenwoordig maximaal 32 GB VRAM, dus het laden van bijvoorbeeld GPT-OSS 120B (ongeveer 63 GB bij MXFP4) op één kaart is niet mogelijk zonder het model over meerdere GPU's te verdelen of naar het systeem-RAM te offloaden.

De unified memory-architectuur vormt de belangrijkste afweging. Je geeft de ruwe bandbreedte van dedicated GDDR7 VRAM op, maar in ruil daarvoor krijg je tot 96 GB aan voor de GPU toegankelijk geheugen met LPDDR5X-snelheden. Dat betekent dat modellen in het parameterbereik van 70B tot 120B, waarvoor anders meerdere discrete GPU's of zware CPU-offloading nodig zouden zijn, volledig via het GPU-geheugenpad op één machine kunnen draaien, zonder lagen over kaarten te verdelen of gewichten via PCIe te pagineren.

Het systeem is bovendien uitgerust met AMD’s XDNA 2 NPU met 50 TOPS aan AI-versnelling voor lichtere taken, 2,5 Gbps Ethernet, Wi-Fi 6E en meerdere USB 4.0-poorten. Voor professionals die werken met gevoelige gegevens – bijvoorbeeld in de juridische, medische of financiële sector – biedt het een aanzienlijk praktisch voordeel om over dit niveau van AI-capaciteit te beschikken, volledig offline en op locatie.

De CORSAIR AI-softwarestack

Het correct installeren en configureren van lokale AI-tools kan een van de meest frustrerende aspecten van het hele proces zijn, met conflicten tussen afhankelijkheden, verschillende stuurprogrammaversies en compatibiliteitsproblemen met frameworks. De CORSAIR AI Software Stack is een hulpprogramma met stapsgewijze instructies dat is ontworpen om die hindernissen weg te nemen. Het helpt je bij het kiezen en installeren van de juiste tools voor je systeem, van AI- en machine learning-frameworks tot ontwikkelomgevingen en creatieve software, allemaal afgestemd op jouw hardware.

JOIN OUR OFFICIAL CORSAIR COMMUNITIES

Join our official CORSAIR Communities! Whether you're new or old to PC Building, have questions about our products, or want to chat about the latest PC, tech, and gaming trends, our community is the place for you.