BLOG

Memoria pentru modelele lingvistice locale: De câtă memorie RAM ai nevoie? (și când viteza contează)

Ultima actualizare:

Rularea unui model lingvistic de mari dimensiuni pe propriul echipament este una dintre cele mai practice aplicații ale IA în acest moment. Fie că experimentezi cu asistenți de programare, creezi un chatbot privat sau ești pur și simplu curios să afli ce pot face modelele open-source, o întrebare se pune imediat: de câtă memorie am nevoie, de fapt?

Răspunsul depinde de modelul pe care doriți să îl rulați, de modul în care intenționați să îl rulați și de faptul dacă vă interesează mai mult să realizați o estimare a modelului sau să obțineți rezultate rapide și eficiente. Capacitatea memoriei vă permite să începeți. Viteza memoriei determină cât de plăcută este experiența odată ce ați început.

De ce memoria reprezintă punctul slab

Când rulați un model lingvistic de mari dimensiuni la nivel local, întregul model trebuie să rămână în memorie pe durata generării textului. Spre deosebire de jocurile video sau de editare video, unde datele intră și ies din memorie în funcție de necesități, inferența LLM încarcă întregul set de ponderi ale modelului și le menține în memorie. Fiecare token generat de model necesită o trecere prin aceste ponderi.

Astfel, capacitatea memoriei devine limita maximă. Dacă nu dispui de suficientă memorie RAM sau VRAM pentru a stoca modelul, fie nu îl poți rula deloc, fie o parte din model va fi transferată pe un spațiu de stocare mai lent, ceea ce va afecta dramatic performanța. În unele cazuri, vorbim de o încetinire de 5 până la 30 de ori.

Însă capacitatea reprezintă doar jumătate din poveste. Odată ce modelul încape în memorie, viteza cu care sistemul poate transmite aceste ponderi către procesor devine principalul factor care limitează viteza de generare a token-urilor. Aceasta este lățimea de bandă a memoriei, iar acesta este motivul pentru care viteza și configurația memoriei RAM contează mai mult pentru IA locală decât pentru aproape orice altă sarcină de lucru pe un computer desktop.

RAM vs VRAM: Care dintre ele contează?

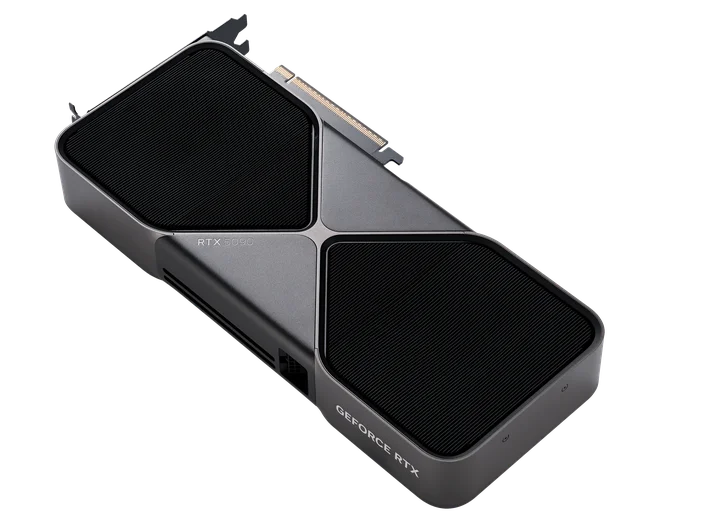

Dacă dispui de un procesor grafic dedicat cu suficientă memorie VRAM, aceasta este cea mai rapidă soluție. Memoria procesorului grafic (VRAM) are o lățime de bandă mult mai mare decât memoria RAM a sistemului; un procesor grafic modern, precum RTX 4090 sau RTX 5090, poate oferi o lățime de bandă de memorie de peste 1 TB/s, în timp ce chiar și memoria RAM DDR5 rapidă atinge o limită maximă de aproximativ 90 GB/s într-o configurație tipică de desktop cu două canale.

Această diferență de lățime de bandă explică de ce un model care încape în întregime în memoria VRAM poate genera 40 sau mai multe token-uri pe secundă, în timp ce același model rulat din memoria RAM a sistemului poate genera între 8 și 15 token-uri pe secundă pe o configurație cu procesor rapid. Ambele variante sunt funcționale, dar diferența în ceea ce privește viteza de răspuns este evidentă.

Problema este că plăcile grafice destinate consumatorilor au o capacitate maximă de 24 GB de VRAM (pe plăci precum RTX 4090 și RTX 5090), ceea ce te limitează la modele de aproximativ 14 miliarde de parametri la o calitate bună sau până la aproximativ 32 de miliarde cu o cuantificare agresivă. Dacă doriți să rulați modele mai mari, de 70 de miliarde de parametri și mai mult, probabil va trebui să vă bazați pe memoria RAM a sistemului, să utilizați mai multe GPU-uri sau să acceptați un compromis de performanță cu descărcarea parțială.

De câtă memorie RAM ai nevoie? O analiză practică

Aici lucrurile devin mai concrete. Cantitatea de memorie necesară unui model depinde de numărul său de parametri și de precizia (nivelul de cuantificare) la care îl rulați. O regulă generală: la o cuantificare de nivel Q4 (4 biți), vă puteți aștepta să aveți nevoie de aproximativ 0,5 până la 0,6 GB pe miliard de parametri, plus spațiul suplimentar necesar pentru context și sistemul de operare.

8 GB: Nivel de bază

Cu o memorie totală de sistem (sau VRAM) de 8 GB, puteți rula fără probleme modele de dimensiuni reduse, cu un număr de parametri cuprins între 1B și 7B, folosind cuantificarea pe 4 biți. Printre acestea se numără modele precum Llama 3.2 3B, Phi-4 Mini, Qwen 3 4B și Mistral 7B (la Q4). Acestea sunt surprinzător de capabile pentru sarcini precum rezumarea, generarea de cod simplu și întrebări și răspunsuri conversaționale.

Pe un GPU performant, puteți obține aproximativ 40–50 de tokenuri pe secundă, iar pe un procesor (CPU) – 15–20 de tokenuri pe secundă. Este perfect adecvat pentru interacțiuni de tip chat.

16 GB: capacitatea ideală pentru majoritatea oamenilor

Cei 16 GB permit rularea modelelor de 7B și 8B la un nivel de cuantificare mai ridicat (Q8 pentru o calitate superioară) și a modelelor de 13B până la 14B la Q4. Aici devin viabile modele precum Llama 3.1 8B, Qwen 3 8B și DeepSeek-R1-Distill 14B. De asemenea, beneficiați de suficient spațiu pentru a rula sistemul de operare și alte aplicații alături de model, fără ca totul să se blocheze.

Pentru majoritatea celor care experimentează cu IA locală, 16 GB de memorie DDR5 reprezintă un punct de plecare realist. Veți obține rezultate bune cu cele mai populare modele open-source și nu veți simți că sunteți în permanență limitați de memorie.

32 GB: Inteligență artificială locală performantă

Cu 32 GB, poți rula fără probleme modele cu 32 de miliarde de parametri și modele de 70 de miliarde de parametri cu cuantificare intensă (Q2 sau Q3). Modele precum Qwen 3 32B, DeepSeek-R1-Distill 32B și Gemma 3 27B se potrivesc bine aici. Aceste modele oferă un raționament vizibil mai bun, rezultate coerente mai lungi și performanțe mai puternice la sarcini complexe, comparativ cu omologii lor mai mici.

Dacă folosești modele lingvistice mari (LLM) locale pentru activități de dezvoltare, asistență la redactare sau orice altceva în care calitatea rezultatelor contează, abia de la 32 GB experiența începe să fie cu adevărat plăcută. Un kit precum CORSAIR VENGEANCE DDR5 de 64 GB (2x32 GB) la 6000 MT/s îți oferă capacitatea și lățimea de bandă necesare pentru a gestiona aceste sarcini fără compromisuri.

64 GB și mai mult: rularea modelelor de mari dimensiuni

Dacă doriți să rulați modele cu 70 de miliarde de parametri la niveluri rezonabile de cuantificare (Q4 sau Q5), veți avea nevoie de 64 GB de memorie RAM de sistem și, în mod ideal, de o configurație cu mai multe GPU-uri sau de un sistem care să suporte descărcarea parțială a sarcinilor pe GPU. Modelul Llama 3.3 70B la Q4 necesită aproximativ 42 GB doar pentru greutățile modelului, fără a lua în calcul fereastra de context și suprasarcina sistemului de operare.

La acest nivel, lățimea de bandă a memoriei devine și mai importantă. Fiecare generare de tokenuri necesită procesarea a zeci de gigaocteți de greutăți, iar o memorie RAM mai rapidă se traduce direct într-o viteză mai mare de procesare. Aceasta este o configurație de tip stație de lucru, dar devine din ce în ce mai obișnuită în rândul profesioniștilor care doresc să păstreze datele sensibile pe dispozitiv în timp ce lucrează cu modele deschise de ultimă generație.

De ce contează viteza memoriei RAM, nu doar capacitatea

Iată un aspect care surprinde pe mulți: în cazul inferenței locale LLM, lățimea de bandă a memoriei este adesea mai importantă decât puterea brută de calcul. După generarea primului token (proces care depinde de puterea de calcul), fiecare token ulterior depinde de memoria disponibilă. Modelul trebuie să transmită în flux întregul set de ponderi prin procesor pentru fiecare token, iar viteza acestui flux este limitată de lățimea de bandă a memoriei.

Testele de performanță din condiții reale evidențiază clar diferența. S-a demonstrat că trecerea de la DDR5-4800 la DDR5-6000 îmbunătățește viteza de generare a token-urilor cu 20-23% pentru modele precum Mistral 7B și Llama 3.1 8B care rulează pe procesor. Aceasta reprezintă o îmbunătățire semnificativă și vizibilă a vitezei de răspuns, care se datorează exclusiv unei memorii mai rapide.

Configurațiile dual-channel au, de asemenea, o importanță enormă. Utilizarea a două module de memorie RAM în modul dual-channel dublează efectiv lățimea de bandă disponibilă în comparație cu un singur modul. În practică, acest lucru poate însemna o viteză de inferență cu 30 până la 50% mai mare. Dacă construiți sau modernizați un sistem pentru IA locală, folosiți întotdeauna două module în modul dual-channel, niciodată un singur modul DIMM.

Cuantificare: Cum să încapă modele mai mari într-un spațiu de memorie mai redus

Cuantificarea este tehnica care face ca modelele LLM locale să fie utilizabile pe echipamente destinate consumatorilor. Aceasta comprimă ponderile modelului de la formatul inițial în virgulă mobilă pe 16 biți (FP16) la reprezentări mai mici, de obicei pe 4 biți (Q4), 5 biți (Q5) sau 8 biți (Q8). Compromisul constă într-o ușoară scădere a calității rezultatelor în schimbul unei reduceri semnificative a cerințelor de memorie.

La cuantificarea Q4_K_M (cel mai popular format pentru utilizarea locală), un model de 8 miliarde de parametri scade de la aproximativ 16 GB la aproximativ 5–6 GB. Un model de 70 de miliarde de parametri scade de la 140 GB la aproximativ 40–42 GB. Aceasta reprezintă o reducere de 75% a spațiului de memorie, iar în majoritatea cazurilor practice diferența de calitate este aproape imperceptibilă.

Q5_K_M oferă o calitate ușor superioară, la un cost de memorie cu aproximativ 15–20% mai mare, și merită luat în considerare dacă dispuneți de resurse suficiente. Q8 păstrează aproape în totalitate calitatea modelului original, dar reduce cerințele de memorie doar la jumătate; este alegerea potrivită atunci când dispuneți de memorie suficientă și doriți cel mai bun rezultat posibil.

Instrumentele precum Ollama și LM Studio gestionează nativ modelele cuantificate, așa că nu este nevoie să efectuați nicio conversie manual. Trebuie doar să alegeți nivelul de cuantificare care se potrivește cu memoria de care dispuneți.

Lungimea contextului: costul ascuns al memoriei

Fiecare unitate de context (textul pe care îl trimiți modelului plus textul generat de acesta) necesită memorie suplimentară, pe lângă greutățile propriu-zise ale modelului. Conversațiile scurte nu reprezintă o problemă, dar dacă introduci documente lungi sau păstrezi istoricul extins al conversațiilor, memoria de context se poate umple rapid.

Ca orientare generală, 8.000 de tokenuri de context adaugă aproximativ 1 GB la fiecare 10 miliarde de parametri. Dacă crești această valoare la 32.000 de tokenuri, ajungi la încă 4 GB. Unele modele mai noi acceptă 128.000 de tokenuri sau mai mult, ceea ce poate dubla efectiv cerințele totale de memorie.

Dacă intenționați să utilizați în mod regulat contexte extinse, de exemplu, introducând baze de cod întregi sau documente voluminoase într-un model, asigurați-vă că dispuneți de memorie suplimentară, peste cea necesară doar pentru greutățile modelului. Acesta este un alt motiv pentru care configurațiile de 32 GB sau 64 GB sunt recomandate pentru utilizarea intensivă a IA la nivel local.

Modele populare și ce le trebuie

Iată un ghid succint pentru unele dintre cele mai utilizate modele locale în prezent, care prezintă memoria aproximativă necesară la cuantificarea Q4_K_M:

- Phi-4 Mini (3,8 GHz): ~2,3 GB, funcționează excelent pe aproape orice

- Qwen 3.5 4B: ~3,4 GB, excelent pentru sarcini ușoare, cu capacități puternice de raționament

- Llama 3.2 8B: ~5 GB, model mic, fiabil, de uz general

- Qwen 3 8B: ~5 GB, performanțe remarcabile în domeniul multilingvismului și al raționamentului

- Qwen 3.5 9B: ~6,6 GB, cel mai recent model de dimensiuni reduse, cu capacități îmbunătățite

- DeepSeek-R1-Distill 14B: ~9 GB, capacitate excelentă de raționament într-un format compact

- Gemma 3 12B: ~8 GB, opțiunea eficientă de dimensiuni medii de la Google

- Llama 4 Scout (109B MoE, 17B active): ~10 GB la cuantificare agresivă, cea mai recentă versiune de la Meta, funcționează surprinzător de bine datorită arhitecturii MoE

- Qwen 3.5 27B: ~17 GB, o placă video versatilă și performantă, compatibilă cu 24 GB VRAM

- Qwen 3 32B: ~20 GB, performanțe ridicate, compatibil cu 24 GB VRAM

- Qwen 3.5 35B-A3B (MoE): ~24 GB, 35B în total, dar doar 3B activi per token, foarte eficient

- Llama 3.3 70B: ~42 GB, calitate aproape de cea de ultimă generație, necesită o cantitate considerabilă de memorie RAM

- DeepSeek-R1-Distill 70B: ~42 GB, capacități de raționament de vârf pentru utilizare locală

- GPT-OSS 120B: ~63 GB, modelul cu pondere deschisă al OpenAI, necesită cel puțin 64 GB de memorie RAM unificată sau de sistem

- Qwen 3.5 122B-A10B (MoE): ~81 GB, model de vârf cu doar 10 miliarde de parametri activi

Aceste cifre se referă exclusiv la greutățile modelelor la nivelul de cuantificare Q4_K_M. Adăugați între 2 și 8 GB pentru context, resursele consumate de sistemul de operare și orice alte aplicații pe care le rulați în paralel. Modelele MoE (Mixture of Experts), precum Llama 4 Scout și Qwen 3.5 35B-A3B, sunt deosebit de eficiente din punct de vedere al consumului de memorie în timpul inferenței, deoarece doar o fracțiune din parametrii lor totali este activă pentru fiecare token.

Alegerea memoriei potrivite pentru IA locală

Având în vedere toate cele menționate mai sus, iată cum ar trebui să abordați configurarea memoriei pentru modelele LLM locale:

Alege DDR5 dacă platforma ta îl suportă. Avantajul în ceea ce privește lățimea de bandă față de DDR4 este real și are un impact direct asupra vitezei de inferență. DDR5-6000 sau o variantă mai rapidă reprezintă echilibrul perfect între preț, compatibilitate și performanță pentru sarcinile de lucru din domeniul IA.

Folosiți întotdeauna configurația dual-channel. Două module de memorie RAM vor oferi performanțe semnificativ mai bune decât un singur modul de aceeași capacitate totală în cazul inferenței LLM. Un kit de 2x16 GB depășește cu mult un singur modul de 32 GB în ceea ce privește numărul de tokeni pe secundă.

Dimensiunea necesară pentru modelele pe care doriți să le rulați. Dacă experimentați în principal cu modele de 7B până la 8B, 16 GB sunt suficienți. Dacă doriți să rulați modele de 14B până la 32B sau să păstrați o marjă de manevră pentru modelele viitoare, 32 GB reprezintă opțiunea recomandată. Iar dacă aveți în vedere modele de 70B, optați pentru 64 GB.

Pentru un sistem care gestionează bine modelele locale actuale de IA și oferă posibilități de extindere, un kit precum CORSAIR VENGEANCE DDR5 de 64 GB (2x32 GB) la 6000 MT/s sau 6400 MT/s este greu de întrecut. Beneficiați de capacitatea necesară pentru modele mari, de lățimea de bandă pentru inferență rapidă și de configurația dual-channel care asigură funcționarea eficientă a întregului sistem. Dacă construiți o configurație mai compactă, axată pe modele mai mici, un kit DDR5-6000 de 32 GB (2x16 GB) reprezintă un punct de plecare solid și rentabil.

Conceput special pentru IA locală: CORSAIR AI WORKSTATION 300

Dacă îți dorești cu adevărat să rulezi local modele de mari dimensiuni și nu vrei să construiești un sistem tower cu mai multe plăci grafice, CORSAIR AI WORKSTATION 300 adoptă o abordare diferită. Este construit în jurul procesorului AMD Ryzen AI MAX+ 395 cu un GPU integrat Radeon 8060S care poate accesa până la 96 GB de VRAM din memoria de 128 GB LPDDR5X-8000 a sistemului. Această capacitate este ceea ce îl face interesant pentru IA locală: un singur GPU discret de consum atinge astăzi o limită maximă de 32 GB de VRAM, astfel încât încărcarea unui model precum GPT-OSS 120B (aproximativ 63 GB la MXFP4) pe o singură placă nu este posibilă fără a împărți modelul pe mai multe GPU-uri sau fără a-l descărca în memoria RAM a sistemului.

Arhitectura de memorie unificată reprezintă compromisul esențial. Renunțați la lățimea de bandă brută a memoriei VRAM GDDR7 dedicate, dar în schimb obțineți până la 96 GB de memorie accesibilă GPU-ului la viteze LPDDR5X. Asta înseamnă că modelele din intervalul de parametri 70B-120B, care altfel ar necesita mai multe GPU-uri discrete sau o descărcare intensă a CPU-ului, pot rula în întregime pe calea de memorie a GPU-ului pe o singură mașină, fără a împărți straturile între plăci sau a pagina greutățile prin PCIe.

Sistemul include, de asemenea, unitatea de procesare a inteligenței artificiale (NPU) XDNA 2 de la AMD, cu o capacitate de accelerare AI de 50 TOPS pentru sarcini mai ușoare, o conexiune Ethernet de 2,5 Gbps, Wi-Fi 6E și mai multe porturi USB 4.0. Pentru profesioniștii care lucrează cu date sensibile – din domeniile juridic, medical sau financiar –, faptul că dispun de acest nivel de capacitate AI complet offline și la sediu reprezintă un avantaj practic semnificativ.

Suita de programe CORSAIR AI

Instalarea și configurarea corectă a instrumentelor locale de IA poate fi una dintre cele mai frustrante părți ale procesului, din cauza conflictelor de dependențe, a versiunilor driverelor și a compatibilității framework-urilor. CORSAIR AI Software Stack este un instrument de configurare asistată, conceput pentru a elimina aceste dificultăți. Acesta te ajută să alegi și să instalezi instrumentele potrivite pentru sistemul tău, de la framework-uri de IA și învățare automată până la medii de dezvoltare și software creativ, toate adaptate hardware-ului tău.

JOIN OUR OFFICIAL CORSAIR COMMUNITIES

Join our official CORSAIR Communities! Whether you're new or old to PC Building, have questions about our products, or want to chat about the latest PC, tech, and gaming trends, our community is the place for you.