BLOG

Speicher für lokale LLMs: Wie viel RAM benötigt man? (und wann es auf Geschwindigkeit ankommt)

Letzte Aktualisierung:

Ein großes Sprachmodell auf der eigenen Hardware auszuführen, gehört derzeit zu den praktischsten Anwendungsmöglichkeiten von KI. Ganz gleich, ob Sie mit Programmierassistenten experimentieren, einen privaten Chatbot entwickeln oder einfach nur neugierig sind, was Open-Source-Modelle leisten können – eine Frage stellt sich sofort: Wie viel Arbeitsspeicher brauche ich eigentlich?

Die Antwort hängt davon ab, welches Modell Sie ausführen möchten, wie Sie dies tun wollen und ob Ihnen die Anpassung des Modells wichtiger ist oder eine schnelle, reaktionsschnelle Ausgabe. Die Speicherkapazität verschafft Ihnen den Zugang. Die Speichergeschwindigkeit entscheidet darüber, wie gut sich die Erfahrung anfühlt, sobald Sie drinnen sind.

Warum der Speicher den Engpass darstellt

Wenn Sie ein großes Sprachmodell lokal ausführen, muss das gesamte Modell während der Textgenerierung im Arbeitsspeicher verbleiben. Anders als bei Spielen oder der Videobearbeitung, wo Daten je nach Bedarf in den Arbeitsspeicher geladen und wieder daraus entnommen werden, werden bei der LLM-Inferenz die gesamten Modellgewichte geladen und dort gespeichert. Jedes einzelne Token, das das Modell generiert, muss diese Gewichte durchlaufen.

Damit ist die Speicherkapazität der entscheidende Engpass. Wenn Sie nicht über genügend RAM oder VRAM verfügen, um das Modell zu speichern, können Sie es entweder gar nicht ausführen oder es kommt dazu, dass ein Teil des Modells auf langsameren Speicher ausgelagert wird, was die Leistung drastisch beeinträchtigt. In manchen Fällen ist das Modell dann 5- bis 30-mal langsamer.

Doch die Kapazität ist nur die halbe Wahrheit. Sobald das Modell in den Arbeitsspeicher passt, wird die Geschwindigkeit, mit der Ihr System diese Gewichte an den Prozessor weiterleiten kann, zum entscheidenden Faktor dafür, wie schnell die Token ausgegeben werden. Das ist die Speicherbandbreite, und deshalb sind RAM-Geschwindigkeit und -Konfiguration für lokale KI wichtiger als für fast jede andere Desktop-Anwendung.

RAM vs. VRAM: Was ist wichtiger?

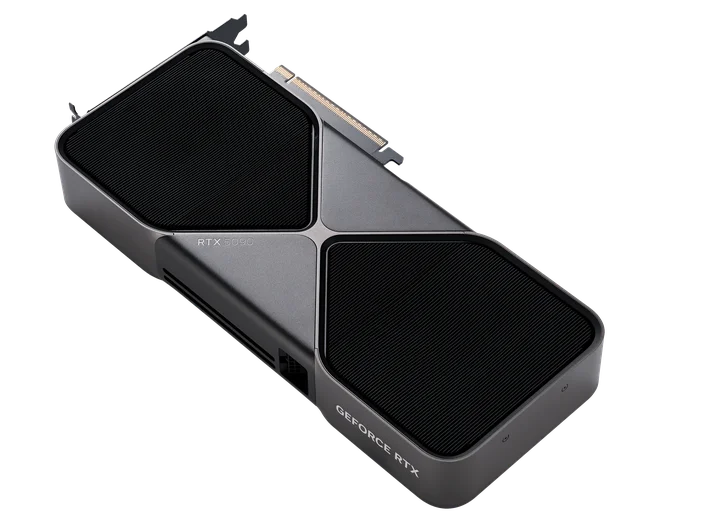

Wenn Sie über eine dedizierte GPU mit ausreichend VRAM verfügen, ist dies der schnellste Weg. Der GPU-Speicher (VRAM) verfügt über eine weitaus höhere Bandbreite als der System-RAM: Eine moderne GPU wie die RTX 4090 oder RTX 5090 kann eine Speicherbandbreite von über 1 TB/s liefern, während selbst schneller DDR5-System-RAM in einer typischen Dual-Channel-Desktop-Konfiguration bei etwa 90 GB/s seine Obergrenze erreicht.

Aufgrund dieser Bandbreitenlücke kann ein Modell, das vollständig in den VRAM passt, 40 oder mehr Token pro Sekunde generieren, während dasselbe Modell, das vom System-RAM aus ausgeführt wird, auf einer schnellen CPU-Konfiguration nur 8 bis 15 Token pro Sekunde schafft. Beide Varianten sind brauchbar, doch der Unterschied in der Reaktionsgeschwindigkeit ist spürbar.

Der Haken daran ist, dass Consumer-GPUs (bei Karten wie der RTX 4090 und RTX 5090) maximal 24 GB VRAM bieten, was Sie auf Modelle mit etwa 14 Milliarden Parametern bei guter Qualität oder auf bis zu etwa 32 Milliarden bei aggressiver Quantisierung beschränkt. Wenn Sie größere Modelle mit 70 Milliarden Parametern und mehr ausführen möchten, müssen Sie wahrscheinlich auf den System-RAM zurückgreifen, mehrere GPUs verwenden oder bei teilweiser Auslagerung gewisse Leistungseinbußen in Kauf nehmen.

Wie viel RAM brauchst du? Eine praktische Übersicht

Hier wird es konkret. Der Speicherbedarf eines Modells hängt von der Anzahl seiner Parameter und der Genauigkeit (Quantisierungsstufe) ab, mit der es ausgeführt wird. Als grobe Faustregel gilt: Bei einer Quantisierung von Q4 (4 Bit) ist mit etwa 0,5 bis 0,6 GB pro Milliarde Parameter zu rechnen, zuzüglich des Overheads für den Kontext und das Betriebssystem.

8 GB: Einstiegsmodell

Mit insgesamt 8 GB Systemspeicher (bzw. VRAM) lassen sich kleine Modelle im Parameterbereich von 1B bis 7B unter Verwendung einer 4-Bit-Quantisierung problemlos ausführen. Dazu gehören Modelle wie Llama 3.2 3B, Phi-4 Mini, Qwen 3 4B und Mistral 7B (bei Q4). Diese Modelle sind überraschend leistungsfähig für Aufgaben wie Zusammenfassungen, einfache Codegenerierung und dialogorientierte Fragen und Antworten.

Auf einer leistungsfähigen GPU sind etwa 40 bis 50 Token pro Sekunde zu erwarten, auf der CPU sind es 15 bis 20 Token pro Sekunde. Das reicht für Interaktionen im Chat-Stil völlig aus.

16 GB: Für die meisten Menschen genau das Richtige

16 GB ermöglichen den Einsatz von 7B- und 8B-Modellen mit höherer Quantisierungsstufe (Q8 für bessere Qualität) sowie von 13B- bis 14B-Modellen bei Q4. Hier kommen Modelle wie Llama 3.1 8B, Qwen 3 8B und DeepSeek-R1-Distill 14B zum Einsatz. Außerdem erhalten Sie genügend Spielraum, um das Betriebssystem und andere Anwendungen parallel zum Modell auszuführen, ohne dass alles zum Stillstand kommt.

Für die meisten, die sich mit lokaler KI beschäftigen, sind 16 GB DDR5 ein realistischer Ausgangspunkt. Damit erzielen Sie mit den gängigsten Open-Source-Modellen gute Ergebnisse und werden nicht ständig mit Speicherengpässen zu kämpfen haben.

32 GB: Leistungsstarke lokale KI

Mit 32 GB liegen Sie im Bereich, in dem Sie Modelle mit 32 Milliarden Parametern problemlos ausführen können und Modelle mit 70 Milliarden Parametern mit starker Quantisierung (Q2 oder Q3). Modelle wie Qwen 3 32B, DeepSeek-R1-Distill 32B und Gemma 3 27B passen hier gut hinein. Diese Modelle bieten im Vergleich zu ihren kleineren Pendants eine deutlich bessere Schlussfolgerungsfähigkeit, längere kohärente Ausgaben und eine stärkere Leistung bei komplexen Aufgaben.

Wenn Sie lokale LLMs für Entwicklungsarbeiten, beim Verfassen von Texten oder für andere Aufgaben nutzen, bei denen es auf die Qualität der Ergebnisse ankommt, sorgen erst ab 32 GB für ein wirklich angenehmes Erlebnis. Ein Kit wie das CORSAIR VENGEANCE DDR5 64 GB (2x32 GB) mit 6000 MT/s bietet Ihnen die Kapazität und Bandbreite, um diese Arbeitslasten ohne Kompromisse zu bewältigen.

64 GB und mehr: Die großen Modelle ausführen

Wenn Sie Modelle mit 70 Milliarden Parametern bei angemessenen Quantisierungsstufen (Q4 oder Q5) ausführen möchten, benötigen Sie 64 GB System-RAM und idealerweise eine Multi-GPU-Konfiguration oder ein System, das eine teilweise Auslagerung auf die GPU unterstützt. Llama 3.3 70B bei Q4 benötigt allein für die Modellgewichte etwa 42 GB, wobei das Kontextfenster und der Betriebssystem-Overhead noch nicht berücksichtigt sind.

Auf dieser Ebene gewinnt die Speicherbandbreite noch mehr an Bedeutung. Jede Token-Generierung erfordert das Durchlaufen von Dutzenden Gigabyte an Gewichten, und schnellerer Arbeitsspeicher führt direkt zu einer schnelleren Ausgabe. Es handelt sich hierbei um eine Konfiguration der Workstation-Klasse, die jedoch bei Fachleuten, die sensible Daten auf dem Gerät behalten möchten, während sie mit offenen Modellen der Frontier-Klasse arbeiten, immer häufiger zum Einsatz kommt.

Warum die Geschwindigkeit des Arbeitsspeichers entscheidend ist – nicht nur die Kapazität

Hier ist etwas, das viele überrascht: Bei der lokalen LLM-Inferenz ist die Speicherbandbreite oft wichtiger als die reine Rechenleistung. Nachdem das erste Token generiert wurde (was rechenintensiv ist), ist jedes weitere Token speicherintensiv. Das Modell muss für jedes Token seinen gesamten Gewichtsatz durch den Prozessor streamen, und die Geschwindigkeit dieses Streamings wird durch die Speicherbandbreite bestimmt.

Praxisnahe Benchmarks zeigen den Unterschied deutlich. Der Wechsel von DDR5-4800 zu DDR5-6000 verbessert die Geschwindigkeit der Token-Generierung bei Modellen wie Mistral 7B und Llama 3.1 8B, die auf der CPU laufen, nachweislich um 20 bis 23 Prozent. Das ist eine erhebliche, spürbare Verbesserung der Reaktionsgeschwindigkeit, die ausschließlich auf den schnelleren Speicher zurückzuführen ist.

Auch Dual-Channel-Konfigurationen spielen eine enorme Rolle. Der Einsatz von zwei RAM-Riegeln im Dual-Channel-Modus verdoppelt im Vergleich zu einem einzelnen Riegel effektiv die verfügbare Bandbreite. In der Praxis kann dies eine um 30 bis 50 Prozent schnellere Inferenz bedeuten. Wenn Sie ein System für lokale KI aufbauen oder aufrüsten, verwenden Sie immer zwei Riegel im Dual-Channel-Modus und niemals nur einen einzelnen DIMM.

Quantisierung: Wie man größere Modelle auf weniger Speicherplatz unterbringt

Die Quantisierung ist die Technik, die lokale LLMs auf handelsüblicher Hardware einsetzbar macht. Dabei werden die Modellgewichte von ihrem ursprünglichen 16-Bit-Gleitkommaformat (FP16) auf kleinere Darstellungsformen komprimiert, typischerweise 4-Bit (Q4), 5-Bit (Q5) oder 8-Bit (Q8). Der Kompromiss besteht darin, dass die Ausgabequalität geringfügig beeinträchtigt wird, dafür aber der Speicherbedarf massiv reduziert wird.

Bei einer Q4_K_M-Quantisierung (dem gängigsten Format für den lokalen Einsatz) schrumpft ein 8B-Modell von etwa 16 GB auf rund 5 bis 6 GB. Ein 70B-Modell schrumpft von 140 GB auf etwa 40 bis 42 GB. Das entspricht einer Speicherplatzersparnis von 75 Prozent, und in den meisten praktischen Anwendungsfällen ist der Qualitätsunterschied kaum wahrnehmbar.

Q5_K_M bietet eine etwas bessere Qualität bei etwa 15 bis 20 Prozent höheren Speicheranforderungen und ist eine Überlegung wert, wenn Sie über ausreichend Spielraum verfügen. Q8 bewahrt fast die gesamte Qualität des Originalmodells, reduziert den Speicherbedarf jedoch nur um die Hälfte; es ist die richtige Wahl, wenn Sie über reichlich Speicher verfügen und die bestmögliche Ausgabe erzielen möchten.

Tools wie Ollama und LM Studio verarbeiten quantisierte Modelle direkt, sodass du keine Konvertierung vornehmen musst. Wähle einfach die Quantisierungsstufe, die zu deinem verfügbaren Speicher passt.

Kontextlänge: Die versteckten Speicherkosten

Jedes Kontextelement (der Text, den Sie an das Modell senden, sowie der vom Modell generierte Text) benötigt zusätzlich zu den Modellgewichten selbst weiteren Speicherplatz. Kurze Unterhaltungen sind kein Problem, aber wenn Sie lange Dokumente eingeben oder umfangreiche Chat-Verläufe führen, kann sich der Speicherbedarf für den Kontext schnell summieren.

Als grobe Richtlinie gilt: 8.000 Kontext-Tokens erfordern etwa 1 GB pro 10 Milliarden Parameter. Steigert man diese Zahl auf 32.000 Tokens, kommen weitere 4 GB hinzu. Einige neuere Modelle unterstützen 128.000 Tokens oder mehr, was den gesamten Speicherbedarf effektiv verdoppeln kann.

Wenn Sie vorhaben, regelmäßig lange Kontexte zu verwenden, beispielsweise indem Sie ganze Codebasen oder umfangreiche Dokumente in ein Modell einspeisen, sollten Sie zusätzliches Speicherplatz einplanen, der über den reinen Speicherbedarf der Modellgewichte hinausgeht. Dies ist ein weiterer Grund, warum Konfigurationen mit 32 GB oder 64 GB für den ernsthaften lokalen Einsatz von KI sinnvoll sind.

Beliebte Modelle und was sie benötigen

Hier finden Sie eine Übersicht über einige der derzeit am häufigsten verwendeten lokalen Modelle mit Angaben zum ungefähren Speicherbedarf bei einer Q4_K_M-Quantisierung:

- Phi-4 Mini (3,8 GHz): ~2,3 GB, läuft auf fast jedem Rechner hervorragend

- Qwen 3.5 4B: ~3,4 GB, hervorragend geeignet für einfache Aufgaben mit starker Schlussfolgerungsfähigkeit

- Llama 3.2 8B: ~5 GB, zuverlässiges, vielseitig einsetzbares kleines Modell

- Qwen 3 8B: ~5 GB, starke Leistung bei Mehrsprachigkeit und Schlussfolgerungen

- Qwen 3.5 9B: ~6,6 GB, neuestes kleines Modell mit verbesserten Funktionen

- DeepSeek-R1-Distill 14B: ~9 GB, hervorragende Schlussfolgerungsfähigkeit bei kompakter Größe

- Gemma 3 12B: ~8 GB, Googles effiziente Option der mittleren Preisklasse

- Llama 4 Scout (109B MoE, 17B aktiv): ~10 GB bei aggressiver Quantisierung, Metas neueste Version, läuft dank der MoE-Architektur überraschend gut

- Qwen 3.5 27B: ~17 GB, leistungsstarker Allrounder, der in 24 GB VRAM passt

- Qwen 3 32B: ~20 GB, hohe Leistungsfähigkeit, passt in 24 GB VRAM

- Qwen 3.5 35B-A3B (MoE): ~24 GB, insgesamt 35B, aber nur 3B pro Token aktiv, sehr effizient

- Llama 3.3 70B: ~42 GB, nahezu State-of-the-Art-Qualität, erfordert viel Arbeitsspeicher

- DeepSeek-R1-Distill 70B: ~42 GB, erstklassige Schlussfolgerungsfähigkeit für den lokalen Einsatz

- GPT-OSS 120B: ~63 GB, das Open-Weight-Modell von OpenAI, benötigt mindestens 64 GB Unified-RAM oder System-RAM

- Qwen 3.5 122B-A10B (MoE): ~81 GB, Flaggschiff-Klasse mit nur 10 Milliarden aktiven Parametern

Diese Zahlen beziehen sich ausschließlich auf die Modellgewichte bei einer Q4_K_M-Quantisierung. Rechnen Sie zusätzlich 2 bis 8 GB für den Kontext, den Betriebssystem-Overhead und alle anderen Anwendungen hinzu, die Sie parallel ausführen. MoE-Modelle (Mixture of Experts) wie Llama 4 Scout und Qwen 3.5 35B-A3B sind bei der Inferenz besonders speichereffizient, da pro Token nur ein Bruchteil ihrer Gesamtparameter aktiv ist.

Die Wahl des richtigen Speichers für lokale KI

Vor dem Hintergrund all dieser Überlegungen sollten Sie bei der Konfiguration des Arbeitsspeichers für lokale LLMs Folgendes beachten:

Entscheiden Sie sich für DDR5, wenn Ihre Plattform dies unterstützt. Der Bandbreitenvorteil gegenüber DDR4 ist deutlich spürbar und wirkt sich direkt auf die Inferenzgeschwindigkeit aus. DDR5-6000 oder schneller bietet das optimale Verhältnis aus Preis, Kompatibilität und Leistung für KI-Anwendungen.

Verwenden Sie immer Dual-Channel. Zwei RAM-Riegel erzielen bei der LLM-Inferenz eine deutlich bessere Leistung als ein einzelner Riegel mit derselben Gesamtkapazität. Ein 2×16-GB-Kit übertrifft einen einzelnen 32-GB-Riegel bei den Tokens pro Sekunde um Längen.

Die Größe für die Modelle, die Sie ausführen möchten. Wenn Sie hauptsächlich mit Modellen von 7B bis 8B experimentieren, reichen 16 GB aus. Wenn Sie Modelle von 14B bis 32B ausführen oder Spielraum für zukünftige Modelle lassen möchten, sind 32 GB die bessere Wahl. Und wenn Sie Modelle mit 70B im Blick haben, sollten Sie 64 GB einplanen.

Für ein System, das aktuelle lokale KI-Modelle gut bewältigt und noch Raum für Wachstum lässt, ist ein Kit wie das CORSAIR VENGEANCE DDR5 64 GB (2x32 GB) mit 6000 MT/s oder 6400 MT/s kaum zu übertreffen. Es bietet die Kapazität für große Modelle, die Bandbreite für schnelle Inferenz und die Dual-Channel-Konfiguration, die für einen effizienten Betrieb sorgt. Wenn Sie ein kompakteres Setup mit Fokus auf kleinere Modelle zusammenstellen, ist ein 32 GB (2x16 GB) DDR5-6000-Kit ein solider und kostengünstiger Ausgangspunkt.

Speziell für lokale KI entwickelt: Die CORSAIR AI WORKSTATION 300

Wenn Sie ernsthaft daran interessiert sind, große Modelle lokal auszuführen, und keinen Tower-PC mit mehreren GPUs zusammenstellen möchten, bietet die CORSAIR AI WORKSTATION 300 einen alternativen Ansatz. Sie basiert auf dem AMD Ryzen AI MAX+ 395-Prozessor mit einer integrierten Radeon 8060S-GPU, die auf bis zu 96 GB VRAM aus den 128 GB LPDDR5X-8000-Speicher des Systems zugreifen kann. Genau diese Kapazität macht das System für lokale KI interessant: Eine einzelne diskrete Consumer-GPU erreicht heute maximal 32 GB VRAM, sodass das Laden von Modellen wie GPT-OSS 120B (ca. 63 GB bei MXFP4) auf eine einzige Karte nicht möglich ist, ohne das Modell auf mehrere GPUs aufzuteilen oder in den System-RAM auszulagern.

Die Unified-Memory-Architektur ist der entscheidende Kompromiss. Man verzichtet auf die reine Bandbreite von dediziertem GDDR7-VRAM, erhält dafür aber bis zu 96 GB GPU-zugänglichen Speicher mit LPDDR5X-Geschwindigkeiten. Das bedeutet, dass Modelle im Parameterbereich von 70B bis 120B, die andernfalls mehrere diskrete GPUs oder eine starke CPU-Entlastung erfordern würden, vollständig auf dem GPU-Speicherpfad einer einzigen Maschine laufen können, ohne dass Ebenen auf verschiedene Karten aufgeteilt oder Gewichte über PCIe ausgelagert werden müssen.

Das System umfasst zudem die XDNA 2 NPU von AMD mit 50 TOPS KI-Beschleunigung für weniger rechenintensive Aufgaben, 2,5-Gbit/s-Ethernet, Wi-Fi 6E sowie mehrere USB-4.0-Anschlüsse. Für Fachleute, die mit sensiblen Daten arbeiten – sei es im Rechts-, Medizin- oder Finanzbereich –, stellt diese KI-Leistung, die vollständig offline und vor Ort genutzt werden kann, einen erheblichen praktischen Vorteil dar.

Der CORSAIR AI-Software-Stack

Die Installation und korrekte Konfiguration lokaler KI-Tools kann zu den frustrierendsten Aspekten des gesamten Prozesses gehören – Abhängigkeitskonflikte, Treiberversionen, Framework-Kompatibilität. Der CORSAIR AI Software Stack ist ein Tool zur geführten Einrichtung, das entwickelt wurde, um diese Hindernisse aus dem Weg zu räumen. Es hilft Ihnen dabei, die richtigen Tools für Ihr System auszuwählen und zu installieren – von KI- und Machine-Learning-Frameworks bis hin zu Entwicklungsumgebungen und Kreativsoftware –, die alle auf Ihre Hardware zugeschnitten sind.

JOIN OUR OFFICIAL CORSAIR COMMUNITIES

Join our official CORSAIR Communities! Whether you're new or old to PC Building, have questions about our products, or want to chat about the latest PC, tech, and gaming trends, our community is the place for you.