現在、AIを活用する上で最も実用的な方法の一つが、自前のハードウェアで大規模言語モデルを実行することです。コーディングアシスタントの実験、プライベートなチャットボットの構築、あるいは単にオープンソースモデルの能力に興味がある場合でも、すぐに浮かぶ疑問が一つあります。それは、「実際にどれくらいのメモリが必要なのか?」ということです。

答えは、実行したいモデルの種類、実行方法、そしてモデルの適合性を重視するか、それとも高速で応答性の高い出力を重視するかによって異なります。メモリ容量は「入り口」を開く鍵です。メモリの速度は、その「中」に入った後の操作感がどれほど快適かを左右します。

なぜメモリがボトルネックになるのか

大規模言語モデルをローカルで実行する場合、テキストを生成している間はモデル全体をメモリ内に保持する必要があります。必要に応じてデータがメモリに出入りするゲームや動画編集とは異なり、LLMの推論ではモデル重みの全セットを読み込み、常駐させます。モデルが生成するトークンは一つひとつ、これらの重みを介して処理される必要があります。

つまり、メモリ容量が最大のボトルネックとなります。モデルを保持するのに十分なRAMやVRAMがない場合、モデルをまったく実行できないか、モデルの一部が処理速度の遅いストレージに溢れ出てしまい、パフォーマンスが劇的に低下してしまいます。場合によっては、処理速度が5倍から30倍も遅くなることもあります。

しかし、処理能力だけでは話の一部に過ぎません。モデルがメモリに収まれば、システムがそれらの重みをプロセッサに供給できる速度こそが、トークンが出力される速度を左右する最大の要因となります。これがメモリ帯域幅であり、ローカルAIにおいては、他のデスクトップワークロードのほとんどよりも、RAMの速度や構成が重要視される理由です。

RAMとVRAM:どちらが重要か?

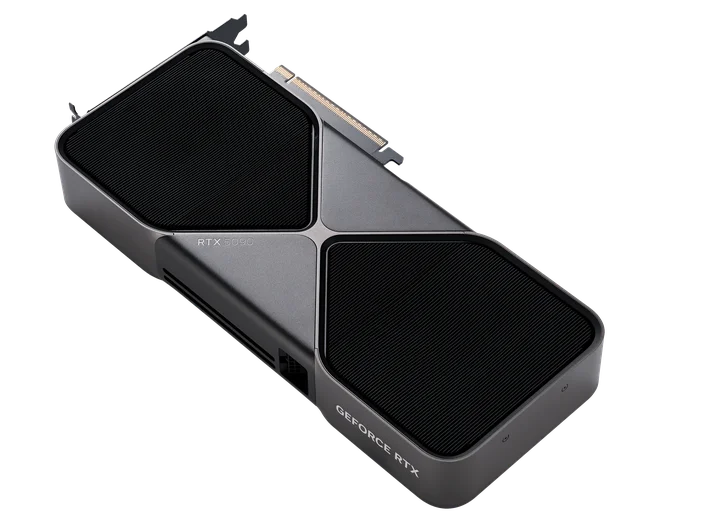

十分なVRAMを搭載した専用GPUをお持ちであれば、それが最も高速な処理方法です。GPUメモリ(VRAM)はシステムRAMよりもはるかに高い帯域幅を誇ります。RTX 4090やRTX 5090のような最新のGPUは1 TB/sを超えるメモリ帯域幅を実現できますが、高速なDDR5システムRAMであっても、一般的なデュアルチャネル構成のデスクトップPCでは最大で約90 GB/s程度にとどまります。

この帯域幅の差こそが、VRAMに完全に収まるモデルが1秒あたり40個以上のトークンを生成できる一方で、システムRAMから実行される同じモデルでは、高速なCPU環境であっても1秒あたり8~15個のトークンしか生成できない理由です。どちらも実用的なレベルですが、応答性の違いは明らかです。

ただし、問題となるのは、一般向けGPUのVRAM容量が最大24GB(RTX 4090やRTX 5090などのモデル)に制限されている点です。そのため、高画質で処理できるのは約140億パラメータのモデルまでとなり、積極的な量子化を行えば最大で約320億パラメータまで対応可能です。 700億パラメータ以上のより大規模なモデルを実行したい場合は、システムRAMを活用するか、複数のGPUを使用するか、あるいは部分的なオフロードによる性能のトレードオフを受け入れる必要があるでしょう。

必要なRAMの容量は? 実用的な解説

ここから具体的な話になります。モデルに必要なメモリ容量は、パラメータ数と、実行時の精度(量子化レベル)によって異なります。大まかな目安として、Q4量子化(4ビット)の場合、パラメータ10億個あたり約0.5~0.6GBが必要となり、さらにコンテキストやOSのためのオーバーヘッドも加わります。

8 GB:エントリーモデル

システムメモリ(またはVRAM)の合計が8GBあれば、4ビット量子化を使用することで、パラメータ数10億~70億規模の小型モデルを快適に実行できます。これには、Llama 3.2 3B、Phi-4 Mini、Qwen 3 4B、Mistral 7B(Q4設定時)などのモデルが含まれます。 これらは、要約、簡単なコード生成、対話型Q&Aといったタスクにおいて、驚くほど高い性能を発揮します。

性能の良いGPUであれば1秒あたり約40~50トークン、CPUであれば1秒あたり15~20トークン程度を想定してください。チャット形式のやり取りには十分実用的な性能です。

16GB:多くの人にとって最適な容量

16GBあれば、より高い量子化レベル(画質向上のためのQ8)での7Bおよび8Bモデル、あるいはQ4での13B~14Bモデルの利用が可能になります。これにより、Llama 3.1 8B、Qwen 3 8B、DeepSeek-R1-Distill 14Bといったモデルが実用的な選択肢となります。 また、モデルと並行してOSや他のアプリを実行しても、システム全体が完全に停止してしまうことなく、十分な余裕を確保できます。

ローカルAIを試す多くの人にとって、16GBのDDR5メモリが現実的なスタートラインと言えます。最も人気のあるオープンソースモデルでも良好な結果が得られ、常にメモリ不足に悩まされることもありません。

32 GB:本格的なローカルAI

32GBあれば、320億パラメータのモデルを快適に実行でき、700億パラメータのモデルでも強力な量子化(Q2またはQ3)を施せば動作させることができます。 Qwen 3 32B、DeepSeek-R1-Distill 32B、Gemma 3 27Bといったモデルがこれに該当します。これらのモデルは、より小規模なモデルと比較して、著しく優れた推論能力、より長い一貫性のある出力、そして複雑なタスクにおけるより強力なパフォーマンスを発揮します。

開発作業やライティング支援など、出力の質が重要な場面でローカルLLMを利用する場合、32GBあればようやく本格的な快適さを実感できるようになります。例えば、CORSAIR VENGEANCE DDR5 64GB(2x32GB)キット(6000MT/s)のような製品なら、こうしたワークロードを妥協なく処理できる容量と帯域幅を確保できます。

64 GBを超えて:大規模モデルの実行

700億パラメータのモデルを妥当な量子化レベル(Q4またはQ5)で実行するには、64GBのシステムRAMが必要であり、理想的にはマルチGPU構成、あるいは部分的なGPUオフロードに対応したシステムが求められます。Llama 3.3 70BをQ4で実行する場合、コンテキストウィンドウやOSのオーバーヘッドを考慮する前の段階で、モデル重みだけで約42GBを必要とします。

このレベルになると、メモリ帯域幅の重要性はさらに高まります。トークンの生成には毎回、数十ギガバイト規模の重みデータをストリーミング処理する必要があり、RAMの高速化はそのまま出力の高速化につながります。これはワークステーションクラスの構成ですが、フロンティアクラスのオープンモデルを扱う際に、機密データをデバイス上に保持したいと考える専門家にとって、このような構成はますます一般的になりつつあります。

なぜRAMの容量だけでなく、速度も重要なのか

多くの人を驚かせる事実があります。それは、ローカルでのLLM推論においては、純粋な演算能力よりもメモリ帯域幅の方が重要になる場合が多いということです。最初のトークンが生成された後(これは演算に依存します)、それ以降のすべてのトークンはメモリに依存します。モデルはトークンごとに重みセット全体をプロセッサにストリーミングする必要があり、そのストリーミング速度はメモリ帯域幅によって左右されるのです。

実環境でのベンチマークテストでは、その差がはっきりと表れています。CPU上で動作するMistral 7BやLlama 3.1 8Bといったモデルにおいて、DDR5-4800からDDR5-6000へ移行することで、トークン生成速度が20~23%向上することが確認されています。これは応答性において顕著かつ目に見える改善であり、その要因は純粋にメモリの高速化によるものです。

デュアルチャネル構成も極めて重要です。RAMを2枚デュアルチャネルモードで動作させると、1枚のみの場合と比べて利用可能な帯域幅が実質的に2倍になります。実際には、これにより推論処理が30~50%高速化される可能性があります。ローカルAI用のシステムを構築またはアップグレードする場合は、必ず2枚のRAMをデュアルチャネルで構成し、DIMMを1枚だけ使用することは避けてください。

量子化:より大きなモデルを少ないメモリに収める方法

量子化は、ローカルLLMを一般向けハードウェアで実用可能にする技術です。これは、モデルの重みを元の16ビット浮動小数点(FP16)から、通常は4ビット(Q4)、5ビット(Q5)、または8ビット(Q8)といったより小さな表現形式に圧縮するものです。その代償として、出力品質はわずかに低下しますが、メモリ要件は大幅に削減されます。

Q4_K_M量子化(ローカル利用で最も一般的な形式)では、80億パラメータのモデルのサイズが約16GBから5~6GB程度に縮小します。700億パラメータのモデルでは、140GBから約40~42GBに縮小します。これはメモリ使用量の75%削減に相当しますが、実用上のほとんどのケースにおいて、品質の差はほとんど気にならない程度です。

Q5_K_Mは、メモリ使用量が約15~20%増える代わりに、画質がわずかに向上します。メモリに余裕がある場合は、検討する価値があります。Q8は、元のモデルの画質をほぼそのまま維持しつつ、メモリ使用量を半分に抑えることができます。メモリに余裕があり、最高品質の出力を求める場合に最適な選択肢です。

Ollama や LM Studio といったツールは、量子化モデルをネイティブで扱えるため、自分で変換を行う必要はありません。利用可能なメモリ容量に合わせて量子化レベルを選択するだけで済みます。

文脈の長さ:隠れたメモリコスト

コンテキストのあらゆる要素(モデルに送信するテキストと、モデルが生成するテキスト)には、モデルの重み自体に加えて追加のメモリが必要です。短い会話であれば問題ありませんが、長い文書を入力したり、長期間にわたるチャット履歴を維持したりする場合、コンテキストメモリの使用量は急速に増加する可能性があります。

大まかな目安として、コンテキストのトークン数が8Kになると、パラメータ100億個あたり約1GBのメモリが追加で必要になります。これを32Kトークンに増やすと、さらに4GBが必要になります。一部の新しいモデルでは128Kトークン以上に対応しており、これにより必要なメモリ総量が実質的に2倍になる可能性があります。

コードベース全体や長文のドキュメントなどをモデルに入力するなど、長文のコンテキストを定期的に使用する予定がある場合は、モデルの重みだけで必要な容量に加えて、余分なメモリを確保しておく必要があります。これが、本格的なローカルAI利用において32GBや64GBの構成が理にかなっているもう一つの理由です。

人気のモデルと、彼女たちに必要なもの

現在最もよく使われているローカルモデルの概要を以下に示します。Q4_K_M量子化におけるおおよそのメモリ使用量も併せて記載しています:

- Phi-4 Mini (3.8B):約2.3 GB、ほぼすべての環境で快適に動作します

- Qwen 3.5 4B:約3.4 GB。軽量なタスクに最適で、優れた推論能力を備えています。

- Llama 3.2 8B:約5 GB、信頼性の高い汎用小型モデル

- Qwen 3 8B:約5GB、優れた多言語処理能力と推論性能

- Qwen 3.5 9B:約6.6 GB、機能が強化された最新の小型モデル

- DeepSeek-R1-Distill 14B:約9 GB、コンパクトなサイズでありながら優れた推論能力

- Gemma 3 12B:約8GB、Googleが提供する高性能な中規模モデル

- Llama 4 Scout(MoE 109B、アクティブ17B):アグレッシブな量子化で約10GB。Metaの最新モデルであり、MoEアーキテクチャのおかげで驚くほど良好に動作する

- Qwen 3.5 27B:約17GB、24GBのVRAMに収まる強力なオールラウンダー

- Qwen 3 32B:約20GB、高性能、24GBのVRAMに対応

- Qwen 3.5 35B-A3B (MoE):約24 GB、合計35Bだが、トークンあたりアクティブなのは3Bのみ、非常に効率的

- Llama 3.3 70B: 約42 GB、最先端に近い品質、大容量のRAMが必要

- DeepSeek-R1-Distill 70B:約42 GB、ローカル利用向けの最高水準の推論能力

- GPT-OSS 120B:約63 GB。OpenAIのオープンウェイトモデルで、64 GB以上の統合メモリまたはシステムRAMが必要です。

- Qwen 3.5 122B-A10B (MoE):約81GB、アクティブなパラメータがわずか100億個というフラッグシップクラス

これらの数値は、Q4_K_M量子化時のモデル重みのみに基づくものです。コンテキスト、OSのオーバーヘッド、および同時に実行しているその他のアプリケーション用に、2~8GBを追加してください。Llama 4 ScoutやQwen 3.5 35B-A3BのようなMoE(Mixture of Experts)モデルは、トークンごとに総パラメータ数のごく一部しかアクティブにならないため、推論時のメモリ効率が特に優れています。

ローカルAIに適したメモリの選び方

以上の点を踏まえて、ローカルLLMのメモリ構成について次のように考えてみてください:

お使いのプラットフォームがDDR5に対応しているなら、DDR5を選ぶべきです。DDR4に比べて帯域幅が優れているのは事実であり、推論速度に直接影響します。DDR5-6000以上のモデルは、AIワークロードにおいて価格、互換性、パフォーマンスのバランスが最も良い選択肢となります。

常にデュアルチャネルで動作させてください。LLM推論においては、合計容量が同じであっても、RAMを2枚使用した方が1枚のみの場合よりも大幅に高性能です。2×16GBのキットは、32GBの単体モジュールと比較して、トークン毎秒(TPS)の性能で圧倒的な差をつけています。

実行したいモデルのサイズに応じてメモリ容量を決定します。主に70億から80億パラメータのモデルを試すのであれば、16GBで十分です。140億から320億パラメータのモデルを実行する場合や、将来のモデルに備えて余裕を持たせたい場合は、32GBを目安にすると良いでしょう。また、700億パラメータのモデルを検討しているのであれば、64GBを確保するように計画してください。

現在のローカルAIモデルを快適に処理でき、かつ将来の拡張余地も残すシステムを求めるなら、CORSAIR VENGEANCE DDR5 64GB(2x32GB)の6000MT/sまたは6400MT/sモデルのようなキットは、他に類を見ないほど優れています。 大規模モデルに対応する容量、高速な推論を実現する帯域幅、そしてこれらすべてを効率的に動作させるデュアルチャネル構成を兼ね備えています。より小規模なモデルに焦点を当てたコンパクトなセットアップを構築する場合、32GB(2x16GB)のDDR5-6000キットは、堅実かつコストパフォーマンスに優れた出発点となります。

ローカルAI専用に設計された「CORSAIR AI WORKSTATION 300」

大規模なモデルをローカルで実行することに真剣に取り組んでおり、マルチGPU搭載のタワー型PCを構築したくないという方には、CORSAIR AI WORKSTATION 300が新たな選択肢となります。 このシステムは、AMDのRyzen AI MAX+ 395プロセッサを中核とし、Radeon 8060S統合GPUを搭載しています。このGPUは、システムに搭載された128GBのLPDDR5X-8000メモリから最大96GBのVRAMにアクセス可能です。 この容量こそが、ローカルAIにおいてこのシステムを魅力的にしている要因です。現在の単体のコンシューマー向けディスクリートGPUのVRAM容量は最大32GBであるため、GPT-OSS 120B(MXFP4で約63GB)のようなモデルを1枚のカードに読み込むには、モデルを複数のGPUに分割するか、システムRAMにオフロードする必要があります。

統合メモリアーキテクチャこそが、重要なトレードオフの鍵となります。 専用GDDR7 VRAMの純粋な帯域幅は犠牲になりますが、その代わりに、LPDDR5Xの速度で最大96GBのGPUアクセス可能メモリが利用可能になります。つまり、通常であれば複数のディスクリートGPUや大規模なCPUオフロードを必要とする700億~1,200億パラメータ規模のモデルでも、カード間でレイヤーを分割したり、PCIe経由で重みをページングしたりすることなく、単一のマシン上でGPUメモリパスだけで完全に実行できるようになります。

また、このシステムには、軽微なタスク向けに50 TOPSのAIアクセラレーション機能を備えたAMDのXDNA 2 NPUに加え、2.5 Gbpsイーサネット、Wi-Fi 6E、および複数のUSB 4.0ポートが搭載されています。機密データを扱う法律、医療、金融などの分野の専門家にとって、このレベルのAI機能を完全にオフラインかつオンプレミスで利用できることは、実用面において大きな利点となります。

CORSAIR AI ソフトウェア・スタック

ローカルAIツールのインストールや設定は、依存関係の競合、ドライバーのバージョン、フレームワークの互換性など、最も頭を悩ませる作業の一つになりがちです。CORSAIR AI Software Stackは、こうした煩わしさを解消するために設計されたガイド付きセットアップツールです。AIや機械学習フレームワークから開発環境、クリエイティブソフトウェアに至るまで、お使いのハードウェアに合わせて最適なツールを選択・インストールするお手伝いをします。

JOIN OUR OFFICIAL CORSAIR COMMUNITIES

Join our official CORSAIR Communities! Whether you're new or old to PC Building, have questions about our products, or want to chat about the latest PC, tech, and gaming trends, our community is the place for you.