로컬에서 LLM을 실행한다는 것은 모델이 사용자의 PC에 저장되어 있으며, 사용자가 입력하는 프롬프트(및 모델에 제공하는 모든 파일)가 컴퓨터 밖으로 나가지 않아도 된다는 뜻입니다. 클라우드 계정도, API 키도 필요 없습니다. “사용자의 데이터로 훈련할게요… 아마도 아닐 수도 있고… 어쩌면…” 같은 말도 없습니다. 오직 사용자, 사용자의 PC, 그리고 사용자가 지시하는 모든 작업을 수행하는 모델만 있을 뿐입니다.

“지역 LLM”이란 정확히 무엇인가요?

로컬 LLM은 원격 서버가 아닌 사용자의 컴퓨터에서 실행되는 대규모 언어 모델입니다. 실제로는 보통 모델 파일을 다운로드하여 로컬 앱에 불러온 다음, 마치 클라우드 비서와 대화하듯이 모델과 대화하게 되는데, 유일한 차이점은 ‘서버’가 사용자의 PC라는 점입니다.

로컬에서 LLM을 “실행”한다는 것은 거의 항상 추론 (응답 생성) 을 의미하며, 완전히 새로운 모델을 처음부터 훈련시키는 것을 뜻하지는 않습니다.

왜 로컬 LLM을 실행해야 할까요?

사람들이 클라우드 기반 대규모 언어 모델(LLM)에서 로컬 모델로 전환하는 데에는 몇 가지 이유가 있습니다:

- 개인정보 보호: 클라우드 연결 기능을 사용하지 않는 한, 입력한 내용은 기기 내에 저장됩니다.

- 오프라인 사용: 모델을 다운로드하면 인터넷 연결 없이도 실행할 수 있습니다.

- 사용량 제한 없음: 속도 제한도, “오늘 할당량을 다 썼습니다”라는 메시지도, 예상치 못한 요금 청구도 없습니다.

- 이용 방법: 원하시는 모델을 선택하시면 됩니다. 구독제 방식에 얽매일 필요가 없습니다.

물론, 편의성을 포기하는 대신 제어권을 얻게 되는 셈입니다. 클라우드 모델은 마치 마법처럼 느껴질 수 있고, 로컬 모델은 사용 중인 하드웨어에 따라 마법처럼 느껴질 수도 있습니다.

로컬 LLM을 실행하려면 무엇이 필요한가요?

간단히 말하면: CPU가 핵심이고, GPU가 보조하며, 메모리가 중요하다.

즐거운 시간을 보낼 수 있을지 여부에 실제로 영향을 미치는 요소는 다음과 같습니다:

- RAM/VRAM: 모델이 클수록 더 많은 메모리가 필요합니다. 메모리가 부족하면 모델이 실행되지 않습니다.

- 저장 공간: 모델의 용량이 클 수 있습니다. 일부 라이브러리에서는 다운로드하는 모델에 따라 저장 용량이 수십 GB에서 수백 GB에 달할 수 있다고 경고합니다.

- GPU: 앱이 GPU를 지원하는 경우, 대개 속도가 크게 향상됩니다.

32GB 이상의 RAM을 탑재한 최신 Windows 10/11 컴퓨터는 소규모 로컬 모델을 구동하기에 충분한 기본 사양이며, 메모리를 더 늘리면 더 큰 규모의 모델도 훨씬 원활하게 실행할 수 있습니다.

“지역 LLM 실행기” 앱을 선택하세요

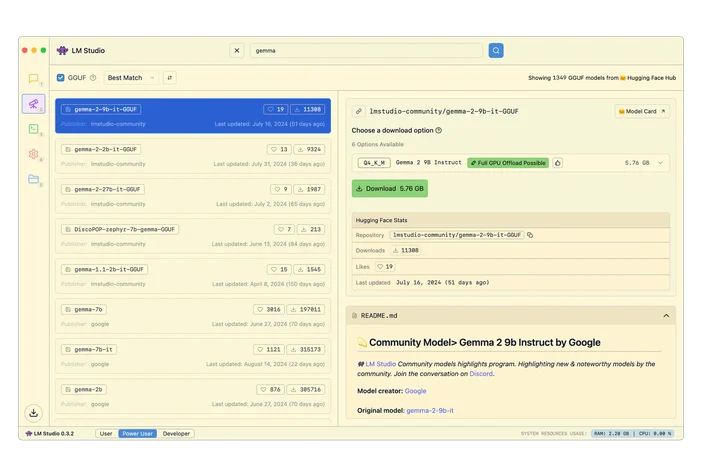

LM Studio (사용하기 쉬운 GUI)

LM Studio는 모델을 다운로드하고 로컬 환경에서 대화할 수 있는 데스크톱 앱입니다. 또한 개발자를 위한 프로그래밍 가능한 로컬 API도 포함되어 있습니다.

Ollama (간편한 CLI + 로컬 API)

Ollama는 네이티브 Windows 애플리케이션으로 실행되며, 명령줄 워크플로우와 로컬 HTTP API 엔드포인트를 제공합니다. 이 프로그램은 Windows 환경에서 NVIDIA 및 AMD Radeon GPU를 명시적으로 지원합니다.

llama.cpp (호기심 많은 분들을 위해)

최대한의 제어권을 원하신다면, llama.cpp는 빌드 안내서와 다양한 백엔드를 갖춘 인기 있는 오픈소스 추론 엔진입니다.

첫 번째 모델을 설치하고 실행하세요

더 큰 모델은 더 많은 RAM 및/또는 VRAM이 필요합니다. 용량이 충분하지 않으면 성능이 저하되거나, 프로그램이 강제 종료되거나, 디스크 스왑이 끊임없이 발생하게 됩니다(이때는 마치 PC가 꿀에 빠진 듯 느리게 작동하는 것처럼 느껴집니다).

int4 양자화 모델에 대한 안전한 경험적 규칙:

- 8GB RAM → 약 30억 개의 모델

- 16GB RAM → 약 70억 개의 모델

- 32GB RAM → 약 130억 개의 모델

그리고 GPU 가속을 활용하고 있다면:

- 6GB VRAM → 약 30억 개의 모델

- 8GB VRAM → 약 70억 개의 모델

- 12GB VRAM → 약 130억 개의 모델

혹시 추측하고 싶지 않다면, LLMfit을 사용하여 모델을 사용자의 하드웨어 사양에 정확히 맞출 수 있습니다.

LLMfit는 사용자의 CPU, RAM, GPU/VRAM을 감지한 뒤 , 적합도, 예상 속도, 사용 맥락, 품질을기준으로 모델을 순위별로 정리해 주는 터미널 도구로 , 이를 통해사용자는 파일을 다운로드하기 전에 어떤 모델이 원활하게 실행될지 미리 확인할 수 있습니다.

어떤 경우에 유용한가:

- RAM/VRAM 용량 제한에 실제로 맞는 모델 찾기

- 권장 양자화 확인 (메모리 할당 과다 방지)

- 비관적인 뉴스만 훑어보는 모델 허브 대신, 순위가 매겨진 후보 목록을 확인하기

이 워크플로우에서 사용하는 방법:

- llmfit을 실행하여 시스템 하드웨어를 스캔하세요

- 상단의 ‘추천 상품’을 확인해 보세요

- 사용 중인 기기에 맞는 모델 크기를 선택한 다음, LM Studio / Ollama / llama에서 다운로드하세요.

다 준비됐어요!

이게 전부입니다. 실행 환경을 선택하고, 사용 중인 하드웨어에 맞는 모델을 다운로드한 뒤 프롬프트를 입력하기만 하면 됩니다! 모든 데이터는 사용자의 컴퓨터에 저장됩니다. 컴퓨터 공학 학위나 클라우드 구독, 주말 내내 문제 해결에 시간을 할애할 필요도 없습니다. 전체 과정은 게임을 설치하는 데 걸리는 시간과 비슷합니다. 일단 실행되면, 사용자의 조건에 맞춰 작동하는 비공개 오프라인 AI 비서를 갖게 되는 셈입니다.

CORSAIR AI300의 활용처

Windows에서 로컬 LLM을 실행하려는 분, 특히 더 큰 모델이나 더 넓은 컨텍스트 창, 또는 더 부드러운 성능을 원하신다면 바로 이 제품이 CORSAIR AI Workstation 300 (AI300) 와 CORSAIR AI 소프트웨어 스택 가 여러분의 능력을 한 단계 더 끌어올려 줄 것입니다.

로컬 추론은 대개 메모리와 처리량에서 병목 현상이 발생합니다. AI300은 이러한 현실을 고려하여 설계되었습니다:

- 로컬 AI 워크플로우를 위해 설계된 소형 워크스테이션

- 대용량 모델을 구동할 수 있는 여유 공간을 제공하는 대용량 메모리 구성

- AI 사용 사례에 맞춰 확장되도록 설계된 그래픽 메모리 동작

- 하드웨어 수준의 성능 모드 선택기(조용 / 균형 / 최대)를 통해 조용한 환경을 원할지, 아니면 속도를 원할지 직접 결정할 수 있습니다

Windows에서 로컬 LLM을 실행하려면 NVIDIA GPU가 필요한가요?

아닙니다. 일부 도구는 Windows에서 AMD를 명시적으로 지원합니다. 예를 들어, Ollama의 Windows 문서에는 NVIDIA와 AMD Radeon GPU 모두를 지원한다고 명시되어 있습니다.

로컬 LLM을 완전히 오프라인 상태에서 실행할 수 있나요?

네, 앱과 모델 파일을 다운로드하신 후에는 가능합니다. 초기 설치와 모델 다운로드에는 일반적으로 인터넷 연결이 필요하지만, 모든 파일이 로컬에 저장되면 추론은 오프라인 상태에서도 실행할 수 있습니다.

지역 기반 AI는 자동으로 개인정보가 보호되는가?

그렇기도 하지만, 설정에 따라 다릅니다. 로컬 추론이란 모델이 사용자의 기기에서 실행되는 것을 의미하지만, 일부 앱은 선택적으로 클라우드 연결을 제공합니다. “클라우드 없이” 사용하는 것이 목표라면, 클라우드 연동 기능을 비활성화하고 로컬 전용 모델만 사용하세요.

왜 내 로컬 모델이 느릴까요?

보통 다음 중 하나입니다:

- 모델이 사용 가능한 RAM/VRAM 용량을 초과합니다

- GPU 가속을 사용할 수 있음에도 CPU만 사용하고 있습니다

- 컨텍스트 길이를 너무 길게 설정해서 메모리를 많이 잡아먹고 있어요

- 저장 공간이 가득 찼습니다 (네, 중요한 문제입니다)

기사의 제품

JOIN OUR OFFICIAL CORSAIR COMMUNITIES

Join our official CORSAIR Communities! Whether you're new or old to PC Building, have questions about our products, or want to chat about the latest PC, tech, and gaming trends, our community is the place for you.