현재 AI 분야에서 직접 하드웨어를 활용해 대규모 언어 모델을 구동하는 것은 가장 실용적인 방법 중 하나입니다. 코딩 보조 도구를 실험해 보거나, 개인용 챗봇을 구축하거나, 혹은 오픈소스 모델이 어떤 기능을 하는지 단순히 궁금해하는 경우라도, 가장 먼저 떠오르는 질문은 바로 ‘실제로 얼마나 많은 메모리가 필요한가?’입니다.

답은 실행하려는 모델의 종류, 실행 방식, 그리고 모델의 적합도를 더 중요하게 여길지 아니면 빠르고 반응이 빠른 출력을 더 중요하게 여길지에 따라 달라집니다. 메모리 용량은 시작의 발판이 되어줍니다. 메모리 속도는 일단 시작하고 나면 사용 경험이 얼마나 쾌적할지 결정합니다.

왜 메모리가 병목 현상이 되는가

대규모 언어 모델(LLM)을 로컬에서 실행할 때, 텍스트를 생성하는 동안 모델 전체가 메모리에 상주해야 합니다. 필요에 따라 데이터가 메모리로 들어오고 나가는 게임이나 영상 편집과 달리, LLM 추론은 모델 가중치 전체를 불러와 메모리에 상주시킵니다. 모델이 생성하는 모든 토큰은 이 가중치를 거쳐야 합니다.

따라서 메모리 용량이 가장 큰 병목 지점이 됩니다. 모델을 저장할 만큼의 RAM이나 VRAM이 충분하지 않으면, 모델을 아예 실행할 수 없거나 모델의 일부가 속도가 느린 저장 장치로 넘겨져 성능이 급격히 저하됩니다. 경우에 따라서는 5배에서 30배까지 속도가 느려질 수 있습니다.

하지만 용량만으로는 전체 그림의 절반에 불과합니다. 모델이 메모리에 모두 들어맞게 되면, 시스템이 해당 가중치를 프로세서에 전달하는 속도가 토큰이 산출되는 속도를 결정하는 가장 큰 요인이 됩니다. 이것이 바로 메모리 대역폭이며, 바로 이 때문에 로컬 AI의 경우 다른 어떤 데스크톱 워크로드보다 RAM의 속도와 구성이 훨씬 더 중요하게 작용합니다.

RAM 대 VRAM: 어느 쪽이 더 중요할까?

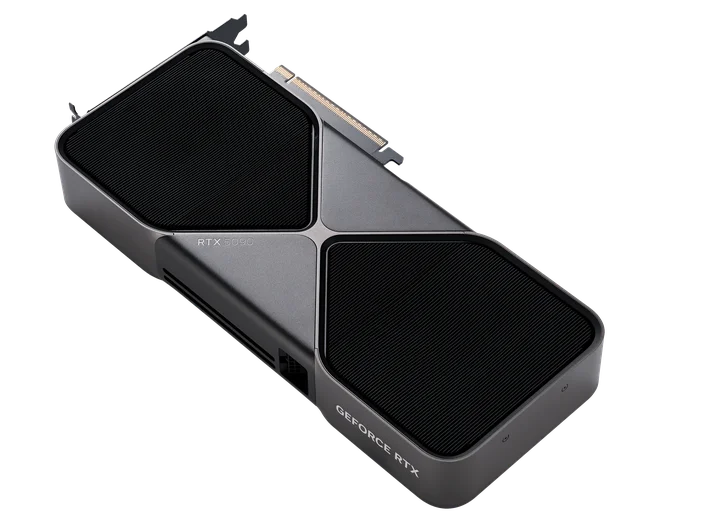

충분한 VRAM을 갖춘 전용 GPU가 있다면, 이것이 가장 빠른 방법입니다. GPU 메모리(VRAM)는 시스템 RAM보다 훨씬 더 높은 대역폭을 갖습니다. RTX 4090이나 RTX 5090과 같은 최신 GPU는 1TB/s가 넘는 메모리 대역폭을 제공할 수 있는 반면, 빠른 DDR5 시스템 RAM조차도 일반적인 듀얼 채널 데스크톱 구성에서는 최대 90GB/s 정도에 그칩니다.

이러한 대역폭 격차 때문에 VRAM에 완전히 들어맞는 모델은 초당 40개 이상의 토큰을 생성할 수 있는 반면, 시스템 RAM에서 실행되는 동일한 모델은 고성능 CPU 환경에서조차 초당 8~15개 정도의 토큰을 처리하는 데 그칠 수 있습니다. 두 경우 모두 사용 가능하지만, 반응 속도의 차이는 확연히 느껴집니다.

문제는 소비자용 GPU의 VRAM 용량이 최대 24GB(RTX 4090 및 RTX 5090과 같은 모델 기준)로 제한되어 있어, 고품질로 처리할 경우 약 140억 파라미터 규모의 모델까지만 가능하며, 과감한 양자화(quantization)를 적용하더라도 최대 약 320억 파라미터 수준에 그친다는 점입니다. 700억 파라미터 이상의 더 큰 모델을 실행하려면 시스템 RAM을 활용하거나, 여러 개의 GPU를 사용하거나, 부분적인 오프로딩을 통해 성능 저하를 감수해야 할 가능성이 높습니다.

RAM은 얼마나 필요할까요? 실용적인 분석

이제 구체적인 내용을 살펴보겠습니다. 모델에 필요한 메모리 용량은 모델의 매개변수 수와 실행 시 적용되는 정밀도(양자화 수준)에 따라 달라집니다. 대략적인 경험칙으로는, Q4 양자화(4비트) 기준 매개변수 10억 개당 약 0.5~0.6GB의 메모리가 필요하며, 여기에 컨텍스트 및 운영 체제 관련 오버헤드가 추가됩니다.

8GB: 입문용

총 8GB의 시스템 메모리(또는 VRAM)를 사용하면 4비트 양자화를 통해 10억~70억 파라미터 범위의 소형 모델을 원활하게 실행할 수 있습니다. 여기에는 Llama 3.2 3B, Phi-4 Mini, Qwen 3 4B, Mistral 7B(Q4 설정 시)와 같은 모델이 포함됩니다. 이러한 모델들은 요약, 간단한 코드 생성, 대화형 Q&A와 같은 작업에 놀라울 정도로 뛰어난 성능을 발휘합니다.

성능이 괜찮은 GPU를 사용하면 초당 약 40~50개의 토큰을 처리할 수 있으며, CPU의 경우 초당 15~20개 정도입니다. 채팅 형식의 상호작용에는 충분히 활용 가능합니다.

16GB: 대다수 사용자에게 가장 적합한 용량

16GB 메모리는 더 높은 양자화 수준(더 나은 품질을 위한 Q8)에서 7B 및 8B 모델을, Q4 수준에서는 13B~14B 모델을 구동할 수 있는 기반을 마련해 줍니다. 바로 이 지점에서 Llama 3.1 8B, Qwen 3 8B, DeepSeek-R1-Distill 14B와 같은 모델들이 실용화됩니다. 또한 모델과 함께 운영 체제 및 기타 애플리케이션을 실행해도 시스템이 완전히 멈춰버리지 않을 만큼 충분한 여유 공간을 확보할 수 있습니다.

로컬 AI를 처음 접하는 대부분의 사용자에게 16GB DDR5 메모리는 현실적인 시작점입니다. 가장 널리 쓰이는 오픈소스 모델들을 사용해도 만족스러운 결과를 얻을 수 있으며, 메모리 부족으로 인한 불편함을 지속적으로 느끼지 않을 것입니다.

32GB: 강력한 로컬 AI

32GB라면 320억 파라미터 모델을 여유롭게 구동할 수 있으며, 700억 파라미터 모델도 높은 수준의 양자화(Q2 또는 Q3)를 적용해 구동할 수 있는 수준입니다. Qwen 3 32B, DeepSeek-R1-Distill 32B, Gemma 3 27B와 같은 모델이 여기에 잘 부합합니다. 이러한 모델들은 더 작은 규모의 모델들에 비해 눈에 띄게 향상된 추론 능력, 더 긴 일관성 있는 출력, 그리고 복잡한 작업에서 더 강력한 성능을 제공합니다.

개발 작업이나 글쓰기 지원 등 출력 품질이 중요한 작업을 위해 로컬 LLM을 사용한다면, 32GB부터 비로소 진정한 성능 향상을 체감할 수 있습니다. 6000MT/s 속도의 CORSAIR VENGEANCE DDR5 64GB(2x32GB) 키트와 같은 제품은 이러한 작업 부하를 타협 없이 처리할 수 있는 충분한 용량과 대역폭을 제공합니다.

64GB를 넘어: 대규모 모델 실행하기

700억 파라미터 모델을 적정한 양자화 수준(Q4 또는 Q5)에서 실행하려면 64GB의 시스템 RAM이 필요하며, 이상적으로는 멀티 GPU 구성이거나 부분적인 GPU 오프로딩을 지원하는 시스템이 필요합니다. Q4 수준에서 Llama 3.3 70B 모델의 경우, 컨텍스트 윈도우와 OS 오버헤드를 고려하기 전에도 모델 가중치만 약 42GB가 소요됩니다.

이 단계에서는 메모리 대역폭이 더욱 중요해집니다. 토큰을 생성할 때마다 수십 기가바이트에 달하는 가중치를 처리해야 하므로, RAM 속도가 빠를수록 출력 속도도 직접적으로 빨라집니다. 이는 워크스테이션급 사양이지만, 최첨단 오픈 모델을 활용하면서도 민감한 데이터를 기기 내에 보관하고자 하는 전문가들 사이에서 점점 더 보편화되고 있습니다.

용량뿐만 아니라 RAM 속도가 중요한 이유

많은 사람들이 놀라워하는 사실이 하나 있습니다. 바로 로컬 LLM 추론의 경우, 순수한 연산 성능보다 메모리 대역폭이 더 중요한 경우가 많다는 점입니다. 첫 번째 토큰이 생성된 후(이 단계는 연산 집약적입니다), 그 이후의 모든 토큰은 메모리 집약적입니다. 모델은 각 토큰을 처리할 때마다 전체 가중치 세트를 프로세서를 통해 스트리밍해야 하며, 이 스트리밍 속도는 메모리 대역폭에 의해 좌우됩니다.

실제 벤치마크 결과는 이러한 차이를 명확히 보여줍니다. CPU에서 실행되는 Mistral 7B 및 Llama 3.1 8B와 같은 모델의 경우, DDR5-4800에서 DDR5-6000으로 업그레이드했을 때 토큰 생성 속도가 20~23% 향상되는 것으로 나타났습니다. 이는 반응 속도 측면에서 상당하고 뚜렷한 개선이며, 이는 전적으로 메모리 속도 향상에서 비롯된 것입니다.

듀얼 채널 구성 역시 매우 중요합니다. RAM 모듈 두 개를 듀얼 채널 모드로 구동하면 단일 모듈 사용 시에 비해 사용 가능한 대역폭이 사실상 두 배로 늘어납니다. 실제로 이는 추론 속도가 30~50% 빨라질 수 있음을 의미합니다. 로컬 AI용 시스템을 구축하거나 업그레이드할 때는 반드시 듀얼 채널로 RAM 모듈 두 개를 사용해야 하며, 절대로 단일 DIMM만 사용해서는 안 됩니다.

양자화: 더 큰 모델을 더 적은 메모리에 수용하는 방법

양자화는 지역형 대규모 언어 모델(LLM)을 일반 소비자용 하드웨어에서도 실용적으로 사용할 수 있게 해주는 기술입니다. 이 기술은 모델 가중치를 원래의 16비트 부동소수점(FP16) 형식에서 더 작은 표현 방식, 주로 4비트(Q4), 5비트(Q5) 또는 8비트(Q8)로 압축합니다. 이에 따른 장단점은 메모리 요구량을 대폭 줄이는 대신 출력 품질이 약간 저하된다는 점입니다.

Q4_K_M 양자화(로컬 사용 시 가장 널리 쓰이는 형식)를 적용하면, 80억 파라미터 모델의 용량은 약 16GB에서 5~6GB로 줄어듭니다. 700억 파라미터 모델의 경우 140GB에서 약 40~42GB로 감소합니다. 이는 메모리 사용량을 75%나 줄이는 것이며, 대부분의 실제 사용 사례에서 품질 차이는 거의 느껴지지 않습니다.

Q5_K_M은 메모리 사용량이 약 15~20% 더 들지만 화질이 약간 더 우수하므로, 여유 용량이 있다면 고려해 볼 만합니다. Q8은 원본 모델의 화질을 거의 그대로 유지하지만 메모리 요구량은 절반으로만 줄여주므로, 메모리가 충분하고 최상의 결과물을 원할 때 선택해야 할 옵션입니다.

Ollama나 LM Studio와 같은 도구는 양자화 모델을 기본적으로 지원하므로, 사용자가 직접 변환 작업을 할 필요가 없습니다. 사용 가능한 메모리 용량에 맞는 양자화 수준을 선택하기만 하면 됩니다.

문맥 길이: 숨겨진 메모리 비용

컨텍스트의 모든 요소(모델에 전송하는 텍스트와 모델이 생성한 텍스트)는 모델 가중치 자체 외에도 추가적인 메모리를 필요로 합니다. 짧은 대화는 문제가 없지만, 긴 문서를 입력하거나 방대한 대화 기록을 유지해야 하는 경우 컨텍스트 메모리 사용량이 급격히 증가할 수 있습니다.

대략적인 기준으로, 컨텍스트 토큰 8K개는 매개변수 100억 개당 약 1GB의 용량을 차지합니다. 이를 32K 토큰으로 늘리면 추가로 4GB가 필요합니다. 일부 최신 모델은 128K 토큰 이상을 지원하는데, 이 경우 총 메모리 요구량이 사실상 두 배로 늘어날 수 있습니다.

코드베이스 전체나 분량이 많은 문서를 모델에 입력하는 등 긴 컨텍스트를 정기적으로 사용할 계획이라면, 모델 가중치 자체에 필요한 용량보다 더 많은 메모리를 확보해야 합니다. 이것이 바로 본격적인 로컬 AI 활용을 위해 32GB 또는 64GB 사양을 선택하는 것이 합리적인 또 다른 이유입니다.

인기 모델과 그들이 필요로 하는 것

다음은 현재 가장 널리 사용되는 로컬 모델들에 대한 간략한 참고 자료로, Q4_K_M 양자화 시 필요한 대략적인 메모리 용량을 보여줍니다:

- Phi-4 Mini (3.8B): 약 2.3GB, 거의 모든 환경에서 원활하게 작동합니다

- Qwen 3.5 4B: 약 3.4GB, 강력한 추론 능력을 갖춘 가벼운 작업에 최적화됨

- Llama 3.2 8B: 약 5GB, 신뢰할 수 있는 범용 소형 모델

- Qwen 3 8B: 약 5GB, 뛰어난 다국어 처리 및 추론 성능

- Qwen 3.5 9B: 약 6.6GB, 성능이 향상된 최신 소형 모델

- DeepSeek-R1-Distill 14B: 약 9GB, 작은 용량에도 뛰어난 추론 능력

- Gemma 3 12B: 약 8GB, 구글의 효율적인 중형 모델

- Llama 4 Scout (MoE 109B, 활성 모델 17B): 공격적인 양자화 시 약 10GB, 메타의 최신 모델로, MoE 아키텍처 덕분에 놀라울 정도로 잘 작동한다

- Qwen 3.5 27B: 약 17GB, 24GB VRAM에 적합한 강력한 만능형 모델

- Qwen 3 32B: 약 20GB, 뛰어난 성능, 24GB VRAM에 호환

- Qwen 3.5 35B-A3B (MoE): 약 24GB, 총 35B이지만 토큰당 3B만 활성화되어 매우 효율적

- Llama 3.3 70B: 약 42GB, 최첨단 수준의 품질, 상당한 양의 RAM 필요

- DeepSeek-R1-Distill 70B: 약 42GB, 로컬 사용을 위한 최고 수준의 추론 능력

- GPT-OSS 120B: 약 63GB, OpenAI의 오픈 웨이트 모델로, 64GB 이상의 통합 RAM 또는 시스템 RAM이 필요합니다.

- Qwen 3.5 122B-A10B (MoE): 약 81GB, 활성 파라미터가 100억 개에 불과한 플래그십급 모델

이 수치는 Q4_K_M 양자화 방식에서 모델 가중치에만 해당합니다. 컨텍스트, OS 오버헤드, 그리고 함께 실행 중인 다른 애플리케이션들을 고려하여 2~8GB를 추가로 확보해야 합니다. Llama 4 Scout나 Qwen 3.5 35B-A3B와 같은 MoE(Mixture of Experts) 모델은 토큰당 전체 매개변수의 일부만 활성화되므로, 추론 단계에서 특히 메모리 효율이 높습니다.

로컬 AI에 적합한 메모리 선택하기

위에서 다룬 내용을 종합해 볼 때, 로컬 LLM의 메모리 구성을 다음과 같이 고려해 보시기 바랍니다:

사용 중인 플랫폼이 DDR5를 지원한다면 DDR5를 선택하세요. DDR4에 비해 대역폭이 확실히 더 넓어 추론 속도에 직접적인 영향을 미칩니다. DDR5-6000 이상은 AI 워크로드에 있어 가격, 호환성, 성능 면에서 최적의 균형을 제공합니다.

항상 듀얼 채널로 구동하세요. LLM 추론의 경우, 동일한 총 용량의 RAM 한 개보다 두 개의 RAM 모듈을 사용하는 것이 성능이 훨씬 뛰어납니다. 2x16GB 키트는 초당 토큰 처리량 측면에서 32GB 단일 모듈보다 훨씬 더 뛰어난 성능을 보여줍니다.

실행하려는 모델의 규모에 따라 결정하세요. 주로 70억~80억 규모 모델을 실험하는 경우라면 16GB로도 충분합니다. 140억~320억 규모 모델을 실행하거나 향후 모델에 대비해 여유 용량을 확보하고 싶다면 32GB를 목표로 하는 것이 좋습니다. 그리고 700억 규모 모델을 고려 중이라면 64GB를 계획하세요.

현재의 로컬 AI 모델을 원활하게 처리하면서도 향후 확장 여지를 남겨두는 시스템을 구축하려면, 6000MT/s 또는 6400MT/s 속도의 CORSAIR VENGEANCE DDR5 64GB(2x32GB)와 같은 키트를 따라올 만한 제품은 거의 없습니다. 대용량 모델을 구동할 수 있는 용량, 빠른 추론을 위한 대역폭, 그리고 이 모든 것을 효율적으로 작동시키는 듀얼 채널 구성을 갖추고 있습니다. 소형 모델에 중점을 둔 더 간결한 구성을 구축한다면, 32GB(2x16GB) DDR5-6000 키트는 견고하고 비용 효율적인 시작점이 될 것입니다.

로컬 AI 전용으로 설계된: CORSAIR AI WORKSTATION 300

대규모 모델을 로컬에서 실행하는 데 진지하게 관심이 있지만 멀티 GPU 타워 시스템을 구축하고 싶지 않다면, CORSAIR AI WORKSTATION 300이 색다른 대안을 제시합니다. 이 제품은 AMD의 Ryzen AI MAX+ 395 프로세서를 기반으로 하며, 시스템의 128GB LPDDR5X-8000 메모리에서 최대 96GB의 VRAM을 활용할 수 있는 Radeon 8060S 내장 GPU를 탑재하고 있습니다. 이러한 용량이 바로 로컬 AI에 있어 이 제품을 흥미롭게 만드는 요소입니다. 현재 단일 소비자용 디스크리트 GPU의 VRAM 용량은 최대 32GB에 불과하기 때문에, GPT-OSS 120B(MXFP4 기준 약 63GB)와 같은 모델을 단일 카드에 로드하려면 모델을 여러 GPU에 분할하거나 시스템 RAM으로 오프로드해야만 가능합니다.

통합 메모리 아키텍처가 핵심적인 절충점입니다. 전용 GDDR7 VRAM이 제공하는 순수 대역폭은 포기해야 하지만, 그 대가로 LPDDR5X 속도의 GPU 접근 가능 메모리를 최대 96GB까지 확보할 수 있습니다. 즉, 기존에는 여러 개의 독립형 GPU나 대량의 CPU 오프로딩이 필요했던 700억~1,200억 파라미터 규모의 모델도, 카드 간에 레이어를 분할하거나 PCIe를 통해 가중치를 페이징할 필요 없이 단일 시스템의 GPU 메모리 경로에서 완전히 실행할 수 있게 됩니다.

이 시스템에는 가벼운 작업 처리를 위한 50 TOPS의 AI 가속 성능을 갖춘 AMD의 XDNA 2 NPU와 2.5 Gbps 이더넷, Wi-Fi 6E, 그리고 여러 개의 USB 4.0 포트가 포함되어 있습니다. 민감한 데이터를 다루는 법률, 의료, 금융 분야의 전문가들에게 있어, 이 수준의 AI 기능을 완전히 오프라인 상태에서 온프레미스로 활용할 수 있다는 점은 실질적인 측면에서 큰 이점입니다.

CORSAIR AI 소프트웨어 스택

로컬 AI 도구를 설치하고 올바르게 구성하는 과정은 종속성 충돌, 드라이버 버전 문제, 프레임워크 호환성 등 여러 가지 문제로 인해 가장 번거로운 단계 중 하나가 될 수 있습니다. CORSAIR AI 소프트웨어 스택은 이러한 번거로움을 해소하기 위해 설계된 단계별 설치 가이드 도구입니다. 이 도구는 AI 및 머신러닝 프레임워크부터 개발 환경, 크리에이티브 소프트웨어에 이르기까지 사용자의 하드웨어에 최적화된 적절한 도구를 선택하고 설치할 수 있도록 도와줍니다.

JOIN OUR OFFICIAL CORSAIR COMMUNITIES

Join our official CORSAIR Communities! Whether you're new or old to PC Building, have questions about our products, or want to chat about the latest PC, tech, and gaming trends, our community is the place for you.