매뉴얼 | 빠른 시작 가이드

코사이어 워크스테이션 PC

AI 워크스테이션 소개

CORSAIR AI 워크스테이션을 구매해 주셔서 감사합니다!

코사이어 AI 워크스테이션 구성품

상단 시트

전원 케이블

코세어 AI 워크스테이션 연결성

- 힘

- 성능 수준 선택기

- SD 4.0 카드 리더기

- 1x USB 4.0 Type-C 포트

- 2x USB 3.2 Gen 2 Type-A 포트

- 헤드폰/마이크 콤보 잭

- 2x USB 2.0 Type-A 포트

- HDMI 2.1 포트 1개 (FRL 8Gbps) – 4K 60fps HDR / 1440p 120fps

- 1x DP 1.4 (HBR3) – 4K 120fps / 5K 60fps (DSC 지원)

- 1x USB 4.0 Type-C 포트

- 1x USB 3.2 Gen 2 Type-A 포트

- 2.5GbE 이더넷 포트 1개 (RTL8125BG)

- 헤드폰/마이크 콤보 잭

- 전원 공급 커넥터

코세어 AI 워크스테이션 설정하기

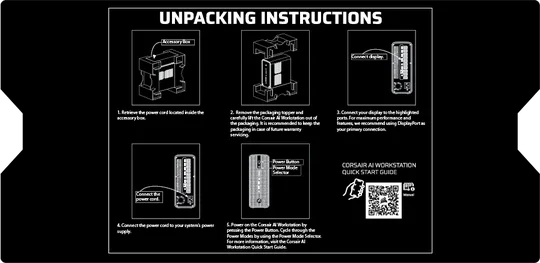

코세어 AI 워크스테이션 개봉기

CORSAIR AI 워크스테이션에는 데스크탑 후면에 설치될 전원 공급 장치 전원 코드가 함께 제공됩니다. 전원을 켜기 전에 모든 장치를 연결하여 시스템이 켜졌을 때 바로 사용할 수 있도록 하십시오.

- CORSAIR AI 워크스테이션을 포장재에서 안전하게 꺼내십시오.

- CORSAIR AI 워크스테이션에서 상단 및 하단 보호용 배송 삽입물을 제거하십시오.

- CORSAIR AI 워크스테이션을 책상 위에 놓고 설정 과정을 계속하십시오. 바닥에 설치할 경우, 보온 문제 발생 가능성을 방지하기 위해 털이 긴 카펫 위에는 두지 마십시오. 최상의 성능을 위해 CORSAIR AI 워크스테이션이 바닥에서 떨어져 설치되도록 하십시오.

코세어 AI 워크스테이션 연결

- 마우스와 키보드, 그리고 기타 장치를 케이스 후면에 위치한 메인보드의 USB 포트를 통해 데스크탑에 연결하십시오.

2. HDMI 또는 디스플레이 케이블을 사용하여 모니터를 DisplayPort 또는 HDMI 포트에 연결하십시오.

3. CORSAIR AI 워크스테이션은 내장형 Wi-Fi를 탑재하여 별도의 Wi-Fi 안테나가 필요하지 않습니다. 인터넷 접속을 위해 이더넷 케이블 사용을 선호하는 경우, 대신 이더넷 케이블을 연결하십시오(작동 시 비차폐형 RJ45 케이블 사용).

4. 전원 케이블을 전원 공급 장치에 연결한 후, 전원 케이블의 다른 끝을 가장 가까운 전원 콘센트에 연결하십시오. 서지 보호기를 사용하는 경우, 전원 케이블을 서지 보호기에 연결하십시오.

5. CORSAIR AI 워크스테이션의 전원을 켜려면 전면 패널에 위치한 전원 버튼을 누르십시오.

6. 시스템이 초기 부팅 과정을 거치면 사전 설치된 Windows 운영 체제를 로드합니다.

7. Windows의 안내에 따라 사용자 계정 생성을 완료하십시오.

성능 레벨 선택기

전면 패널 컨트롤

CORSAIR AI 워크스테이션은 세 가지 성능 모드(저소음, 균형, 최대)를 제공합니다. 시스템 전면의 전원 레벨 선택기를 사용하여 현재 작업에 가장 적합한 모드로 전환하십시오. 선택 내용을 확인하기 위한 상태 알림이 화면에 표시됩니다.

통합 메모리

CORSAIR AI WORKSTATION은 통합 메모리(Unified Memory) 기능을 탑재하여 CPU와 GPU가 동일한 고속 메모리를 공유함으로써, AI, 크리에이티브 및 전문 작업 부하에서 더 빠른 데이터 액세스와 향상된 성능을 제공합니다. 이를 통해 효율성이 개선되고 지연 시간이 단축되며, 고사양 AI, 렌더링 및 크리에이티브 작업 부하의 처리 속도가 빨라집니다. 아래 지침에 따라 그래픽 카드 메모리 할당 설정을 변경할 수 있습니다.

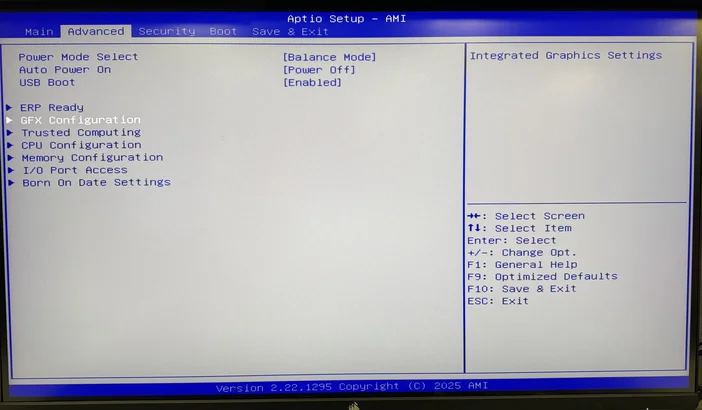

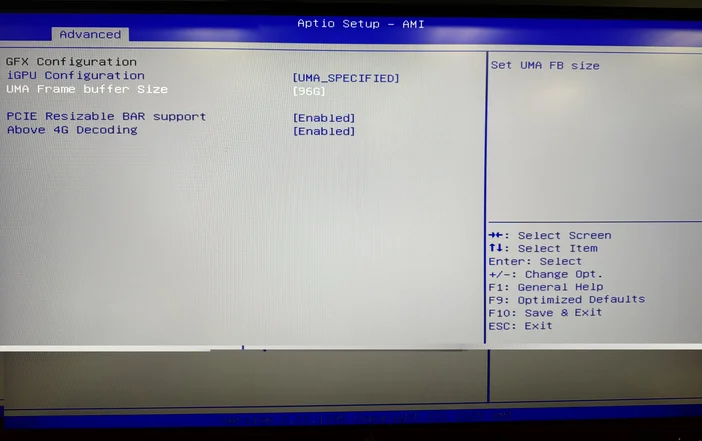

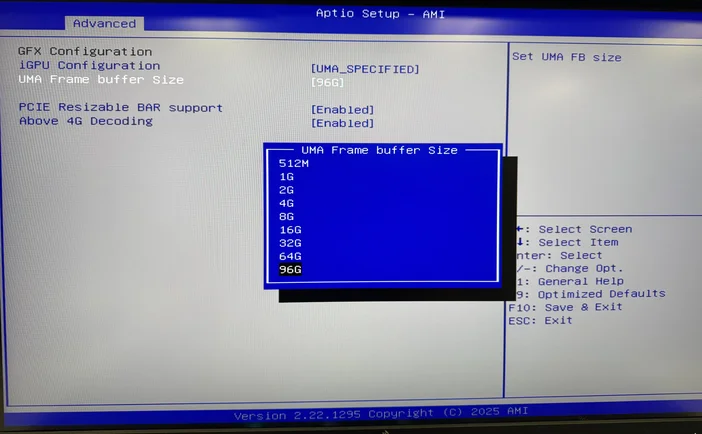

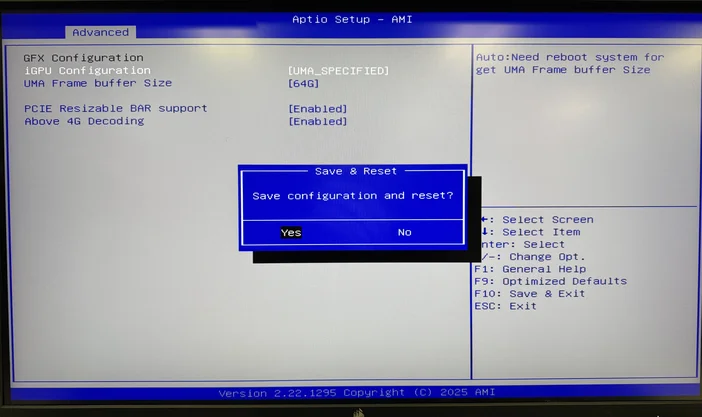

BIOS 명령어

1. 시스템 전원을 켭니다. CORSAIR 로고가 나타나면 즉시 키보드의 DEL 키를 눌러 BIOS 설정 화면으로 들어갑니다.

2. BIOS 시작 화면에서 ‘고급’ 탭을 찾아 선택합니다.

3. GFX 구성 옵션을 선택합니다.

4. UMA 프레임 버퍼 크기 옵션을 찾아 선택합니다. 참고: iGPU 구성, PCIe Resizable BAR 지원및 4G 초과 디코딩 설정은 아래 이미지와 같이 미리 설정되어 있어야 합니다.

5. 사용 가능한 UMA 프레임 버퍼 크기가 표시된 팝업 메뉴가 나타납니다. 현재 작업 부하에 가장 적합한 크기를 선택하십시오.

6. 선택을 마친 후 키보드의 F10 키를 누르고, ‘저장’을 선택하여 확인한 뒤 PC를 재시작하십시오.

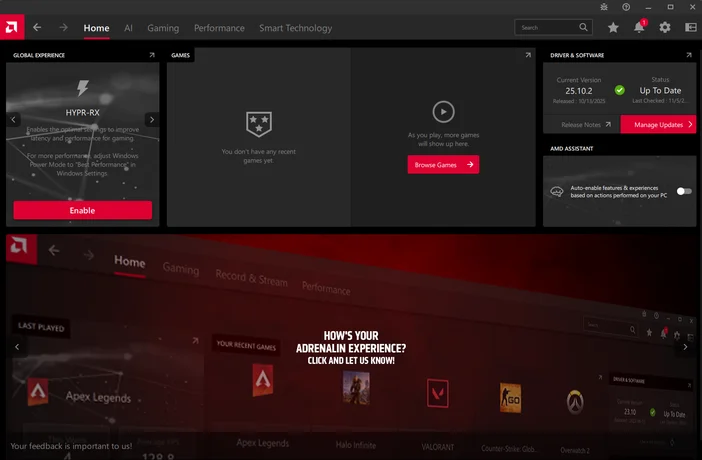

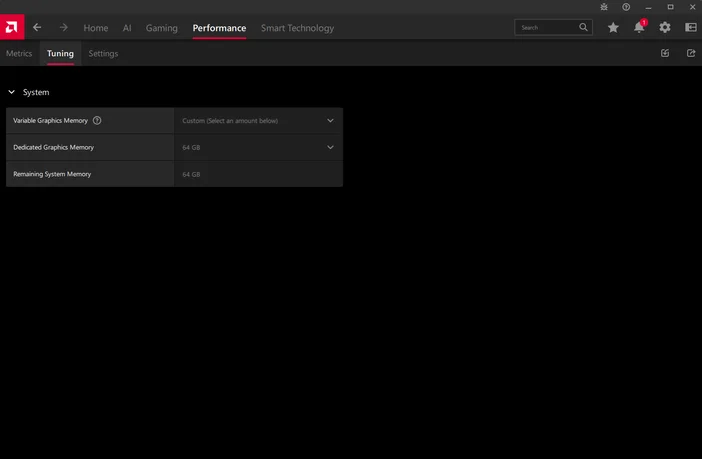

AMD 소프트웨어 사용 설명서

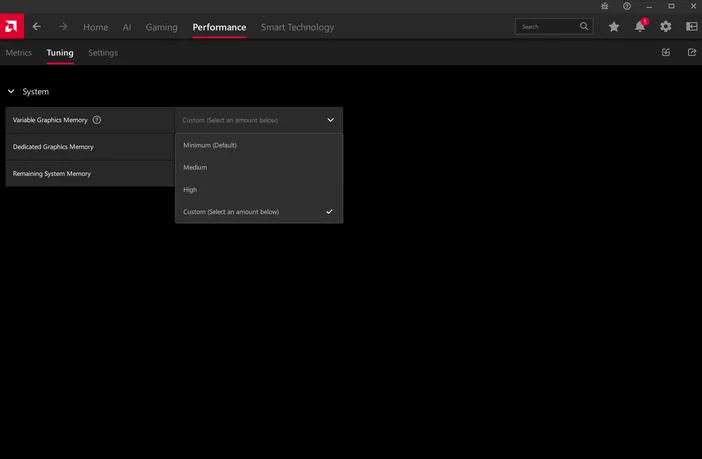

1. AMD SOFTWARE: Adrenaline Edition을 실행합니다.

2. 소프트웨어 창 상단의 ‘성능’ 탭을 선택한 다음, 아래 옵션에서 ‘튜닝’을 선택합니다.

3. ‘최소’, ‘중간’, ‘최대’라는 세 가지 사전 설정 옵션 중에서 선택하거나, ‘사용자 지정’을 선택하여 원하는 메모리 값을 직접 설정할 수 있습니다.

- 최소: 0.5GB 전용 그래픽 메모리

- 용량: 32GB 전용 그래픽 메모리

- 최대: 64GB 전용 그래픽 메모리

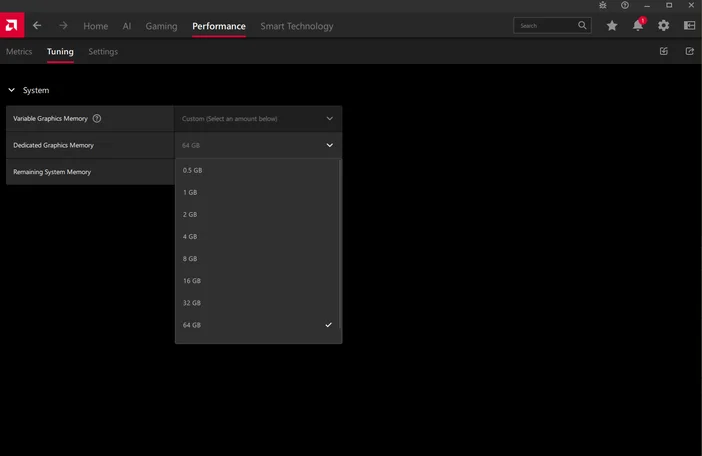

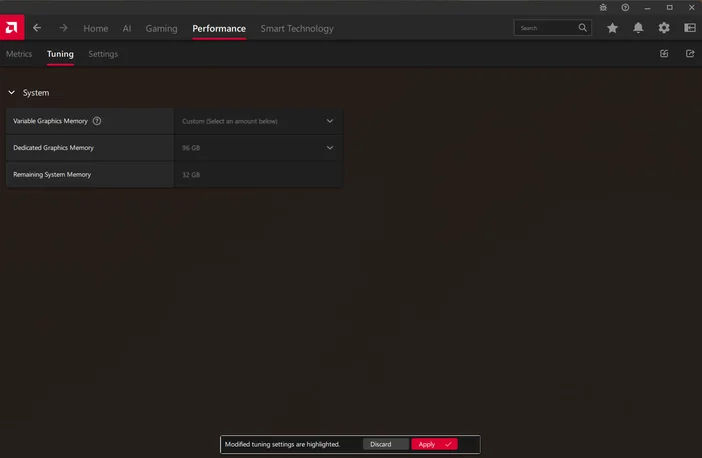

4. ‘사용자 지정’ 옵션을 선택한 경우, 드롭다운 메뉴에서 원하는 전용 그래픽 메모리 할당량을 선택할 수 있습니다.

5. 원하는 전용 그래픽 메모리 할당량을 선택하면 AMD 소프트웨어 하단에 재시작 안내 메시지가 표시됩니다. 안내에 따라 PC를 재시작하십시오.

코세어 AI 소프트웨어 스택

코세어 AI 소프트웨어 스택은 AI 워크스테이션 300과 같은 AI 중심 워크스테이션의 설정 경험을 간소화하기 위해 설계된 선별된 웹 기반 구성 및 설정 지원 도구입니다. 이 도구의 목표는 기술에 익숙하지 않은 사용자의 추측을 없애는 동시에 고급 사용자를 위한 유연성을 유지하는 것입니다.

워크스테이션 구성은 본질적으로 개인 맞춤형입니다 — 사용자의 도구, 모델, 워크플로우에 최적화되어 있죠. 하지만 많은 이들에게, 특히 로컬 AI, 대규모 언어 모델(LLM), 오픈소스 추론 도구를 처음 접하는 사람들에게는 초기 설정이 부담스러울 수 있습니다. Python, Git, PyTorch, Ollama, Anaconda, LangChain, Transformers 등과 같은 툴체인 설치에는 종종 명령줄 지식, 적절한 종속성 처리, 기술 용어 이해, 시스템 튜닝이 필요합니다.

https://www.corsair.com/ai-software-stack/index.html

코세어 AI 소프트웨어 스택은 다음과 같은 방법으로 이 과제를 해결합니다:

- 사용자가 최소한의 상호작용으로 설치할 수 있는 사전 검증된 툴킷.

- 일반적인 워크플로우를 위한 자동 구성 프리셋: LLM 추론, Whisper 음성 인식, ComfyUI 이미지 생성 등.

- 설정 및 사용자 지정을 위한 웹 기반 인터페이스 — 명령줄이 필요하지 않습니다.

- Jan.ai와 같은 오픈소스 프레임워크를 통해 모델(GPT-OSS, DeepSeek, LLaMA, Mistral, Gemma 등)을 실행하기 시작하려는 신규 사용자를 위한 빠른 온보딩.

- 선택적 활성화 — 고급 사용자는 설치를 완전히 거부하거나 필요한 구성 요소만 선택적으로 설치할 수 있습니다.

CORSAIR AI 소프트웨어 스택 FAQ

Q: CORSAIR AI 소프트웨어 스택이란 무엇입니까?

A: CORSAIR AI 소프트웨어 스택은 워크스테이션에서 AI 지원 및 개발자 도구를 설정하고 관리하는 데 도움을 주는 웹 기반 플랫폼입니다. 이 플랫폼은 두 부분으로 구성됩니다:

- 시스템에서 실행되어 기본 하드웨어 및 소프트웨어 정보를 수집하는 경량 설치 프로그램.

- 호환 가능한 AI 도구를 찾아보고 설치하며 워크플로를 통합할 수 있는 웹 포털.

Q: 어떻게 사용을 시작하나요?

A: 아래에 나열된 단계를 따르십시오.

- AI 소프트웨어 스택의 홈 페이지에서 시작하기를 선택하세요.

- 필요에 맞는 사용 사례를 선택하세요. 각 사용 사례의 '자세히 알아보기' 섹션에서 추가 정보를 확인할 수 있습니다.

- 시작할 모든 사용 사례를 선택한 후 다음을 클릭하십시오.

- 내 시스템 분석 버튼을 선택하세요. 그러면 기본 시스템 정보(CPU 브랜드, 운영 체제, CPU 유형, GPU 유형, 시스템 메모리 용량, 사용 가능한 저장 공간)를 수집하는 소형 애플리케이션이 다운로드됩니다. 이 애플리케이션은 선택한 도구의 설치도 처리합니다. 설치 후 원할 경우 제거할 수 있습니다.

- 추천 도구를 계속 보려면 제출을 선택하세요

- 툴킷 섹션을 살펴보고 설치하려는 도구(예: Ollama, Python, ComfyUI, Pytorch)를 선택하세요.

- 설치를 선택하십시오.

- 시스템 분석기 애플리케이션을 다운로드하십시오.

- 응용 프로그램을 실행하십시오.

- 설치 과정을 계속하려면 확인을 선택하십시오.

- 설치 진행 상황을 모니터링하십시오. 대부분의 애플리케이션은 백그라운드에서 설치됩니다. 필요한 설치 창이 나타나면 수동 설정을 안내해 줄 것입니다.

설치 프로그램 작동 방식

Q: 로컬 설치 프로그램은 무엇을 하나요?

A: 현지 설치 담당자:

- 시스템의 하드웨어(CPU, GPU, RAM, 저장 장치) 및 OS 버전을 감지합니다.

- 사용 가능한 AI 도구와의 호환성을 확인합니다

- 웹 포털에서 선택한 도구를 설치합니다

Q: 설치 프로그램이 AI 모델을 실행하나요?

A: 아니요. 자체적으로 데이터를 처리하거나 모델을 실행하지 않습니다. 단지 사용자가 설치하기로 선택한 AI 도구를 위해 작업 환경을 준비해 줄 뿐입니다.

툴킷 사용하기

Q: 툴킷이란 무엇인가요?

A: 툴킷은 웹 포털을 통해 이용 가능한 AI 애플리케이션 및 유틸리티의 선별된 목록입니다. 각 항목에는 다음이 포함됩니다:

- 이 도구의 기능에 대한 설명

- 최소 및 권장 시스템 요구 사항

- 단계별 설치 및 구성 가이드

Q: 툴킷에 나열되지 않은 도구를 추가할 수 있나요?

A: 네, 호환되는 소프트웨어는 수동으로 설치할 수 있습니다. 다만 AI 소프트웨어 스택의 자동 설치 및 업데이트 기능은 툴킷 내 도구에서만 작동합니다. 개발자 및 AI 환경은 거의 매일 변화하는 듯합니다. 저희는 많은 개발자가 활용하는 다양한 기본 도구를 제공하여 시작할 수 있도록 지원합니다.

개인정보 및 데이터 처리

Q: 현지 대리점은 어떤 정보를 수집하나요?

A: 기본 시스템 사양(하드웨어 구성, OS 버전, 설치된 드라이버)과 설치된 Stack 관리 도구 목록만 수집합니다. 개인 파일, 브라우징 기록 또는 다른 애플리케이션의 사용 데이터는 수집하지 않습니다.

Q: 제 정보가 클라우드에 전송되나요?

A: 아니요, 호환 가능한 도구를 추천하고 구성하는 데 필요한 기본 시스템 정보는 로컬에서만 사용됩니다. 개인 또는 프로젝트 데이터는 전송되지 않습니다.

Q: 제 데이터가 제3자와 공유되나요?

A: 아니요. 수집된 정보 중 Corsair, 자회사 또는 제3자와 공유되는 정보는 없습니다.

업데이트 및 지원

Q: AI 소프트웨어 스택은 얼마나 자주 업데이트되나요?

A: 로컬 에이전트와 웹 포털에 대한 업데이트가 정기적으로 제공되어 새로운 도구를 추가하고 호환성 감지 기능을 개선하며 설치 프로세스를 강화할 예정입니다. 이 도구는 기본 설정 도구로 설계되었으므로 대부분의 사용자는 시스템을 처음 가동할 때만 필요로 할 것입니다. 사용 사례를 탐색하고 개선하며 시스템을 필요에 맞게 맞춤 설정해 나가면서 GitHub, Hugging Face 등과 같은 다양한 저장소를 통해 도구를 직접 접근할 수 있습니다.

Q: 어디서 도움을 받을 수 있나요?

A: 웹 포털의 FAQ 및 지원 섹션에서 직접 문서와 지원 문서를 확인할 수 있습니다.

인공지능 소프트웨어 추천

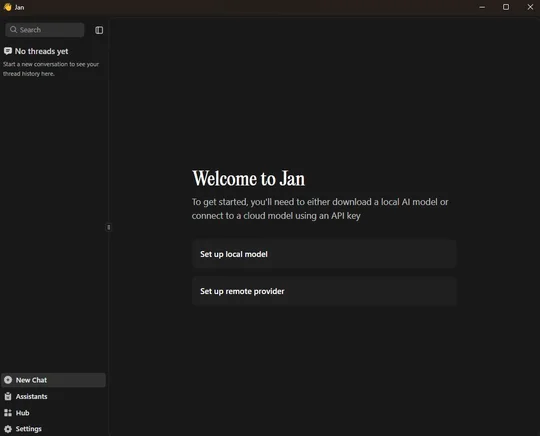

JAN.AI

CORSAIR AI 워크스테이션에는 Jan.ai가 포함되어 있습니다. Jan.ai는 사용자가 AI 상호작용을 완전히 통제할 수 있도록 설계된 오픈소스, 로컬 우선 AI 플랫폼입니다. 클라우드 기반 서비스에 의존하는 대신, Jan은 강력한 언어 모델을 직접 사용자의 하드웨어에서 실행할 수 있게 하여 프라이버시, 유연성 및 맞춤 설정을 제공합니다.

주요 측면은 다음과 같습니다:

- 로컬 운영 또는 클라우드 유연성: 모델을 로컬에서 실행하거나, 더 높은 컴퓨팅 성능이 필요할 때 OpenAI, Groq, Cohere와 같은 클라우드 API에 연결하세요.

- 모델 허브 접근성: 자체 모델 허브를 제공하여 Mistral, LLaMA, Gemma 등 오픈소스 모델에 대한 접근을 간소화하며, 효율적인 로컬 배포를 위한 GGUF 형식을 지원합니다.

- 로컬 API 서버: 로컬호스트:1337에서 수신 대기하는 OpenAI 호환 API를 포함하여, 표준 OpenAI 엔드포인트를 사용하는 기존 도구 또는 워크플로와의 연동을 가능하게 합니다.

- 확장 가능한 생태계: 확장 기능과 모델 컨텍스트 프로토콜(MCP)을 지원하여 AI가 Jupyter, Canva, 웹 브라우저 등의 도구와 상호작용할 수 있도록 합니다.

Jan.Ai는 특히 다음에 적합합니다:

- 개인정보 보호에 민감한 사용자: 모든 처리 및 저장이 로컬에서 이루어지므로 민감하거나 규제 대상 데이터 관리에 이상적입니다.

- 개발자 및 연구원: 다양한 대규모 언어 모델을 실험하고, 맞춤형 어시스턴트를 구축하거나, 개인용 AI 서버를 설정할 수 있습니다.

- 애호가 및 취미 활동가: 지역 AI 워크플로우를 탐색하거나, 모델을 오프라인에서 실행하거나, 반복적인 클라우드 비용을 피하고자 하는 모든 분에게 적합합니다.

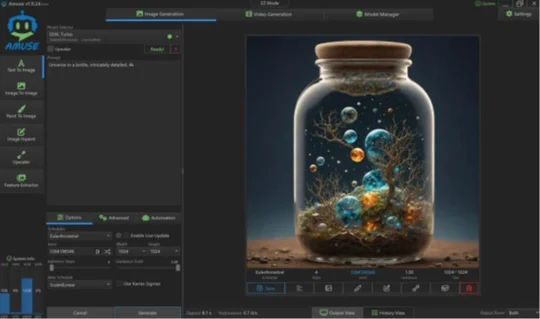

AMUSE.AI

AMUSE.AI(일반적으로 Amuse로 불림)는 TensorStack이 AMD와 협력하여 개발한 Windows PC용 무료 로컬 실행 AI 아트 및 영상 생성 도구입니다. Stable Diffusion 및 기타 고급 AI 모델을 활용하여 인터넷 연결, 계정 또는 구독 없이도 하드웨어에서 직접 창의적인 시각 자료를 생성하고 조작할 수 있게 합니다.

주요 특징:

- 즉석 창작을 위한 간편 모드: 설정 없이도 텍스트 프롬프트나 스케치로 멋진 작품을 즉시 생성해 보세요.

- 고급 제어 기능을 갖춘 전문가 모드: 이미지 생성, 필터링, 자동화를 포함한 정밀 조정된 기술적 제어를 위해 100개 이상의 AI 모델을 잠금 해제하세요.

- 맞춤형 AI 필터 및 디자인 도구: 기존 이미지에 생성형 필터를 적용하거나 스케치를 완성도 높은 작품으로 변환하세요.

- 텍스트-투-비디오 및 비디오 기능: Amuse는 이제 실험적인 비디오 생성을 지원합니다—텍스트를 비디오로 변환하고, 이미지를 비디오로 변환하며, 클립의 스타일을 변경할 수 있습니다.

- AMD 기반 초고해상도: 호환 하드웨어에서 AMD XDNA™ 초고해상도 기능은 향상된 선명도와 속도로 이미지를 업스케일링합니다.

- 개인적이고, 로컬이며, 무료: 모든 프로세스는 사용자의 PC에서 실행됩니다. 클라우드 개입이 없으므로 완전한 프라이버시를 보장합니다. 무엇보다도 개인용으로는 무료이며, 로그인이나 구독이 필요하지 않습니다.

Amuse.AI는 특히 다음에 적합합니다:

- 빠른 아트 제작: 텍스트나 스케치에서 즉시 이미지를 생성하려면 EZ 모드를 사용하세요.

- 이미지 편집 및 필터링: AI 필터를 적용하여 사진의 스타일, 톤 또는 분위기를 변경하세요.

- 스케치 확장: 디자인 모드를 통해 단순한 윤곽선을 세밀하고 완성도 높은 작품으로 변환하세요.

- 영상 콘텐츠 제작: 텍스트-영상 변환, 이미지-영상 변환 및 리스타일링 효과를 실험해 보세요.

- 고해상도 출력: AMD XDNA™를 사용하여 이미지를 업스케일링하여 선명한 시각적 출력을 구현합니다.

- 개인정보 보호 중심 워크플로우: 콘텐츠를 완전히 기기 내에서 생성합니다—데이터가 PC를 벗어나지 않습니다.

- AMD 하드웨어 쇼케이스: 강력한 AMD AI 지원 CPU, GPU 및 NPU의 완전한 활용을 시연합니다.

메타 라마 4 스카우트

라마 4 스카우트는 2025년 4월 출시된 메타의 차세대 라마 4 시리즈의 일부입니다. 이 모델은 총 1090억 개의 매개변수 중 16개의 전문가 모델을 활용하는 전문가 혼합(Mixture-of-Experts, MoE) 아키텍처로 구축된 170억 활성 매개변수 모델입니다. 본 모델은 텍스트와 이미지를 처리하고 다국어 텍스트 또는 코드 출력을 생성할 수 있는 네이티브 멀티모달 입력을 지원합니다.

주요 특징 및 장점:

- 효율적이면서도 강력함: 규모에도 불구하고 Llama 4 Scout는 최적화된 환경에서 단일 NVIDIA H100 GPU로도 실행될 만큼 컴팩트합니다.

- 높은 벤치마크 성능: 다양한 벤치마크에서 Google의 Gemma 3, Gemini 2.0 Flash-Lite, Mistral 3.1과 같은 모델들을 능가합니다.

- 개방형 라이선스(일부 제한 적용): 기술적으로는 접근 가능하나, 라마 4 모델은 대규모 상업적 사용자에 대해 라이선스 제한이 적용됩니다.

- 민감한 주제에 더 능숙: Llama 3.3에 비해 Llama 4(Scout 포함)는 논쟁적인 주제를 더 개방적으로 다루며, 프롬프트 거절률이 낮아지고 편향성이 감소했습니다.

사용 사례 및 응용 분야:

실용적인 측면에서, Llama 4 Scout가 빛을 발하는 부분은 다음과 같습니다:

- 대규모 문서 작업: 기술 문서, 법률 문서 아카이브, 코드베이스, 녹취록 등 방대한 데이터 구조를 분석하거나 요약하는 데 이상적이며, 수백만 토큰에 걸쳐 맥락을 유지합니다.

- 다중 모달 분석: 텍스트와 이미지를 처리하는 능력 덕분에 시각적 추론, 문서 이해, 이미지 캡션 생성이나 콘텐츠 생성 같은 활용 사례에 적합합니다.

- 다국어 및 다중 모드 출력: 챗봇, 코딩 지원, 또는 다국어 콘텐츠 생성 및 번역에 탁월합니다.

- 효율적인 배포: 대규모 GPU 클러스터 없이도 강력한 AI를 배포하려는 연구실이나 기업에 탁월한 선택지입니다.

Strix Halo 128GB에서 Meta Llama 4 Scout 실행 방법:

참고: 다음 단계는 개발자 모드 또는 파워 유저 모드에서 작업할 때만 적용됩니다. Meta Llama 4는 안정적인 작동을 위해 최소 96GB의 메모리가 필요합니다.

- 제공된 Adrenalin Preview Press 드라이버 를 설치하십시오.

- AMD Adrenalin 소프트웨어를 실행합니다. 성능 탭을 클릭합니다. 튜닝 탭을 클릭합니다. 가변 그래픽 메모리 항목 앞에서 드롭다운을 96GB로 변경하고 적용을 클릭합니다(이 작업으로 인해 재시작이 발생합니다).

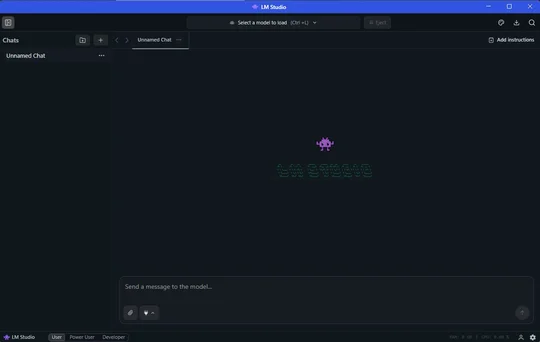

- LM Studio 설치하기. LM Studio - 로컬 LLM을 발견하고, 다운로드하고, 실행하세요.

- 실행하고 "온보딩 건너뛰기"를 클릭하세요

- 발견 탭(돋보기 아이콘)으로 이동하세요.

- 왼쪽의 "런타임"을 클릭하고, 업데이트가 대기 중인 경우 업데이트를 클릭하십시오.

- 오른쪽에서 (Vulkan) llama.cpp가 기본 런타임으로 선택되었는지 확인하십시오.

- 지금 "모델 검색" 드로워를 클릭하고 "lmstudio community llama 4 scout"를 검색하세요.

- 드롭다운 상자 오른쪽에서 Q4 K M 버전을 선택하고 다운로드하십시오. 용량은 67GB입니다.

10. 모델 다운로드가 완료되면 "채팅" 탭으로 돌아가 중앙 드롭다운 메뉴를 클릭하세요. "매개변수 수동 선택"이 선택되어 있는지 확인한 후 모델 이름인 Llama 4 Scout를 클릭하세요.

11. GPU 오프로드 레이어를 100%(48/48)로 최대화하십시오.

a. --gpu-layers 플래그 사용: GPU Layers(또는 -ngl) 인수를 사용하여 GPU로 오프로드할 레이어 수를 지정합니다.

b. 값 설정: 모든 레이어를 GPU로 오프로드하려면 값을 48로 설정하십시오.

예시 프롬프트:./llama-cli --model llama4-scout-model.gguf --n-gpu-layers -48

12. 모델 로드를 클릭합니다.

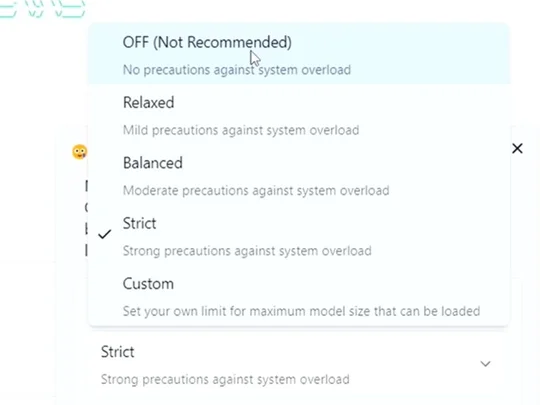

13. 처음 로드할 때 다음과 같은 가드레일 메시지가 표시될 수 있습니다. 표시되면 반드시 OFF로 설정하십시오:

14. 모델을 로드합니다(수동 로드 매개변수가 선택되었는지, GPU 오프로드 레이어가 100%인지 확인).

15. 채팅!

16. 참고: 채팅 영역의 "이미지" 아이콘을 클릭하면 LLM에 이미지를 제공하여 시각 능력을 테스트할 수 있습니다.

17. 참고: 이 단계들은 개발자 및 고급 사용자 모드에서만 작동합니다 .

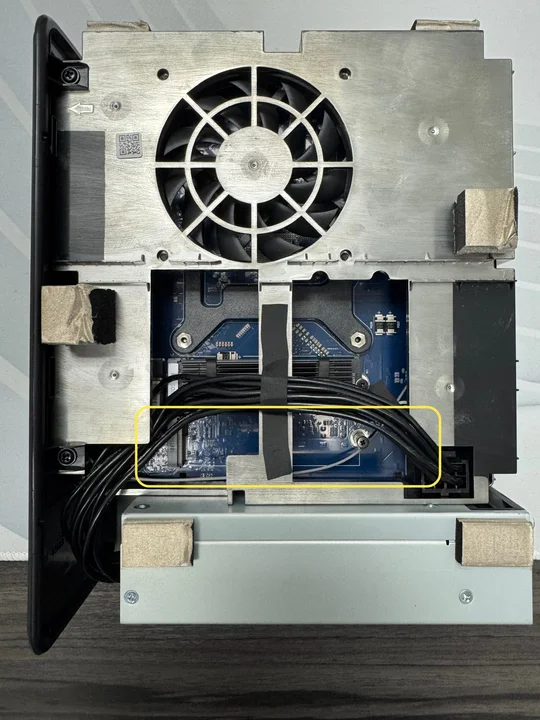

스토리지 업그레이드

저장 장치 설치

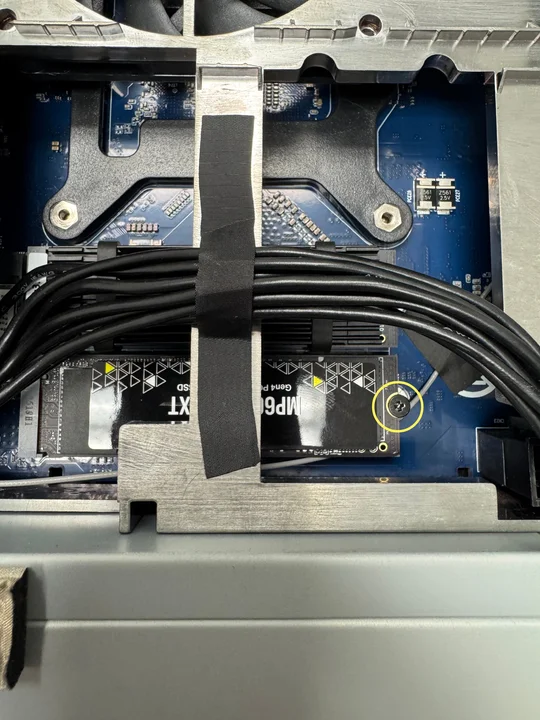

저장 용량을 더 늘리고 싶다면, 두 번째 NVMe SSD를 추가로 설치할 수 있습니다.

참고: 올바른 장착을 위해, 저프로파일 방열판이 장착된 NVMe SSD나 방열판이 없는 NVMe SSD를 설치하는 것이 가장 좋습니다.

저장 공간을 변경하거나 추가로 설치하려면 아래에 나열된 지침을 따르십시오.

- 아래 표시된 나사 9개를 풀어서 후면 패널을 제거하십시오.

2. 후면 패널을 조심스럽게 제거하십시오.

3. 내부 트레이를 밀어 케이스 전면으로 밀어낼 수 있도록 적당히 힘을 가하세요. 트레이를 잡을 수 있을 만큼 충분히 노출되면, 트레이를 케이스에서 조심스럽게 빼내세요.

4. 메인보드의 두 번째 M.2 슬롯을 찾아 NVMe SSD 저장 장치 드라이브를 설치하십시오.

5. NVMe SSD 저장 드라이브를 미리 설치된 나사로 고정하십시오.

6. 설치 완료 후 메인보드 트레이를 케이스에 다시 장착하십시오.

7. 후면 패널을 제자리에 다시 설치하십시오.

8. 후면 패널을 9개의 나사로 고정하십시오.

최신 설정 및 문서에 접근하기

드라이버 및 소프트웨어 접근

CORSAIR AI WORKSTATION에는 사용에 필요한 모든 드라이버와 소프트웨어가 미리 설치되어 있습니다. 최신 버전의 드라이버와 소프트웨어는 Corsair.com 제품 지원 페이지의 “다운로드” 섹션에서 확인하실 수 있습니다.

준수 성명서

코사이어는 자사 제품을 수출하는 각국의 법률 및 규정을 준수하기 위해 최선을 다하고 있습니다. 코사이어 제품은 의도된 용도로 사용될 때 제품 안전성, 전자기적 호환성 및 기타 필수 규제 요건에 대한 전 세계적 기준을 충족하도록 설계 및 테스트되었습니다.

제한적 제품 보증

CORSAIR는 공인 CORSAIR 판매처에서 CORSAIR AI WORKSTATION 제품을 구매한 구매자에게 양도 불가능한 2년 보증을 제공합니다. CORSAIR는 구매자가 제품을 수령한 날로부터 시작되는 지정된 기간 동안 해당 제품에 재료 및 제조상의 결함이 없음을 보증합니다. 보증 기간은 사용자 설명서, 제품 포장 또는 첨부된 CORSAIR 보증 기간 목록에 명시된 바와 같이 제품별로 다를 수 있습니다. 이러한 보증 기간이 서로 상이할 경우, 가장 긴 보증 기간이 적용됩니다.

적용 가능한 현지 법률에 의해 금지된 경우를 제외하고, 본 보증은 최초 구매자에게만 적용되며 양도할 수 없습니다. 보증 권리를 행사하려면 구매 영수증을 제시하고 제품 일련번호 정보를 제공해야 합니다. 본 보증은 귀하에게 특정 법적 권리를 제공하며, 현지 법률에 따라 추가 권리가 있을 수 있습니다.

일반적으로 본 보증은 CORSAIR 하드웨어 제품이 보증 기간 동안 데이터 시트에 명시된 공개된 기술 사양에 따라, 그리고 해당 제품이 의도된 작동 환경에서 정상적으로 작동할 것임을 의미합니다.

구제 수단

공개된 기술 사양에 따라 정상적으로 작동하지 않는 CORSAIR 제품에 대해 CORSAIR가 부담하는 전체 책임 및 귀하에게 제공되는 유일한 구제 수단은 CORSAIR의 재량에 따라 CORSAIR의 비용으로 제품을 교체해 드리는 것입니다. 이 보증 의무는 해당 하드웨어를 구매처 또는 CORSAIR가 지정한 다른 장소로 반품하고, 원본 구매 영수증을 첨부하는 것을 조건으로 합니다. 귀하는 배송 및 취급 비용은 물론, 적용되는 관세, 관세, 세금 또는 기타 수수료를 부담해야 할 수 있습니다. CORSAIR는 재량에 따라 새 제품 또는 재생산된 제품을 제공할 수 있습니다.

교체된 제품에 대해서는 원래 보증 기간의 잔여 기간 또는 30일 중 더 긴 기간, 혹은 현지 법률에서 요구하는 기간 동안 보증이 적용됩니다.

구형 또는 단종 제품

단종되거나 생산이 중단된 제품은 재고가 있는 경우 동일한 제품으로 교환해 드립니다. CORSAIR가 단종되거나 생산이 중단된 제품을 동일한 제품으로 교환할 수 없는 경우, CORSAIR는 단독 재량에 따라 해당 제품을 유사한 기능과 용량을 갖춘 제품으로 교환해 드립니다.

제외 사항

본 보증은 다음 사항으로 인해 발생하는 문제 또는 손상을 포함하되 이에 국한되지 않습니다:

- 정상적인 사용으로 인한 마모 및 손상.

- 모든 개조, 오용, 사고, 분해, 부적절한 사용 또는 무단 수리.

- 일련번호 라벨, 제조사 모델명 또는 부품 번호 라벨이 분실되었거나 훼손되었거나, 기타 이유로 판독할 수 없는 경우.

- 제공된 제품 설명서에 부합하지 않는 사용을 포함한 모든 부적절한 조작.

- 부적절한 전압 공급원에의 연결.

- 제품의 재료 또는 제조상의 결함과 관련이 없는 기타 모든 원인.

또한 본 보증에서 제외되는 대상에는 위조 제품이 포함됩니다. 즉, CORSAIR가 단독 재량에 따라 CORSAIR 또는 그 공인 제조 파트너가 제조하지 않은 것으로 판단한 제품이 이에 해당합니다.

저작권/법적 정보

저작권/법적 정보

© 2025 CORSAIR MEMORY, Inc. 모든 권리 보유. CORSAIR 및 돛 로고는 미국 및/또는 기타 국가에서 CORSAIR의 등록 상표입니다. 기타 모든 상표는 해당 소유자의 재산입니다. 제품은 사진과 약간 다를 수 있습니다.

책임의 제한

코세어는 이익, 수익 또는 데이터의 손실을 포함하되 이에 국한되지 않는 어떠한 특별, 부수적, 간접적 또는 결과적 손해에 대해서도 책임을 지지 않습니다. (직접적이든 간접적이든) 또는 상업적 손실에 대해 어떠한 책임도 지지 않습니다. 이는 코세어가 그러한 손해의 가능성에 대해 사전에 통지받은 경우에도 마찬가지입니다. 일부 지역 법률은 특별, 간접, 부수적 또는 결과적 손해의 배제나 제한을 허용하지 않으므로, 이러한 제한 또는 배제가 귀하의 관할권에서는 적용되지 않을 수 있습니다.

FCC ID: RAS-MT7925B22M 포함

IC: 7542A-MT7925B22M 포함