BLOG

Minne för lokala LLM: Hur mycket RAM-minne behövs? (och när hastigheten spelar roll)

Senast uppdaterad:

Att köra en stor språkmodell på sin egen hårdvara är en av de mest praktiska sakerna man kan göra med AI just nu. Oavsett om du experimenterar med kodningsassistenter, bygger en privat chattbot eller bara är nyfiken på vad open source-modeller kan göra, dyker en fråga omedelbart upp: hur mycket minne behöver jag egentligen?

Svaret beror på vilken modell du vill köra, hur du planerar att köra den och om du lägger större vikt vid att modellen ska passa överhuvudtaget eller om du vill ha snabba och responsiva resultat. Minneskapaciteten är det som ger dig tillgång till systemet. Minneshastigheten avgör hur smidig upplevelsen känns när du väl är inne i systemet.

Varför minnet är flaskhalsen

När man kör en stor språkmodell lokalt måste hela modellen ligga i minnet medan den genererar text. Till skillnad från spel eller videoredigering, där data strömmar in och ut ur minnet efter behov, laddar LLM-inferens hela uppsättningen modellvikter och håller dem kvar i minnet. Varje enskilt token som modellen genererar måste passera genom dessa vikter.

Det innebär att minneskapaciteten är den avgörande faktorn. Om du inte har tillräckligt med RAM- eller VRAM-minne för att rymma modellen kan du antingen inte köra den alls, eller så hamnar en del av modellen på långsammare lagringsutrymme, vilket försämrar prestandan dramatiskt. I vissa fall kan det handla om en 5 till 30 gånger lägre hastighet.

Men kapaciteten är bara halva sanningen. När modellen väl får plats i minnet blir den hastighet med vilken systemet kan mata in dessa vikter till processorn den främsta begränsande faktorn för hur snabbt resultaten genereras. Det är minnesbandbredd, och det är därför RAM-minnets hastighet och konfiguration spelar en större roll för lokal AI än för nästan alla andra arbetsbelastningar på en stationär dator.

RAM eller VRAM: Vilket är viktigast?

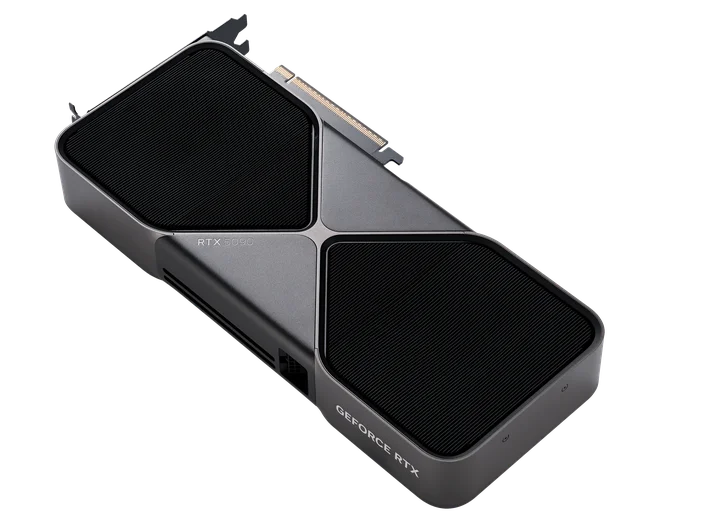

Om du har ett dedikerat grafikkort med tillräckligt med VRAM är det den snabbaste vägen. Grafikkortets minne (VRAM) har betydligt högre bandbredd än systemminnet; ett modernt grafikkort som ett RTX 4090 eller RTX 5090 kan leverera över 1 TB/s i minnesbandbredd, medan även snabbt DDR5-systemminne i en typisk tvåkanals-konfiguration för stationära datorer maxar på omkring 90 GB/s.

Det är just denna skillnad i bandbredd som gör att en modell som ryms helt i VRAM kan generera 40 eller fler token per sekund, medan samma modell som körs från systemminnet kanske klarar 8 till 15 token per sekund på en snabb CPU-konfiguration. Båda är användbara, men skillnaden i respons är märkbar.

Haken är att grafikkort för konsumentmarknaden har en maximal VRAM-kapacitet på 24 GB (på kort som RTX 4090 och RTX 5090), vilket begränsar dig till modeller med ungefär 14 miljarder parametrar vid god kvalitet, eller upp till cirka 32 miljarder med aggressiv kvantisering. Om du vill köra större modeller, med 70 miljarder parametrar eller mer, kommer du troligen att behöva utnyttja systemets RAM-minne, använda flera GPU:er eller acceptera vissa prestandakompromisser med partiell avlastning.

Hur mycket RAM-minne behöver du? En praktisk genomgång

Här blir det mer konkret. Hur mycket minne en modell kräver beror på antalet parametrar och den precision (kvantiseringsnivå) som används. En grov tumregel är att man vid Q4-kvantisering (4-bitars) kan räkna med att behöva cirka 0,5 till 0,6 GB per miljard parametrar, plus extra resurser för kontext och operativsystemet.

8 GB: Startpunkt

Med totalt 8 GB systemminne (eller VRAM) kan du utan problem köra mindre modeller i parameterintervallet 1B till 7B med 4-bitars kvantisering. Det gäller till exempel modeller som Llama 3.2 3B, Phi-4 Mini, Qwen 3 4B och Mistral 7B (vid Q4). Dessa är förvånansvärt kapabla för uppgifter som sammanfattning, enkel kodgenerering och konversationsbaserade frågor och svar.

Räkna med cirka 40 till 50 token per sekund på ett hyfsat grafikkort, eller 15 till 20 token per sekund på en CPU. Det fungerar utmärkt för chattliknande interaktioner.

16 GB: Det perfekta valet för de flesta

16 GB öppnar dörren till 7B- och 8B-modeller med högre kvantisering (Q8 för bättre kvalitet) samt 13B- till 14B-modeller vid Q4. Det är här modeller som Llama 3.1 8B, Qwen 3 8B och DeepSeek-R1-Distill 14B blir praktiskt användbara. Du får också tillräckligt med utrymme för att köra operativsystemet och andra appar parallellt med modellen utan att allt stannar upp.

För de flesta som experimenterar med lokal AI är 16 GB DDR5 en realistisk utgångspunkt. Du kommer att få bra resultat med de mest populära öppen källkodsmodellerna och slipper känna att minnet hela tiden är otillräckligt.

32 GB: Avancerad lokal AI

Med 32 GB har du tillräckligt med utrymme för att smidigt köra modeller med 32 miljarder parametrar och modeller med 70 miljarder parametrar med kraftig kvantisering (Q2 eller Q3). Modeller som Qwen 3 32B, DeepSeek-R1-Distill 32B och Gemma 3 27B passar bra här. Dessa modeller erbjuder märkbart bättre resonemang, längre sammanhängande utdata och bättre prestanda vid komplexa uppgifter jämfört med sina mindre motsvarigheter.

Om du använder lokala stora språkmodeller (LLM) för utvecklingsarbete, skrivhjälp eller andra uppgifter där kvaliteten på resultatet är viktig, är det först vid 32 GB som upplevelsen börjar kännas riktigt bra. Ett minneskit som CORSAIR VENGEANCE DDR5 64 GB (2x32 GB) med 6000 MT/s ger dig den kapacitet och bandbredd som krävs för att hantera dessa arbetsbelastningar utan att behöva kompromissa.

64 GB och mer: Att köra stora modeller

Om du vill köra modeller med 70 miljarder parametrar på rimliga kvantiseringsnivåer (Q4 eller Q5) behöver du 64 GB systemminne, och helst en konfiguration med flera GPU:er eller ett system som stöder partiell GPU-avlastning. Llama 3.3 70B på Q4 kräver cirka 42 GB enbart för modellvikterna, utan att räkna med kontextfönstret och operativsystemets overhead.

På den här nivån blir minnesbandbredden ännu viktigare. Varje generering av token kräver att tiotals gigabyte med vikter strömmas, och snabbare RAM innebär direkt snabbare resultat. Det här är en konfiguration i workstation-klass, men det blir allt vanligare bland yrkesverksamma som vill behålla känslig data på enheten samtidigt som de arbetar med öppna modeller i frontier-klass.

Varför RAM-minnets hastighet är viktig, inte bara kapaciteten

Här är något som överraskar många: när det gäller lokal LLM-inferens är minnesbandbredden ofta viktigare än ren beräkningskraft. Efter att det första tokenet har genererats (vilket är beräkningsbegränsat) är varje efterföljande token minnesbegränsat. Modellen måste strömma hela sin viktsats genom processorn för varje token, och hastigheten på denna strömning styrs av minnesbandbredden.

Praktiska jämförelser visar tydligt skillnaden. Det har visat sig att ett byte från DDR5-4800 till DDR5-6000 förbättrar hastigheten för generering av token med 20 till 23 procent för modeller som Mistral 7B och Llama 3.1 8B som körs på CPU. Det är en betydande och märkbar förbättring av responsen, och den beror uteslutande på snabbare minne.

Konfigurationer med dubbla kanaler spelar också en enorm roll. Att använda två RAM-moduler i dubbelkanalsläge fördubblar i praktiken den tillgängliga bandbredden jämfört med en enda modul. I praktiken kan det innebära 30 till 50 procent snabbare inferens. Om du bygger eller uppgraderar ett system för lokal AI ska du alltid använda två moduler i dubbelkanalsläge, aldrig en enda DIMM.

Kvantisering: Hur man får plats med större modeller i mindre minne

Kvantisering är den teknik som gör det möjligt att använda lokala stora språkmodeller (LLM) på vanlig hårdvara. Den komprimerar modellens vikter från deras ursprungliga 16-bitars flyttal (FP16) till mindre representationer, vanligtvis 4-bitars (Q4), 5-bitars (Q5) eller 8-bitars (Q8). Avvägningen är en liten försämring av utdatakvaliteten mot en kraftig minskning av minneskraven.

Vid Q4_K_M-kvantisering (det vanligaste formatet för lokal användning) minskar storleken på en 8B-modell från cirka 16 GB till ungefär 5–6 GB. En 70B-modell går från 140 GB till cirka 40–42 GB. Det innebär en minskning av minnesbehovet med 75 procent, och i de flesta praktiska tillämpningar är skillnaden i kvalitet knappt märkbar.

Q5_K_M erbjuder något bättre kvalitet till en ungefär 15–20 procent högre minneskostnad och är värt att överväga om du har tillräckligt med minnesutrymme. Q8 bevarar nästan hela den ursprungliga modellkvaliteten men halverar endast minneskraven; det är det rätta valet när du har gott om minne och vill ha bästa möjliga resultat.

Verktyg som Ollama och LM Studio hanterar kvantiserade modeller direkt, så du behöver inte göra någon konvertering själv. Välj bara den kvantiseringsnivå som passar ditt tillgängliga minne.

Kontextlängd: Den dolda minneskostnaden

Varje kontextdel (den text du skickar till modellen plus den text den genererar) kräver extra minne utöver själva modellens vikter. Korta konversationer är inga problem, men om du matar in långa dokument eller sparar omfattande chattloggar kan kontextminnet snabbt ta upp mycket utrymme.

Som en grov riktlinje kan man säga att 8 000 kontexttoken motsvarar ungefär 1 GB per 10 miljarder parametrar. Om man ökar det till 32 000 token blir det ytterligare 4 GB. Vissa nyare modeller stöder 128 000 token eller fler, vilket i praktiken kan fördubbla det totala minnesbehovet.

Om du planerar att regelbundet använda långa kontexter, till exempel genom att mata in hela kodbaser eller omfattande dokument i en modell, bör du räkna med extra minne utöver det som modellens vikter i sig kräver. Detta är ytterligare ett skäl till att konfigurationer på 32 GB eller 64 GB är lämpliga för seriös lokal AI-användning.

Populära modeller och vad de behöver

Här följer en översikt över några av de mest använda lokala modellerna just nu, med uppskattat minnesbehov vid Q4_K_M-kvantisering:

- Phi-4 Mini (3,8 GHz): ~2,3 GB, fungerar utmärkt på nästan vad som helst

- Qwen 3.5 4B: ~3,4 GB, utmärkt för enklare uppgifter med starkt resonemang

- Llama 3.2 8B: ~5 GB, en pålitlig liten modell för allmänna ändamål

- Qwen 3 8B: ~5 GB, stark prestanda inom flerspråkighet och resonemang

- Qwen 3.5 9B: ~6,6 GB, den senaste mindre modellen med förbättrade funktioner

- DeepSeek-R1-Distill 14B: ~9 GB, utmärkt resonemangskapacitet i ett kompakt format

- Gemma 3 12B: ~8 GB, Googles effektiva alternativ i mellanklassen

- Llama 4 Scout (109 miljarder MoE, 17 miljarder aktiva): ~10 GB vid aggressiv kvantisering, Metas senaste modell, fungerar förvånansvärt bra tack vare MoE-arkitekturen

- Qwen 3.5 27B: ~17 GB, en kraftfull allround-modell som passar i ett 24 GB VRAM-minne

- Qwen 3 32B: ~20 GB, hög prestanda, ryms i 24 GB VRAM

- Qwen 3.5 35B-A3B (MoE): ~24 GB, totalt 35B men endast 3B aktiva per token, mycket effektivt

- Llama 3.3 70B: ~42 GB, nästan toppklassig kvalitet, kräver mycket RAM-minne

- DeepSeek-R1-Distill 70B: ~42 GB, förstklassig resonemangsförmåga för lokal användning

- GPT-OSS 120B: ~63 GB, OpenAI:s modell med öppen vikt, kräver minst 64 GB enhetligt RAM-minne eller system-RAM

- Qwen 3.5 122B-A10B (MoE): ~81 GB, flaggskeppsklass med endast 10 miljarder aktiva parametrar

Dessa siffror avser endast modellvikter vid Q4_K_M-kvantisering. Lägg till 2 till 8 GB för kontext, operativsystemets overhead och eventuella andra program som körs parallellt. MoE-modeller (Mixture of Experts) som Llama 4 Scout och Qwen 3.5 35B-A3B är särskilt minneseffektiva vid inferens, eftersom endast en bråkdel av deras totala antal parametrar är aktiva per token.

Att välja rätt minne för lokal AI

Med utgångspunkt i allt ovanstående bör du tänka på följande när det gäller minneskonfigurationen för lokala LLM:

Välj DDR5 om din plattform stöder det. Bandbreddsfördelen jämfört med DDR4 är påtaglig och påverkar direkt inferenshastigheten. DDR5-6000 eller snabbare erbjuder den perfekta balansen mellan pris, kompatibilitet och prestanda för AI-arbetsbelastningar.

Använd alltid dubbelkanalsläge. Två RAM-minnen ger betydligt bättre prestanda än ett enda minne med samma totala kapacitet vid LLM-inferens. Ett 2x16 GB-kit slår ett enda 32 GB-minne med stor marginal när det gäller antal token per sekund.

Välj storlek utifrån vilka modeller du vill köra. Om du främst experimenterar med modeller på 7–8 miljarder parametrar räcker det med 16 GB. Om du vill köra modeller på 14–32 miljarder parametrar eller ha utrymme för framtida modeller är 32 GB ett bättre val. Och om du har planer på att köra modeller på 70 miljarder parametrar bör du räkna med 64 GB.

För ett system som klarar dagens lokala AI-modeller bra och samtidigt lämnar utrymme för framtida utbyggnad är ett kit som CORSAIR VENGEANCE DDR5 64 GB (2x32 GB) med 6000 MT/s eller 6400 MT/s svårt att slå. Du får kapacitet för stora modeller, bandbredd för snabb inferens och en dubbelkanalskonfiguration som gör att allt fungerar effektivt. Om du bygger en mer kompakt konfiguration med fokus på mindre modeller är ett 32 GB (2x16 GB) DDR5-6000-kit en stabil och kostnadseffektiv utgångspunkt.

Skräddarsydd för lokal AI: CORSAIR AI WORKSTATION 300

Om du verkligen vill köra stora modeller lokalt men inte vill bygga ett torn med flera grafikkort erbjuder CORSAIR AI WORKSTATION 300 ett alternativt tillvägagångssätt. Den är byggd kring AMD:s Ryzen AI MAX+ 395-processor med en integrerad Radeon 8060S-GPU som kan komma åt upp till 96 GB VRAM från systemets 128 GB LPDDR5X-8000-minne. Den kapaciteten är det som gör den intressant för lokal AI: en enskild diskret konsument-GPU har idag som mest 32 GB VRAM, så att ladda något som GPT-OSS 120B (cirka 63 GB vid MXFP4) på ett kort är inte möjligt utan att dela upp modellen över flera GPU:er eller avlasta till systemets RAM-minne.

Den samordnade minnesarkitekturen är den avgörande avvägningen. Du avstår från den råa bandbredden hos dedikerat GDDR7 VRAM, men i utbyte får du upp till 96 GB minne som är tillgängligt för GPU:n med LPDDR5X-hastigheter. Det innebär att modeller i parameterintervallet 70B till 120B, som annars skulle kräva flera diskreta GPU:er eller omfattande avlastning av CPU:n, kan köras helt på GPU-minnesvägen på en enda maskin, utan att dela upp lager mellan kort eller sidväxla vikter via PCIe.

Systemet innehåller även AMD:s XDNA 2 NPU med 50 TOPS AI-acceleration för enklare uppgifter, 2,5 Gbps Ethernet, Wi-Fi 6E och flera USB 4.0-portar. För yrkesverksamma som arbetar med känslig information inom juridik, medicin och finans är det en betydande praktisk fördel att ha denna nivå av AI-kapacitet helt offline och lokalt.

CORSAIR:s AI-programvarupaket

Att installera och konfigurera lokala AI-verktyg på rätt sätt kan vara en av de mest frustrerande delarna av processen – beroendekonflikter, drivrutinsversioner och kompatibilitetsproblem med ramverk. CORSAIR AI Software Stack är ett verktyg för guidad installation som är utformat för att undanröja dessa problem. Det hjälper dig att välja och installera rätt verktyg för ditt system, från ramverk för AI och maskininlärning till utvecklingsmiljöer och kreativ programvara – allt anpassat efter din hårdvara.

JOIN OUR OFFICIAL CORSAIR COMMUNITIES

Join our official CORSAIR Communities! Whether you're new or old to PC Building, have questions about our products, or want to chat about the latest PC, tech, and gaming trends, our community is the place for you.