BLOG

Memoria per i modelli di linguaggio locali (LLM): quanta RAM serve? (e quando la velocità è fondamentale)

Ultimo aggiornamento:

Eseguire un modello linguistico di grandi dimensioni sul proprio hardware è una delle cose più concrete che si possano fare oggi con l'IA. Che si tratti di sperimentare con assistenti di programmazione, di creare un chatbot privato o semplicemente di scoprire cosa sono in grado di fare i modelli open source, c'è una domanda che sorge spontanea: di quanta memoria ho effettivamente bisogno?

La risposta dipende dal modello che vuoi eseguire, da come intendi farlo e dal fatto che ti interessi di più l'adattamento del modello in sé o ottenere risultati rapidi e reattivi. La capacità di memoria ti permette di accedere al sistema. La velocità della memoria determina la qualità dell'esperienza una volta che ci sei dentro.

Perché la memoria è il collo di bottiglia

Quando si esegue un modello linguistico di grandi dimensioni in locale, l'intero modello deve risiedere in memoria mentre genera il testo. A differenza dei giochi o dell'editing video, dove i dati entrano ed escono dalla memoria in base alle necessità, l'inferenza dei modelli linguistici di grandi dimensioni (LLM) carica l'intero insieme dei pesi del modello e li mantiene residenti in memoria. Ogni singolo token generato dal modello richiede un passaggio attraverso tali pesi.

Questo rende la capacità di memoria il limite massimo. Se non si dispone di RAM o VRAM sufficienti per contenere il modello, o non è possibile eseguirlo affatto, oppure parte del modello finisce per essere trasferita su una memoria più lenta, con un drastico calo delle prestazioni. In alcuni casi si parla di un rallentamento da 5 a 30 volte superiore.

Ma la capacità è solo metà della storia. Una volta che il modello è stato caricato in memoria, la velocità con cui il sistema è in grado di trasmettere quei pesi al processore diventa il fattore limitante principale per la velocità di generazione dei token. Si tratta della larghezza di banda della memoria, ed è per questo che la velocità e la configurazione della RAM sono più importanti per l'IA locale rispetto a quasi tutti gli altri carichi di lavoro su desktop.

RAM o VRAM: quale è più importante?

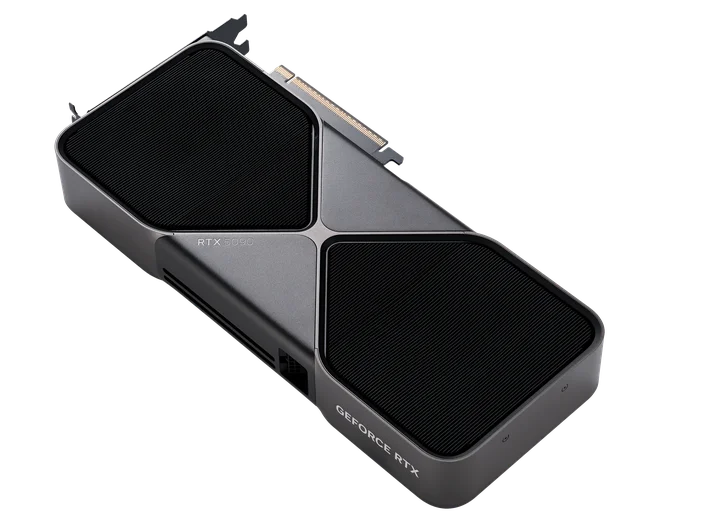

Se disponi di una GPU dedicata con una quantità sufficiente di VRAM, questa è la soluzione più veloce. La memoria della GPU (VRAM) ha una larghezza di banda notevolmente superiore rispetto alla RAM di sistema: una GPU moderna come una RTX 4090 o una RTX 5090 è in grado di fornire oltre 1 TB/s di larghezza di banda di memoria, mentre anche la RAM di sistema DDR5 più veloce raggiunge al massimo circa 90 GB/s in una tipica configurazione desktop a doppio canale.

È proprio a causa di questo divario di larghezza di banda che un modello che rientra interamente nella VRAM può generare 40 o più token al secondo, mentre lo stesso modello eseguito dalla RAM di sistema può arrivare a 8-15 token al secondo su una configurazione con CPU veloce. Entrambe le soluzioni sono utilizzabili, ma la differenza in termini di reattività è evidente.

Il problema è che le GPU di fascia consumer raggiungono un massimo di 24 GB di VRAM (su schede come la RTX 4090 e la RTX 5090), il che limita la possibilità di lavorare con modelli da circa 14 miliardi di parametri a buona qualità, o fino a circa 32 miliardi con una quantizzazione aggressiva. Se si desidera eseguire modelli più grandi, con 70 miliardi di parametri e oltre, probabilmente sarà necessario ricorrere alla RAM di sistema, utilizzare più GPU o accettare un compromesso in termini di prestazioni con un offloading parziale.

Quanta RAM ti serve? Una guida pratica

È qui che le cose si fanno concrete. La quantità di memoria richiesta da un modello dipende dal numero dei suoi parametri e dalla precisione (livello di quantizzazione) con cui viene eseguito. Una regola empirica approssimativa: con una quantizzazione Q4 (4 bit), occorre prevedere circa 0,5-0,6 GB per ogni miliardo di parametri, più il sovraccarico per il contesto e il sistema operativo.

8 GB: punto di partenza

Con 8 GB di memoria di sistema totale (o VRAM), è possibile eseguire senza problemi modelli di piccole dimensioni con un numero di parametri compreso tra 1B e 7B utilizzando una quantizzazione a 4 bit. Tra questi figurano modelli come Llama 3.2 3B, Phi-4 Mini, Qwen 3 4B e Mistral 7B (a Q4). Questi modelli sono sorprendentemente efficaci per attività quali la sintesi, la generazione di codice semplice e le domande e risposte conversazionali.

Con una GPU di buona qualità, ci si può aspettare circa 40-50 token al secondo, oppure 15-20 token al secondo con la CPU. È perfettamente utilizzabile per interazioni in stile chat.

16 GB: la scelta ideale per la maggior parte delle persone

16 GB consentono di utilizzare modelli da 7B e 8B con una quantizzazione più elevata (Q8 per una qualità migliore) e modelli da 13B a 14B con Q4. È qui che modelli come Llama 3.1 8B, Qwen 3 8B e DeepSeek-R1-Distill 14B diventano praticabili. Si ottiene anche spazio sufficiente per eseguire il sistema operativo e altre app insieme al modello senza che tutto si blocchi.

Per la maggior parte di chi si avvicina all'IA locale, 16 GB di DDR5 rappresentano un punto di partenza realistico. Si otterranno buoni risultati con i modelli open source più diffusi e non si avrà la sensazione di essere costantemente limitati dalla memoria.

32 GB: IA locale avanzata

Con 32 GB, si è in grado di eseguire comodamente modelli con 32 miliardi di parametri e modelli da 70 miliardi con quantizzazione pesante (Q2 o Q3). Modelli come Qwen 3 32B, DeepSeek-R1-Distill 32B e Gemma 3 27B si adattano bene a questo scenario. Questi modelli offrono un ragionamento notevolmente migliore, output coerenti più lunghi e prestazioni più elevate su compiti complessi rispetto alle loro controparti più piccole.

Se utilizzi modelli di linguaggio di grandi dimensioni (LLM) locali per attività di sviluppo, assistenza alla scrittura o qualsiasi altra attività in cui la qualità dei risultati sia fondamentale, è a partire da 32 GB che l'esperienza inizia a risultare davvero soddisfacente. Un kit come il CORSAIR VENGEANCE DDR5 da 64 GB (2x32 GB) a 6000 MT/s ti offre la capacità e la larghezza di banda necessarie per gestire questi carichi di lavoro senza compromessi.

64 GB e oltre: l'esecuzione dei modelli di grandi dimensioni

Se si desidera eseguire modelli da 70 miliardi di parametri con livelli di quantizzazione ragionevoli (Q4 o Q5), sono necessari 64 GB di RAM di sistema e, idealmente, una configurazione multi-GPU o un sistema che supporti l'offloading parziale su GPU. Llama 3.3 70B a Q4 richiede circa 42 GB solo per i pesi del modello, senza contare la finestra di contesto e l'overhead del sistema operativo.

A questo livello, la larghezza di banda della memoria diventa ancora più cruciale. Ogni generazione di token richiede l'elaborazione in streaming di decine di gigabyte di pesi, e una RAM più veloce si traduce direttamente in un output più rapido. Si tratta di una configurazione di livello workstation, ma è sempre più comune tra i professionisti che desiderano conservare i dati sensibili sul dispositivo mentre lavorano con modelli aperti di fascia avanzata.

Perché conta la velocità della RAM, non solo la capacità

Ecco un fatto che sorprende molti: per l'inferenza LLM locale, la larghezza di banda della memoria è spesso più importante della potenza di calcolo pura. Una volta generato il primo token (operazione che richiede molta potenza di calcolo), ogni token successivo dipende dalla memoria. Per ogni token, il modello deve trasmettere in streaming l'intero set di pesi attraverso il processore, e la velocità di tale trasmissione è determinata dalla larghezza di banda della memoria.

I benchmark reali evidenziano chiaramente la differenza. È stato dimostrato che il passaggio dalla DDR5-4800 alla DDR5-6000 migliora la velocità di generazione dei token del 20-23% per modelli come Mistral 7B e Llama 3.1 8B in esecuzione su CPU. Si tratta di un miglioramento significativo e tangibile della reattività, dovuto esclusivamente a una memoria più veloce.

Anche le configurazioni a doppio canale sono estremamente importanti. Utilizzare due moduli di RAM in modalità a doppio canale raddoppia di fatto la larghezza di banda disponibile rispetto a un singolo modulo. In pratica, ciò può tradursi in un aumento della velocità di inferenza dal 30 al 50%. Se state assemblando o aggiornando un sistema per l'IA locale, utilizzate sempre due moduli in modalità a doppio canale, mai un singolo DIMM.

Quantizzazione: come far stare modelli più grandi in meno memoria

La quantizzazione è la tecnica che rende i modelli LLM locali utilizzabili su hardware di consumo. Consiste nel comprimere i pesi del modello dalla loro forma originale a 16 bit in virgola mobile (FP16) in rappresentazioni più compatte, solitamente a 4 bit (Q4), 5 bit (Q5) o 8 bit (Q8). Il compromesso consiste in una lieve riduzione della qualità dell'output a fronte di una drastica riduzione dei requisiti di memoria.

Con la quantizzazione Q4_K_M (il formato più diffuso per l'uso locale), un modello da 8 miliardi di parametri passa da circa 16 GB a circa 5-6 GB. Un modello da 70 miliardi di parametri passa invece da 140 GB a circa 40-42 GB. Si tratta di una riduzione del 75% dello spazio di memoria e, nella maggior parte dei casi pratici, la differenza di qualità è quasi impercettibile.

Q5_K_M offre una qualità leggermente superiore a un costo di memoria superiore di circa il 15-20%, e vale la pena prenderlo in considerazione se si dispone di risorse sufficienti. Q8 mantiene quasi tutta la qualità del modello originale, ma riduce solo della metà i requisiti di memoria: è la scelta ideale quando si dispone di memoria in abbondanza e si desidera ottenere il miglior risultato possibile.

Strumenti come Ollama e LM Studio gestiscono i modelli quantizzati in modo nativo, quindi non è necessario effettuare alcuna conversione manualmente. Basta scegliere il livello di quantizzazione più adatto alla memoria disponibile.

Lunghezza del contesto: il costo nascosto della memoria

Ogni unità di contesto (il testo inviato al modello più quello da esso generato) richiede memoria aggiuntiva oltre a quella necessaria per i pesi del modello stesso. Le conversazioni brevi non presentano problemi, ma se si inseriscono documenti lunghi o si conservano cronologie di chat estese, la memoria di contesto può aumentare rapidamente.

A titolo indicativo, 8.000 token di contesto aggiungono circa 1 GB ogni 10 miliardi di parametri. Se si passa a 32.000 token, si arriva a 4 GB in più. Alcuni modelli più recenti supportano 128.000 token o più, il che può effettivamente raddoppiare il fabbisogno totale di memoria.

Se prevedi di utilizzare regolarmente contesti di grandi dimensioni, ad esempio inserendo interi codici sorgente o documenti voluminosi in un modello, assicurati di disporre di memoria aggiuntiva oltre a quella richiesta dai soli pesi del modello. Questo è un altro motivo per cui le configurazioni da 32 GB o 64 GB sono indicate per un utilizzo professionale dell'IA in locale.

Modelli popolari e cosa serve loro

Ecco una guida rapida ad alcuni dei modelli locali più utilizzati al momento, con l'indicazione della memoria approssimativa richiesta con quantizzazione Q4_K_M:

- Phi-4 Mini (3,8 GHz): circa 2,3 GB, funziona alla grande praticamente su qualsiasi sistema

- Qwen 3.5 4B: ~3,4 GB, eccellente per attività leggere con un'elevata capacità di ragionamento

- Llama 3.2 8B: ~5 GB, modello compatto affidabile per uso generico

- Qwen 3 8B: circa 5 GB, ottime prestazioni nel campo del multilinguismo e del ragionamento

- Qwen 3.5 9B: ~6,6 GB, l'ultimo modello compatto con funzionalità migliorate

- DeepSeek-R1-Distill 14B: ~9 GB, eccellenti capacità di ragionamento in un formato compatto

- Gemma 3 12B: circa 8 GB, l'efficiente modello di fascia media di Google

- Llama 4 Scout (109 miliardi di MoE, 17 miliardi attivi): circa 10 GB con quantizzazione aggressiva; l'ultima versione di Meta funziona sorprendentemente bene grazie all'architettura MoE

- Qwen 3.5 27B: ~17 GB, una scheda versatile e potente che supporta 24 GB di VRAM

- Qwen 3 32B: circa 20 GB, prestazioni elevate, compatibile con 24 GB di VRAM

- Qwen 3.5 35B-A3B (MoE): ~24 GB, 35 miliardi in totale ma solo 3 miliardi attivi per token, molto efficiente

- Llama 3.3 70B: ~42 GB, qualità quasi all’avanguardia, richiede una notevole quantità di RAM

- DeepSeek-R1-Distill 70B: ~42 GB, capacità di ragionamento di alto livello per uso locale

- GPT-OSS 120B: ~63 GB; il modello a peso aperto di OpenAI richiede almeno 64 GB di RAM unificata o di sistema

- Qwen 3.5 122B-A10B (MoE): ~81 GB, modello di punta con soli 10 miliardi di parametri attivi

Questi valori si riferiscono esclusivamente ai pesi dei modelli con quantizzazione Q4_K_M. Aggiungere da 2 a 8 GB per il contesto, l'overhead del sistema operativo e qualsiasi altra applicazione in esecuzione in parallelo. I modelli MoE (Mixture of Experts) come Llama 4 Scout e Qwen 3.5 35B-A3B sono particolarmente efficienti in termini di memoria durante l'inferenza, poiché per ogni token è attiva solo una frazione dei loro parametri totali.

Scegliere la memoria giusta per l'IA locale

Alla luce di quanto detto sopra, ecco come impostare la memoria per i modelli di linguaggio locali (LLM):

Scegli la DDR5 se la tua piattaforma la supporta. Il vantaggio in termini di larghezza di banda rispetto alla DDR4 è reale e influisce direttamente sulla velocità di inferenza. La DDR5-6000 o superiore rappresenta il compromesso ideale tra prezzo, compatibilità e prestazioni per i carichi di lavoro di IA.

Utilizza sempre la modalità dual-channel. Due moduli di RAM offrono prestazioni nettamente superiori rispetto a un singolo modulo della stessa capacità totale per l'inferenza LLM. Un kit da 2x16 GB supera di gran lunga un singolo modulo da 32 GB in termini di token al secondo.

Scegli la capacità in base ai modelli che intendi utilizzare. Se stai sperimentando principalmente con modelli da 7 a 8 miliardi di parametri, 16 GB sono sufficienti. Se desideri utilizzare modelli da 14 a 32 miliardi di parametri o lasciarti un margine per modelli futuri, 32 GB sono l'opzione migliore. E se hai in mente modelli da 70 miliardi di parametri, prevedi 64 GB.

Per un sistema in grado di gestire bene gli attuali modelli di IA locali e che lasci spazio alla crescita, un kit come il CORSAIR VENGEANCE DDR5 da 64 GB (2x32 GB) a 6000 MT/s o 6400 MT/s è difficile da battere. Si ottiene la capacità necessaria per modelli di grandi dimensioni, la larghezza di banda per un'inferenza veloce e la configurazione a doppio canale che garantisce un funzionamento efficiente. Se si sta realizzando una configurazione più compatta incentrata su modelli più piccoli, un kit DDR5-6000 da 32 GB (2x16 GB) rappresenta un punto di partenza solido ed economico.

Progettata appositamente per l'IA locale: la CORSAIR AI WORKSTATION 300

Se hai davvero intenzione di eseguire modelli di grandi dimensioni in locale e non vuoi assemblare un PC tower multi-GPU, la CORSAIR AI WORKSTATION 300 offre un approccio diverso. È costruita attorno al processore AMD Ryzen AI MAX+ 395 con una GPU integrata Radeon 8060S in grado di accedere fino a 96 GB di VRAM dai 128 GB di memoria LPDDR5X-8000 del sistema. È proprio questa capacità a renderlo interessante per l'IA locale: oggi una singola GPU consumer discreta raggiunge al massimo i 32 GB di VRAM, quindi caricare qualcosa come GPT-OSS 120B (circa 63 GB a MXFP4) su una sola scheda non è possibile senza suddividere il modello su più GPU o scaricarlo nella RAM di sistema.

L'architettura di memoria unificata rappresenta il compromesso fondamentale. Si rinuncia alla larghezza di banda pura della VRAM GDDR7 dedicata, ma in cambio si ottengono fino a 96 GB di memoria accessibile alla GPU a velocità LPDDR5X. Ciò significa che i modelli con un intervallo di parametri compreso tra 70B e 120B, che altrimenti richiederebbero più GPU discrete o un pesante offloading della CPU, possono essere eseguiti interamente sul percorso di memoria della GPU su una singola macchina, senza dover suddividere i livelli tra le schede o gestire i pesi tramite PCIe.

Il sistema include inoltre l'NPU XDNA 2 di AMD con 50 TOPS di accelerazione AI per le attività meno impegnative, Ethernet a 2,5 Gbps, Wi-Fi 6E e diverse porte USB 4.0. Per i professionisti che lavorano con dati sensibili – in ambito legale, medico o finanziario – disporre di questo livello di capacità AI completamente offline e in locale rappresenta un notevole vantaggio pratico.

La suite di software CORSAIR AI

L'installazione e la configurazione corrette degli strumenti di IA locali possono rappresentare una delle parti più frustranti dell'esperienza: conflitti di dipendenze, versioni dei driver, compatibilità dei framework. Il CORSAIR AI Software Stack è uno strumento di configurazione guidata progettato per eliminare queste difficoltà. Ti aiuta a scegliere e installare gli strumenti più adatti al tuo sistema, dai framework di IA e machine learning agli ambienti di sviluppo e ai software creativi, tutti su misura per il tuo hardware.

JOIN OUR OFFICIAL CORSAIR COMMUNITIES

Join our official CORSAIR Communities! Whether you're new or old to PC Building, have questions about our products, or want to chat about the latest PC, tech, and gaming trends, our community is the place for you.