BLOG

Yerel Büyük Dil Modelleri için Bellek: Ne Kadar RAM Gerekiyor? (ve Hızın Önemli Olduğu Durumlar)

Son güncelleme:

Kendi donanımınızda büyük bir dil modelini çalıştırmak, şu anda yapay zeka alanında yapabileceğiniz en pratik şeylerden biridir. İster kodlama asistanlarıyla denemeler yapıyor, ister özel bir sohbet robotu geliştiriyor olun, ya da sadece açık kaynaklı modellerin neler yapabileceğini merak ediyor olun, akla hemen gelen bir soru vardır: Aslında ne kadar belleğe ihtiyacım var?

Cevap, çalıştırmak istediğiniz modele, onu nasıl çalıştırmayı planladığınıza ve modelin uyumunu mu yoksa hızlı ve anında sonuç almayı mı daha çok önemsediğinize bağlıdır. Bellek kapasitesi, kapıdan içeri girmenizi sağlar. Bellek hızı ise içeri girdikten sonra deneyiminizin ne kadar iyi olacağını belirler.

Neden Bellek Darboğaz Oluşuyor?

Büyük bir dil modelini yerel olarak çalıştırdığınızda, metin üretimi sırasında modelin tamamı bellekte bulunmalıdır. Verilerin gerektiğinde belleğe girip çıktığı oyun veya video düzenleme işlemlerinden farklı olarak, LLM çıkarımında model ağırlıklarının tamamı yüklenir ve bellekte tutulur. Modelin ürettiği her bir token, bu ağırlıkların içinden geçmek zorundadır.

Bu durumda bellek kapasitesi en büyük engel haline geliyor. Modeli barındıracak kadar RAM veya VRAM’ınız yoksa, ya modeli hiç çalıştıramazsınız ya da modelin bir kısmı daha yavaş olan depolama alanına sızar ve bu da performansı önemli ölçüde düşürür. Bazı durumlarda 5 ila 30 kat daha yavaş bir performans söz konusu olabilir.

Ancak kapasite, hikayenin sadece yarısıdır. Model belleğe sığdıktan sonra, sisteminizin bu ağırlıkları işlemciye aktarma hızı, tokenların ne kadar hızlı üretileceğinin başlıca belirleyicisi haline gelir. Buna bellek bant genişliği denir ve işte bu nedenle RAM hızı ve yapılandırması, yerel yapay zeka için diğer neredeyse tüm masaüstü iş yüklerinden daha fazla önem taşır.

RAM mi VRAM mi: Hangisi Daha Önemli?

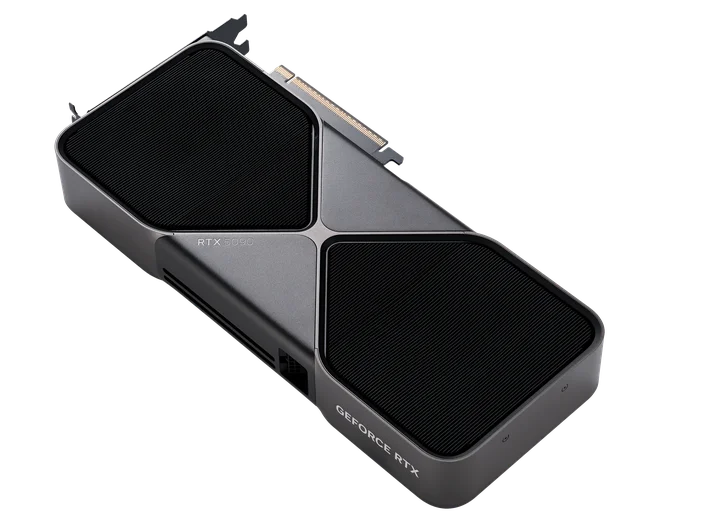

Yeterli VRAM'e sahip özel bir GPU'nuz varsa, bu en hızlı yoldur. GPU belleği (VRAM), sistem RAM'inden çok daha yüksek bant genişliğine sahiptir; RTX 4090 veya RTX 5090 gibi modern bir GPU, 1 TB/s'nin üzerinde bellek bant genişliği sunabilirken, en hızlı DDR5 sistem RAM'i bile tipik bir çift kanallı masaüstü yapılandırmasında 90 GB/s civarında bir sınırla karşılaşır.

Bu bant genişliği farkı, VRAM’a tamamen sığan bir modelin saniyede 40 veya daha fazla token üretebilmesinin, oysa aynı modelin sistem RAM’inden çalıştırıldığında hızlı bir CPU kurulumunda saniyede 8 ila 15 token üretebilmesinin nedenidir. Her ikisi de kullanılabilir, ancak tepki hızındaki fark göze çarpmaktadır.

Ancak sorun şu ki, tüketiciye yönelik GPU’lar (RTX 4090 ve RTX 5090 gibi kartlarda) en fazla 24 GB VRAM’e sahip; bu da sizi iyi kalitede yaklaşık 14 milyar parametreli modellerle veya agresif niceleme uygulandığında en fazla 32 milyar parametreli modellerle sınırlıyor. 70 milyar parametre ve üzeri daha büyük modelleri çalıştırmak istiyorsanız, muhtemelen sistem RAM'ine güvenmeniz, birden fazla GPU kullanmanız veya kısmi yük devretme ile bazı performans ödünleri vermeniz gerekecektir.

Ne Kadar RAM'e İhtiyacınız Var? Pratik Bir Analiz

İşte burada işler somutlaşıyor. Bir modelin ihtiyaç duyduğu bellek miktarı, modelin parametre sayısına ve modelin çalıştırıldığı hassasiyet düzeyine (kuantizasyon seviyesine) bağlıdır. Genel bir kural olarak şunu söyleyebiliriz: Q4 kuantizasyonunda (4 bit), milyarda bir parametre başına yaklaşık 0,5 ila 0,6 GB bellek gerekliliği öngörülür; buna ek olarak bağlam ve işletim sistemi için ek bellek ihtiyacı da vardır.

8 GB: Giriş Seviyesi

Toplam 8 GB sistem belleği (veya VRAM) ile, 4 bitlik niceleme kullanarak 1 milyar ila 7 milyar parametre aralığındaki küçük modelleri rahatlıkla çalıştırabilirsiniz. Buna Llama 3.2 3B, Phi-4 Mini, Qwen 3 4B ve Mistral 7B (Q4'te) gibi modeller dahildir. Bu modeller, özetleme, basit kod üretimi ve diyalog bazlı soru-cevap gibi görevler için şaşırtıcı derecede yeteneklidir.

İyi bir GPU'da saniyede yaklaşık 40 ila 50 token, CPU'da ise saniyede 15 ila 20 token bekleyebilirsiniz. Sohbet tarzı etkileşimler için gayet kullanışlıdır.

16 GB: Çoğu Kişi İçin İdeal Seçim

16 GB, daha yüksek niceleme düzeyinde (daha iyi kalite için Q8) 7B ve 8B modellerine, Q4 düzeyinde ise 13B ile 14B modellerine kapı açar. İşte bu noktada Llama 3.1 8B, Qwen 3 8B ve DeepSeek-R1-Distill 14B gibi modeller pratik hale gelir. Ayrıca, her şeyin durma noktasına gelmeden işletim sistemini ve diğer uygulamaları modelin yanında çalıştırmak için yeterli alan elde edersiniz.

Yerel yapay zeka ile denemeler yapan çoğu kişi için 16 GB DDR5, gerçekçi bir başlangıç noktasıdır. En popüler açık kaynaklı modellerle iyi sonuçlar elde edersiniz ve sürekli bellek sıkıntısı çekmezsiniz.

32 GB: Gelişmiş Yerel Yapay Zeka

32 GB ile, 32 milyar parametreli modelleri rahatlıkla çalıştırabileceğiniz ve 70 milyar parametreli modelleri yoğun kuantizasyon (Q2 veya Q3) uygulayarak çalıştırabileceğiniz bir aralığa girmiş olursunuz. Qwen 3 32B, DeepSeek-R1-Distill 32B ve Gemma 3 27B gibi modeller buraya çok uygundur. Bu modeller, daha küçük muadillerine kıyasla belirgin şekilde daha iyi akıl yürütme, daha uzun tutarlı çıktılar ve karmaşık görevlerde daha güçlü performans sunar.

Geliştirme çalışmaları, yazma desteği veya çıktı kalitesinin önemli olduğu herhangi bir iş için yerel LLM'ler kullanıyorsanız, 32 GB'lık bellek ile deneyim gerçekten tatmin edici bir hale gelmeye başlar. 6000 MT/s hızında bir CORSAIR VENGEANCE DDR5 64 GB (2x32 GB) kiti gibi bir ürün, bu iş yüklerini ödün vermeden yönetebilmeniz için gereken kapasiteyi ve bant genişliğini sağlar.

64 GB ve Ötesi: Büyük Modellerin Çalıştırılması

70 milyar parametreli modelleri makul niceleme seviyelerinde (Q4 veya Q5) çalıştırmak istiyorsanız, 64 GB sistem RAM’ine ve ideal olarak çoklu GPU kurulumuna ya da kısmi GPU yük devretmeyi destekleyen bir sisteme ihtiyacınız olacaktır. Llama 3.3 70B’nin Q4 seviyesinde çalıştırılması, bağlam penceresi ve işletim sistemi ek yükü hesaba katılmadan önce, yalnızca model ağırlıkları için yaklaşık 42 GB bellek gerektirir.

Bu seviyede bellek bant genişliği daha da kritik hale gelir. Her bir token üretimi, on gigabaytlarca ağırlık verisinin işlenmesini gerektirir ve daha hızlı RAM, doğrudan daha hızlı çıktı anlamına gelir. Bu, iş istasyonu sınıfında bir kurulumdur; ancak öncü sınıf açık modellerle çalışırken hassas verileri cihazda tutmak isteyen profesyoneller arasında giderek daha yaygın hale gelmektedir.

Neden RAM'in Kapasitesi Değil de Hızı Önemlidir?

İşte pek çok kişiyi şaşırtan bir gerçek: Yerel LLM çıkarımında bellek bant genişliği, çoğu zaman ham hesaplama gücünden daha önemlidir. İlk token üretildikten sonra (ki bu aşama hesaplama sınırlıdır), sonraki her token bellek sınırlıdır. Model, her token için tüm ağırlık kümesini işlemci üzerinden aktarmak zorundadır ve bu aktarımın hızı, bellek bant genişliğiniz tarafından belirlenir.

Gerçek dünya performans testleri bu farkı net bir şekilde ortaya koyuyor. DDR5-4800'den DDR5-6000'e geçişin, CPU üzerinde çalışan Mistral 7B ve Llama 3.1 8B gibi modellerde token üretme hızını yüzde 20 ila 23 oranında artırdığı görülmüştür. Bu, tepki süresinde önemli ve fark edilebilir bir iyileşmedir ve tamamen daha hızlı bellek sayesinde gerçekleşmektedir.

Çift kanal yapılandırmaları da son derece önemlidir. İki RAM modülünü çift kanal modunda çalıştırmak, tek bir modüle kıyasla kullanılabilir bant genişliğini fiilen iki katına çıkarır. Pratikte bu, %30 ila %50 daha hızlı çıkarım anlamına gelebilir. Yerel yapay zeka için bir sistem kuruyor veya yükseltme yapıyorsanız, her zaman çift kanal modunda iki modül kullanın, asla tek bir DIMM kullanmayın.

Kuantizasyon: Daha Büyük Modelleri Daha Az Belleğe Sığdırma

Kuantizasyon, yerel büyük dil modellerini (LLM) tüketici donanımlarında kullanılabilir hale getiren bir tekniktir. Bu teknik, model ağırlıklarını orijinal 16 bitlik kayan noktalı (FP16) biçiminden daha küçük temsil biçimlerine, genellikle 4 bitlik (Q4), 5 bitlik (Q5) veya 8 bitlik (Q8) biçimlere sıkıştırır. Bunun karşılığında, bellek gereksinimlerindeki büyük ölçüde azalma karşılığında çıktı kalitesinde küçük bir düşüş yaşanır.

Q4_K_M niceleme formatında (yerel kullanım için en yaygın format), 8 milyar parametreli bir modelin boyutu yaklaşık 16 GB'den 5 ila 6 GB'ye düşer. 70 milyar parametreli bir model ise 140 GB'den yaklaşık 40 ila 42 GB'ye iner. Bu, bellek kullanımında yüzde 75'lik bir azalma anlamına gelir ve çoğu pratik kullanım senaryosunda kalite farkı neredeyse fark edilmez.

Q5_K_M, bellek maliyetini yaklaşık yüzde 15 ila 20 oranında artırarak biraz daha iyi bir kalite sunar; sisteminizde yeterli bellek kapasitesi varsa bu seçeneği değerlendirmeye değer. Q8, orijinal modelin kalitesinin neredeyse tamamını korur ancak bellek gereksinimini yalnızca yarı yarıya azaltır; bol miktarda belleğiniz varsa ve mümkün olan en iyi çıktıyı elde etmek istiyorsanız bu, tercih etmeniz gereken seçenektir.

Ollama ve LM Studio gibi araçlar, nicelendirilmiş modelleri doğrudan destekler; bu sayede herhangi bir dönüştürme işlemi yapmanıza gerek kalmaz. Elinizdeki bellek kapasitesine uygun nicelendirme seviyesini seçmeniz yeterlidir.

Bağlam Uzunluğu: Gizli Bellek Maliyetleri

Her bağlam birimi (modele gönderdiğiniz metin ile modelin ürettiği metin), model ağırlıklarının yanı sıra ek bellek gerektirir. Kısa sohbetler sorun yaratmaz, ancak uzun belgeler giriyorsanız veya kapsamlı sohbet geçmişlerini saklıyorsanız, bağlam belleği hızla dolabilir.

Kabaca bir tahminle, 10 milyar parametre başına 8.000 tokenlik bir bağlam, yaklaşık 1 GB ekler. Bu rakamı 32.000 tokene çıkardığınızda, 4 GB’lık bir artışla karşı karşıya kalırsınız. Bazı yeni modeller 128.000 token veya daha fazlasını desteklemektedir; bu da toplam bellek gereksiniminizi fiilen ikiye katlayabilir.

Uzun metinleri düzenli olarak kullanmayı planlıyorsanız (örneğin, bir modele tüm kod tabanlarını veya uzun belgeleri beslemek gibi), model ağırlıklarının gerektirdiğinden daha fazla bellek ayırın. Bu, ciddi yerel yapay zeka kullanımları için 32 GB veya 64 GB yapılandırmalarının mantıklı olmasının bir başka nedenidir.

Popüler Modeller ve İhtiyaçları

İşte şu anda en çok kullanılan yerel modellerden bazıları için, Q4_K_M niceleme düzeyinde gereken yaklaşık bellek miktarını gösteren bir hızlı başvuru tablosu:

- Phi-4 Mini (3.8B): ~2,3 GB, hemen hemen her sistemde mükemmel çalışıyor

- Qwen 3.5 4B: ~3,4 GB, güçlü mantık yeteneği ile hafif görevler için mükemmel

- Llama 3.2 8B: ~5 GB, güvenilir, genel amaçlı küçük model

- Qwen 3 8B: ~5 GB, güçlü çok dilli ve akıl yürütme performansı

- Qwen 3.5 9B: ~6,6 GB, geliştirilmiş özelliklere sahip en yeni küçük model

- DeepSeek-R1-Distill 14B: ~9 GB, kompakt boyutta mükemmel akıl yürütme

- Gemma 3 12B: ~8 GB, Google'ın verimli orta boy seçeneği

- Llama 4 Scout (109 milyar MoE, 17 milyar aktif): Agresif nicelemeyle ~10 GB; Meta'nın en yeni modeli, MoE mimarisi sayesinde şaşırtıcı derecede iyi çalışıyor

- Qwen 3.5 27B: ~17 GB, 24 GB VRAM'e sığan güçlü bir çok yönlü kart

- Qwen 3 32B: ~20 GB, yüksek performans, 24 GB VRAM'e sığar

- Qwen 3.5 35B-A3B (MoE): ~24 GB, toplam 35 milyar ancak her bir token başına yalnızca 3 milyar aktif, çok verimli

- Llama 3.3 70B: ~42 GB, sınırda kalitede, yüksek miktarda RAM gerektirir

- DeepSeek-R1-Distill 70B: ~42 GB, yerel kullanım için birinci sınıf akıl yürütme

- GPT-OSS 120B: ~63 GB; OpenAI’nin açık ağırlıklı modeli, 64 GB veya daha fazla birleşik veya sistem RAM’ine ihtiyaç duyar

- Qwen 3.5 122B-A10B (MoE): ~81 GB, yalnızca 10 milyar aktif parametreye sahip amiral gemisi sınıfı

Bu rakamlar yalnızca Q4_K_M kuantizasyonundaki model ağırlıkları içindir. Bağlam, işletim sistemi yükü ve aynı anda çalıştırdığınız diğer uygulamalar için 2 ila 8 GB ekleyin. Llama 4 Scout ve Qwen 3.5 35B-A3B gibi MoE (Mixture of Experts) modelleri, her bir token için toplam parametrelerinin yalnızca bir kısmı aktif olduğundan, özellikle çıkarım aşamasında bellek açısından verimlidir.

Yerel Yapay Zeka İçin Doğru Belleği Seçmek

Yukarıda belirtilenlere dayanarak, yerel LLM'ler için bellek yapılandırmanızı şu şekilde ele alabilirsiniz:

Platformunuz DDR5'i destekliyorsa, DDR5'i tercih edin. DDR4'e kıyasla bant genişliği avantajı gerçektir ve çıkarım hızını doğrudan etkiler. DDR5-6000 veya daha yüksek hızlar, yapay zeka iş yükleri için fiyat, uyumluluk ve performans açısından ideal dengeyi sunar.

Her zaman çift kanal modunda çalıştırın. LLM çıkarımında, iki adet RAM modülü, aynı toplam kapasiteye sahip tek bir modüle kıyasla önemli ölçüde daha yüksek performans gösterir. 2x16 GB'lık bir kit, saniye başına işlenen token sayısı açısından tek bir 32 GB'lık modülü büyük bir farkla geride bırakır.

Çalıştırmak istediğiniz modellerin boyutuna göre. Ağırlıklı olarak 7B ila 8B arası modellerle denemeler yapıyorsanız, 16 GB yeterli olacaktır. 14B ila 32B arası modelleri çalıştırmak veya gelecekteki modeller için yedek kapasite bırakmak istiyorsanız, 32 GB daha uygun bir hedeftir. 70B'lik modelleri de göz önünde bulunduruyorsanız, 64 GB'lık bir plan yapın.

Mevcut yerel AI modellerini sorunsuzca çalıştıran ve gelecekteki büyümeye de yer bırakan bir sistem için, 6000MT/s veya 6400MT/s hızındaki CORSAIR VENGEANCE DDR5 64GB (2x32GB) gibi bir kitin üstüne çıkmak zor. Büyük modeller için kapasite, hızlı çıkarım için bant genişliği ve tümünün verimli bir şekilde çalışmasını sağlayan çift kanal yapılandırmasına sahip olursunuz. Daha küçük modellere odaklanan daha kompakt bir kurulum oluşturuyorsanız, 32GB (2x16GB) DDR5-6000 kiti sağlam ve uygun maliyetli bir başlangıç noktasıdır.

Yerel Yapay Zeka için Özel Olarak Tasarlanmış: CORSAIR AI WORKSTATION 300

Büyük modelleri yerel olarak çalıştırmayı ciddiye alıyorsanız ve çoklu GPU'lu bir kule sistemi kurmak istemiyorsanız, CORSAIR AI WORKSTATION 300 farklı bir yaklaşım sunuyor. Bu sistem, AMD'nin Ryzen AI MAX+ 395 işlemcisi ve sistemin 128 GB LPDDR5X-8000 belleğinden 96 GB'a kadar VRAM'e erişebilen entegre Radeon 8060S GPU'su üzerine kurulmuştur. Bu kapasite, onu yerel AI için ilgi çekici kılan şeydir: Günümüzde tek bir ayrık tüketici GPU'su en fazla 32 GB VRAM'e sahiptir, bu nedenle GPT-OSS 120B (MXFP4'te yaklaşık 63 GB) gibi bir şeyi tek bir karta yüklemek, modeli birden fazla GPU'ya bölmeden veya sistem RAM'ine aktarmadan mümkün değildir.

Birleşik bellek mimarisi, buradaki temel ödünleşimdir. Özel GDDR7 VRAM'in ham bant genişliğinden vazgeçersiniz, ancak bunun karşılığında LPDDR5X hızlarında GPU tarafından erişilebilir 96 GB'a kadar bellek elde edersiniz. Bu, aksi takdirde birden fazla ayrık GPU veya yoğun CPU yük devretme gerektirecek olan 70B ila 120B parametre aralığındaki modellerin, katmanları kartlar arasında bölmeden veya ağırlıkları PCIe üzerinden sayfalandırmadan tek bir makinede tamamen GPU bellek yolunda çalışabileceği anlamına gelir.

Sistem ayrıca, daha hafif görevler için 50 TOPS yapay zeka hızlandırma kapasitesine sahip AMD'nin XDNA 2 NPU'su, 2,5 Gbps Ethernet, Wi-Fi 6E ve çok sayıda USB 4.0 bağlantı noktasını da içeriyor. Hassas verilerle çalışan hukuk, tıp ve finans alanındaki profesyoneller için, bu düzeyde bir yapay zeka kapasitesine tamamen çevrimdışı ve şirket içinde sahip olmak önemli bir pratik avantajdır.

CORSAIR AI Yazılım Paketi

Yerel AI araçlarını kurmak ve doğru şekilde yapılandırmak, bağımlılık çakışmaları, sürücü sürümleri ve çerçeve uyumluluğu gibi sorunlar nedeniyle bu sürecin en sinir bozucu kısımlarından biri olabilir. CORSAIR AI Yazılım Paketi, bu tür zorlukları ortadan kaldırmak üzere tasarlanmış, adım adım yönlendirmeli bir kurulum aracıdır. AI ve makine öğrenimi çerçevelerinden geliştirme ortamlarına ve yaratıcı yazılımlarına kadar, donanımınıza özel olarak uyarlanmış doğru araçları seçmenize ve kurmanıza yardımcı olur.

JOIN OUR OFFICIAL CORSAIR COMMUNITIES

Join our official CORSAIR Communities! Whether you're new or old to PC Building, have questions about our products, or want to chat about the latest PC, tech, and gaming trends, our community is the place for you.