BLOG

Gemma 4: Google’ın Yeni Açık Modeli ve Neden Tüketici Bilgisayarlarında En İyi Şekilde Çalışıyor

Son güncelleme:

Google, bugüne kadarki en yetenekli açık ağırlıklı model ailesi olan Gemma 4'ü piyasaya sürdü ve bu, günlük kullanım amaçlı donanımlarda yerel olarak yapay zeka çalıştıran herkes için büyük bir gelişme. 31 Mart 2026 tarihinde tamamen serbest bir Apache 2.0 lisansı altında yayınlanan Gemma 4, tüketici GPU'larında ve hatta dizüstü bilgisayarlarda abonelik gerektirmeden en ileri düzeyde zeka sunmak üzere tasarlandı.

Ürün yelpazesi dört farklı boyuta yayılıyor: E2B (2,3 milyar etkin parametre), E4B (4,5 milyar etkin parametre), yalnızca 4 milyar aktif parametreye sahip bir 26 milyar parametreli Mixture-of-Experts varyantı ve 31 milyar parametreli bir yoğun model. Bu sayede, tek bir ürün ailesinde uç cihazlara uygun modellerden sınırlara yakın performans sunan modellere kadar her şeyi bulabilirsiniz ve bunların tümü, bilgisayar meraklılarının halihazırda kurdukları türden bilgisayarlar üzerinde çalışıyor.

Gemma 4'ü Öne Çıkaran Nedir?

Gemma 4 sadece daha büyük değil, her bir parametre açısından daha akıllıdır. İşte öne çıkan bazı özellikler:

- Gelişmiş mantık ve ajanlar: kullanıma hazır çok adımlı planlama, matematik, kodlama ve otonom iş akışları.

- Çok modlu: Metin ve görselleri doğrudan işler; daha küçük boyutlu E2B ve E4B modellerinde ses desteği de mevcuttur. Belge ayrıştırma, grafik tanıma ve el yazısı OCR işlemleri tek bir komutla gerçekleştirilebilir.

- Geniş kapsam: E2B/E4B için 128K token ve 26B MoE ile 31B yoğun modeller için tam 256K token; bu, tüm bir kod tabanını veya bir yığın belgeyi eklemek için yeterince geniş bir alan.

- Çok dilli: 140'tan fazla dil üzerinde eğitilmiştir ve bunlardan düzinelercesi için kullanıma hazır güçlü destek sunar.

Hugging Face'te önceden eğitilmiş ve talimatlara göre ayarlanmış sürümleriyle sunulur ve halihazırda kullandığınız araçlarla (Ollama, LM Studio, llama.cpp, vLLM ve Transformers) ilk günden itibaren çalışır.

Tüketici bilgisayarları neden Gemma 4 için ideal bir hedef kitle?

Gemma 4, yerel çıkarımları birinci öncelikli bir hedef olarak göz önünde bulundurularak tasarlandı ve rakamlar da bunu doğruluyor. NVIDIA ve Google, RTX kartları için “day-zero” optimizasyonları konusunda işbirliği yaptı; ayrıca llama.cpp üzerinde yapılan son çalışmalar, uzun bağlamlı senaryolarda KV önbellek kullanımını yaklaşık %40 oranında azalttı.

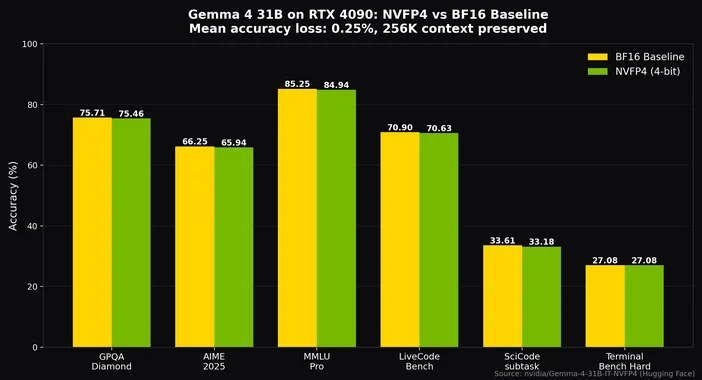

Çoğu yapılandırma için ideal olan Q4_K_M niceleme ile, 26 milyar MoE'yi RTX 4090 veya 3090 gibi 24 GB'lık bir karta sığdırabilir, 8K tokenlik bir bağlam için yer ayırabilir ve yine de saniyede 20 tokenin çok üzerinde bir performans elde edebilirsiniz. NVIDIA'nın NVFP4 niceleme özelliği ile, 31B yoğun model bile tek bir RTX 4090'a sığar ve tam 256K bağlamı korurken sadece ~%0,25 doğruluk kaybı yaşar.

Hızlı Kurulum Kılavuzu

E2B / E4B (kenar ve düşük gecikme): 8 veya 12 GB VRAM'e sahip bir RTX 3060 veya 4060 ile modern bir Ryzen 5 veya Core i5 işlemci yeterli olacaktır. Uzun süreli oturumlar yapmayı planlıyorsanız, bunu 32 GB DDR5 bellek ve sessiz bir AIO soğutma sistemi ile birleştirin.

26B MoE / 31B yoğun (akıl yürütme ve çok modlu): RTX 4090 (veya zaten bir tane varsa 3090), Ryzen 7 / Core i7 veya üstü bir işlemci, 64 GB DDR5 bellek, model yükleme için hızlı bir Gen4 NVMe ve hava akışının iyi olduğu bir kasada 850 W ve üzeri bir güç kaynağı hedefleyin. CORSAIR iCUE LINK TITAN RX RGB 360 mm AIO gibi bir ürün, sürekli çıkarım yükleri altında GPU ve CPU'nun sorunsuz çalışmasını sağlar.

RTX 50 Serisi, Gemma 4'e daha geniş kapsamlı uygulamalar ve daha hızlı çıkarımlar için daha da fazla performans marjı sunuyor.

Bilgisayarınızda Hızlı Başlangıç

1. Ollama veya LM Studio'yu yükleyin.

2. Hugging Face'ten bir Gemma 4 modeli indirin (yeniyseniz gemma4:e4b ile başlayın, VRAM'iniz varsa gemma4:31b'yi kullanın).

3. Çıkarım işlemini çalıştırın; RTX 40 serisi kartlarda daha küçük model varyantlar için saniyede 50, 100+ token elde etmeyi bekleyin.

4. Çok modlu özelliği deneyin: Bir resim ve bir komut girin ve uygulamanın bir ekran görüntüsünü, grafiği veya fotoğrafı analiz etmesine izin verin.

Gemma 4 Cihaz Üzerinde: Artık Mobil Cihazlarda da Kullanılabilir

Gemma 4'ün uç cihaz odaklı yaklaşımı akıllı telefonlara da uzanıyor. Daha küçük boyutlu E2B ve E4B modelleri, Arm CPU'lar ve mobil GPU'lar üzerinde çalışıyor; bu sayede konuşma tanıma, görüntü analizi ve cihaz içi asistanlar için neredeyse sıfır gecikme süresi sunuyor ve bulut bağlantısına gerek kalmıyor. Google'ın AI Edge yığını ve Android AICore, bu teknolojinin Android'de sistem genelinde kullanılabilir olmasını sağlarken, iOS geliştiricileri ise Metal aracılığıyla CPU ve GPU'yu hedefleyebiliyor.

Gemma 4, üst düzey tüketici bilgisayarlarının sadece oyun makineleri değil, gerçek birer yapay zeka iş istasyonu olduğunun bugüne kadarki en net kanıtıdır. Açık ağırlıklandırma, esnek bir lisans, en ileri düzeyde akıl yürütme ve tek bir GPU’ya sığabilen 256K’lık bir bağlam penceresi. Zaten modern bir CORSAIR sistemine sahipseniz, tam donanımlı bir yerel yapay zeka iş istasyonuna sahip olmanın yolunun büyük bir kısmını katetmiş sayılırsınız. Bir sistem kuruyorsanız, 24 GB'lık bir kart, 64 GB DDR5 ve sürekli yük altında bile sorun çıkarmayacak bir soğutma döngüsü planlayın.

Gemma'yı yerel olarak çalıştırmak mı istiyorsunuz? CORSAIR AI Workstation 300 ile tanışın

Gemma 4’ü (ve diğer açık kaynaklı modelleri) tamamen kendi donanımınızda çalıştırmanın tavizsiz bir yolunu arıyorsanız, CORSAIR AI Workstation 300 tam da bu amaç için tasarlanmıştır. AMD Ryzen AI Max+ 395 ile Radeon 8060S iGPU'yu ve 128 GB LPDDR5X-8000 bellekten 96 GB'a kadar birleşik VRAM'i bir araya getirerek, diske sayfalama yapmadan büyük Gemma varyantlarını yerel olarak yüklemek ve ince ayar yapmak için yeterli alan sağlar. Özel bir 50 TOPS NPU, çıkarımları hızlandırır ve tüm sistem, masanıza koyabileceğiniz 4,4 L'lik bir kasaya sığar. Gizlilik, düşük gecikme süresi ve token başına sıfır maliyet isteyen geliştiriciler ve araştırmacılar için bu, Gemma'yı kullanmanın en iyi yollarından biridir.

MAKALEDEKI ÜRÜNLER

JOIN OUR OFFICIAL CORSAIR COMMUNITIES

Join our official CORSAIR Communities! Whether you're new or old to PC Building, have questions about our products, or want to chat about the latest PC, tech, and gaming trends, our community is the place for you.