BLOG

Memoria para los modelos de lenguaje grandes locales: ¿cuánta RAM se necesita? (y cuándo es importante la velocidad)

Última actualización:

Ejecutar un modelo de lenguaje grande en tu propio hardware es una de las cosas más prácticas que puedes hacer con la IA en este momento. Tanto si estás probando asistentes de programación, creando un chatbot privado o simplemente sientes curiosidad por saber de qué son capaces los modelos de código abierto, hay una pregunta que surge de inmediato: ¿cuánta memoria necesito realmente?

La respuesta depende del modelo que quieras ejecutar, de cómo pienses hacerlo y de si te importa más ajustar el modelo o conseguir resultados rápidos y con buena capacidad de respuesta. La capacidad de memoria te permite acceder al sistema. La velocidad de la memoria determina la calidad de la experiencia una vez que estás dentro.

Por qué la memoria es el cuello de botella

Cuando se ejecuta un modelo de lenguaje a gran escala (LLM) de forma local, es necesario que todo el modelo permanezca en la memoria mientras genera texto. A diferencia de los videojuegos o la edición de vídeo, donde los datos entran y salen de la memoria según sea necesario, la inferencia de un LLM carga el conjunto completo de pesos del modelo y los mantiene residentes. Cada uno de los tokens que genera el modelo requiere pasar por esos pesos.

Por eso, la capacidad de memoria es el principal cuello de botella. Si no dispones de suficiente RAM o VRAM para almacenar el modelo, o bien no podrás ejecutarlo en absoluto, o bien parte del modelo acabará almacenándose en un soporte de almacenamiento más lento, lo que reducirá drásticamente el rendimiento. Estamos hablando de una ralentización de entre 5 y 30 veces en algunos casos.

Pero la capacidad es solo una parte del asunto. Una vez que el modelo cabe en la memoria, la velocidad a la que el sistema puede enviar esos pesos al procesador se convierte en el principal factor que limita la rapidez con la que se generan los tokens. Eso es el ancho de banda de la memoria, y es por eso que la velocidad y la configuración de la RAM son más importantes para la IA local que para casi cualquier otra tarea de escritorio.

RAM frente a VRAM: ¿cuál es más importante?

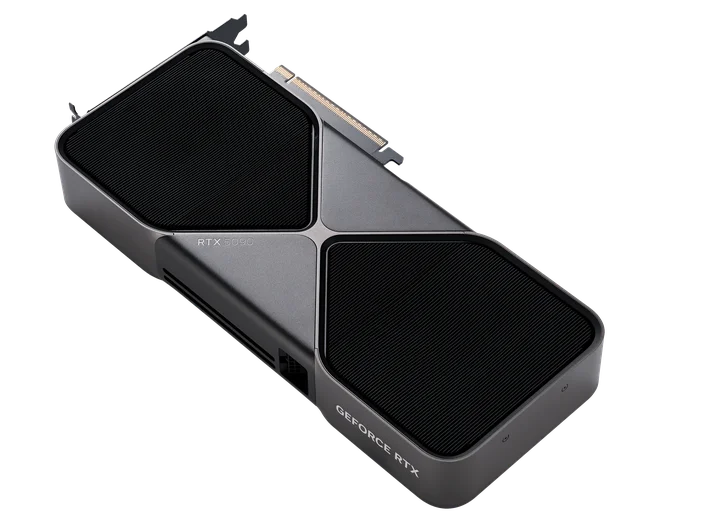

Si dispones de una GPU dedicada con suficiente VRAM, esa es la opción más rápida. La memoria de la GPU (VRAM) tiene un ancho de banda mucho mayor que la RAM del sistema; una GPU moderna, como una RTX 4090 o una RTX 5090, puede ofrecer más de 1 TB/s de ancho de banda de memoria, mientras que incluso la RAM DDR5 más rápida del sistema alcanza un máximo de unos 90 GB/s en una configuración típica de escritorio de doble canal.

Esa diferencia de ancho de banda es la razón por la que un modelo que cabe íntegramente en la VRAM puede generar 40 o más tokens por segundo, mientras que el mismo modelo ejecutado desde la memoria RAM del sistema puede llegar a generar entre 8 y 15 tokens por segundo en una configuración con una CPU rápida. Ambos son viables, pero la diferencia en la capacidad de respuesta es notable.

El problema es que las GPU de consumo tienen un límite máximo de 24 GB de VRAM (en tarjetas como la RTX 4090 y la RTX 5090), lo que te limita a modelos de unos 14 000 millones de parámetros con buena calidad, o hasta unos 32 000 millones con una cuantificación agresiva. Si quieres ejecutar modelos más grandes, de 70 000 millones de parámetros o más, probablemente tendrás que recurrir a la RAM del sistema, utilizar varias GPU o aceptar cierta pérdida de rendimiento con una descarga parcial.

¿Cuánta memoria RAM necesitas? Un análisis práctico

Aquí es donde las cosas se concretan. La cantidad de memoria que requiere un modelo depende del número de parámetros que tenga y de la precisión (nivel de cuantificación) con la que se ejecute. Una regla general aproximada: con una cuantificación Q4 (4 bits), se calcula que se necesitarán entre 0,5 y 0,6 GB por cada mil millones de parámetros, más la sobrecarga correspondiente al contexto y al sistema operativo.

8 GB: Nivel básico

Con 8 GB de memoria total del sistema (o VRAM), puedes ejecutar sin problemas modelos pequeños con un rango de parámetros de entre 1 000 millones y 7 000 millones utilizando una cuantificación de 4 bits. Esto incluye modelos como Llama 3.2 3B, Phi-4 Mini, Qwen 3 4B y Mistral 7B (en Q4). Estos modelos son sorprendentemente eficaces para tareas como la síntesis, la generación de código sencillo y las preguntas y respuestas conversacionales.

Con una GPU decente, se pueden esperar entre 40 y 50 tokens por segundo, o entre 15 y 20 tokens por segundo en la CPU. Es perfectamente válido para interacciones tipo chat.

16 GB: la opción ideal para la mayoría de la gente

Los 16 GB permiten ejecutar modelos de 7 000 y 8 000 millones de parámetros con una cuantificación más alta (Q8 para una mejor calidad) y modelos de 13 000 a 14 000 millones de parámetros con Q4. Es aquí donde modelos como Llama 3.1 8B, Qwen 3 8B y DeepSeek-R1-Distill 14B resultan viables. Además, se dispone de suficiente margen para ejecutar el sistema operativo y otras aplicaciones junto con el modelo sin que todo se ralentice.

Para la mayoría de quienes se inician en la IA local, 16 GB de DDR5 es un punto de partida realista. Obtendrás buenos resultados con los modelos de código abierto más populares y no te sentirás constantemente limitado por la memoria.

32 GB: IA local de alto rendimiento

Con 32 GB, te encuentras en un rango en el que puedes ejecutar cómodamente modelos de 32 000 millones de parámetros y modelos de 70 000 millones de parámetros con cuantificación intensa (Q2 o Q3). Modelos como Qwen 3 32B, DeepSeek-R1-Distill 32B y Gemma 3 27B encajan bien aquí. Estos modelos ofrecen un razonamiento notablemente mejor, salidas coherentes más largas y un rendimiento más sólido en tareas complejas en comparación con sus homólogos más pequeños.

Si utilizas modelos de lenguaje grandes (LLM) locales para tareas de desarrollo, asistencia en la redacción o cualquier otra actividad en la que la calidad del resultado sea importante, es a partir de los 32 GB cuando la experiencia empieza a ser realmente satisfactoria. Un kit como el CORSAIR VENGEANCE DDR5 de 64 GB (2x32 GB) a 6000 MT/s te ofrece la capacidad y el ancho de banda necesarios para gestionar estas cargas de trabajo sin renunciar a nada.

64 GB y más allá: ejecución de modelos de gran tamaño

Si quieres ejecutar modelos de 70 000 millones de parámetros con niveles de cuantificación razonables (Q4 o Q5), necesitarás 64 GB de RAM en el sistema y, a ser posible, una configuración con varias GPU o un sistema que admita la descarga parcial de tareas a la GPU. Llama 3.3 70B en Q4 requiere unos 42 GB solo para los pesos del modelo, sin tener en cuenta la ventana de contexto ni la sobrecarga del sistema operativo.

En este nivel, el ancho de banda de la memoria cobra aún más importancia. Cada generación de tokens requiere procesar decenas de gigabytes de pesos, y una RAM más rápida se traduce directamente en una salida más rápida. Se trata de una configuración de clase estación de trabajo, pero cada vez es más habitual entre los profesionales que desean mantener los datos confidenciales en el propio dispositivo mientras trabajan con modelos abiertos de vanguardia.

Por qué es importante la velocidad de la RAM, y no solo su capacidad

Hay algo que sorprende a mucha gente: en la inferencia local de modelos de lenguaje grande (LLM), el ancho de banda de la memoria suele ser más importante que la potencia de cálculo bruta. Una vez generado el primer token (lo cual depende del poder de cálculo), cada token posterior depende de la memoria. El modelo necesita transmitir todo su conjunto de pesos a través del procesador para cada token, y la velocidad de esa transmisión viene determinada por el ancho de banda de la memoria.

Las pruebas de rendimiento en condiciones reales muestran claramente la diferencia. Se ha demostrado que pasar de DDR5-4800 a DDR5-6000 mejora la velocidad de generación de tokens entre un 20 % y un 23 % en modelos como Mistral 7B y Llama 3.1 8B que se ejecutan en la CPU. Se trata de una mejora significativa y notable en la capacidad de respuesta, y se debe exclusivamente a una memoria más rápida.

Las configuraciones de doble canal también son muy importantes. Utilizar dos módulos de RAM en modo de doble canal duplica efectivamente el ancho de banda disponible en comparación con un solo módulo. En la práctica, esto puede suponer una aceleración de la inferencia de entre un 30 % y un 50 %. Si estás montando o actualizando un sistema para IA local, utiliza siempre dos módulos en modo de doble canal, nunca un solo módulo DIMM.

Cuantificación: cómo ajustar modelos más grandes en menos memoria

La cuantificación es la técnica que permite que los modelos de lenguaje grandes (LLM) locales sean viables en equipos de consumo. Comprime los pesos del modelo, pasando de su formato original de 16 bits en coma flotante (FP16) a representaciones más pequeñas, normalmente de 4 bits (Q4), 5 bits (Q5) u 8 bits (Q8). La contrapartida es una ligera reducción de la calidad de los resultados a cambio de una reducción considerable de los requisitos de memoria.

Con la cuantificación Q4_K_M (el formato más habitual para uso local), un modelo de 8 000 millones de parámetros pasa de ocupar unos 16 GB a entre 5 y 6 GB aproximadamente. Un modelo de 70 000 millones de parámetros pasa de 140 GB a entre 40 y 42 GB aproximadamente. Esto supone una reducción del 75 % en el uso de memoria y, en la mayoría de los casos prácticos, la diferencia de calidad es apenas perceptible.

Q5_K_M ofrece una calidad ligeramente superior a cambio de un coste de memoria entre un 15 % y un 20 % mayor, y merece la pena tenerlo en cuenta si dispones de margen suficiente. Q8 conserva casi toda la calidad del modelo original, pero solo reduce a la mitad los requisitos de memoria; es la opción ideal cuando se dispone de mucha memoria y se busca el mejor resultado posible.

Herramientas como Ollama y LM Studio gestionan los modelos cuantificados de forma nativa, por lo que no es necesario que realices ninguna conversión por tu cuenta. Solo tienes que elegir el nivel de cuantificación que se adapte a la memoria de la que dispones.

Longitud del contexto: el coste oculto de la memoria

Cada unidad de contexto (el texto que se envía al modelo más el texto que este genera) requiere memoria adicional, además de los propios pesos del modelo. Las conversaciones breves no suponen ningún problema, pero si se introducen documentos largos o se mantienen historiales de chat extensos, la memoria de contexto puede aumentar rápidamente.

A modo de referencia aproximada, 8 000 tokens de contexto añaden aproximadamente 1 GB por cada 10 000 millones de parámetros. Si aumentas esa cifra a 32 000 tokens, el aumento es de unos 4 GB. Algunos modelos más recientes admiten 128 000 tokens o más, lo que puede duplicar efectivamente los requisitos totales de memoria.

Si tienes pensado utilizar contextos largos con frecuencia, por ejemplo, al introducir bases de código completas o documentos extensos en un modelo, calcula una cantidad de memoria adicional superior a la que requieren únicamente los pesos del modelo. Esta es otra razón por la que las configuraciones de 32 GB o 64 GB resultan adecuadas para un uso intensivo de la IA a nivel local.

Modelos populares y lo que necesitan

A continuación se ofrece una guía rápida de algunos de los modelos locales más utilizados en la actualidad, en la que se indica la memoria aproximada necesaria con cuantificación Q4_K_M:

- Phi-4 Mini (3,8 GHz): ~2,3 GB, funciona de maravilla en casi cualquier dispositivo

- Qwen 3.5 4B: ~3,4 GB, excelente para tareas sencillas con gran capacidad de razonamiento

- Llama 3.2 8B: ~5 GB, modelo pequeño y fiable para uso general

- Qwen 3 8B: ~5 GB, gran rendimiento en multilingüismo y razonamiento

- Qwen 3.5 9B: ~6,6 GB, el último modelo pequeño con capacidades mejoradas

- DeepSeek-R1-Distill 14B: ~9 GB, excelente capacidad de razonamiento en un tamaño compacto

- Gemma 3 12B: ~8 GB, la eficiente opción de tamaño medio de Google

- Llama 4 Scout (109B MoE, 17B activos): ~10 GB con cuantificación agresiva; la última versión de Meta funciona sorprendentemente bien gracias a la arquitectura MoE

- Qwen 3.5 27B: ~17 GB, una tarjeta muy versátil que cabe en una memoria de vídeo de 24 GB

- Qwen 3 32B: ~20 GB, gran potencia, compatible con 24 GB de VRAM

- Qwen 3.5 35B-A3B (MoE): ~24 GB; 35 000 millones en total, pero solo 3 000 millones activos por token; muy eficiente

- Llama 3.3 70B: ~42 GB, calidad casi de vanguardia, requiere una cantidad considerable de RAM

- DeepSeek-R1-Distill 70B: ~42 GB, razonamiento de primer nivel para uso local

- GPT-OSS 120B: ~63 GB; el modelo de peso abierto de OpenAI requiere más de 64 GB de RAM unificada o del sistema

- Qwen 3.5 122B-A10B (MoE): ~81 GB, modelo de gama alta con solo 10 000 millones de parámetros activos

Estas cifras corresponden únicamente a los pesos de los modelos con cuantificación Q4_K_M. Añade entre 2 y 8 GB para el contexto, la sobrecarga del sistema operativo y cualquier otra aplicación que se esté ejecutando simultáneamente. Los modelos MoE (Mixture of Experts), como Llama 4 Scout y Qwen 3.5 35B-A3B, son especialmente eficientes en cuanto al uso de memoria durante la inferencia, ya que solo una fracción de sus parámetros totales está activa por token.

Elegir la memoria adecuada para la IA local

Teniendo en cuenta todo lo anterior, a continuación te explicamos cómo plantearte la configuración de la memoria para los LLM locales:

Opta por la DDR5 si tu plataforma la admite. La ventaja en cuanto a ancho de banda con respecto a la DDR4 es real y repercute directamente en la velocidad de inferencia. La DDR5-6000 o superior ofrece el equilibrio ideal entre precio, compatibilidad y rendimiento para las cargas de trabajo de IA.

Utiliza siempre la configuración de doble canal. Dos módulos de RAM ofrecen un rendimiento significativamente superior al de un solo módulo de la misma capacidad total para la inferencia de modelos de lenguaje grande (LLM). Un kit de 2 módulos de 16 GB supera con creces a un solo módulo de 32 GB en cuanto a tokens por segundo.

El tamaño necesario para los modelos que quieras ejecutar. Si vas a experimentar principalmente con modelos de 7 000 a 8 000 millones de parámetros, con 16 GB es suficiente. Si quieres ejecutar modelos de 14 000 a 32 000 millones de parámetros o dejar margen para futuros modelos, lo mejor es contar con 32 GB. Y si tienes en mente modelos de 70 000 millones de parámetros, planifica 64 GB.

Si buscas un sistema que gestione bien los modelos de IA locales actuales y ofrezca margen de crecimiento, un kit como el CORSAIR VENGEANCE DDR5 de 64 GB (2x32 GB) a 6000 MT/s o 6400 MT/s es difícil de superar. Obtienes la capacidad necesaria para modelos grandes, el ancho de banda para una inferencia rápida y la configuración de doble canal que hace que todo funcione de manera eficiente. Si estás montando una configuración más compacta centrada en modelos más pequeños, un kit DDR5-6000 de 32 GB (2x16 GB) es un punto de partida sólido y rentable.

Diseñada específicamente para la IA local: la CORSAIR AI WORKSTATION 300

Si realmente te planteas ejecutar modelos de gran tamaño de forma local y no quieres montar una torre con varias GPU, la CORSAIR AI WORKSTATION 300 ofrece un enfoque diferente. Está basada en el procesador Ryzen AI MAX+ 395 de AMD con una GPU integrada Radeon 8060S que puede acceder a hasta 96 GB de VRAM de los 128 GB de memoria LPDDR5X-8000 del sistema. Esa capacidad es lo que la hace interesante para la IA local: una sola GPU discreta de consumo alcanza hoy en día un máximo de 32 GB de VRAM, por lo que cargar algo como GPT-OSS 120B (alrededor de 63 GB en MXFP4) en una sola tarjeta no es posible sin dividir el modelo entre varias GPU o descargarlo a la RAM del sistema.

La arquitectura de memoria unificada es la clave del equilibrio. Se renuncia al ancho de banda bruto de la VRAM GDDR7 dedicada, pero a cambio se obtienen hasta 96 GB de memoria accesible para la GPU a velocidades LPDDR5X. Esto significa que los modelos con un rango de parámetros de entre 70 000 y 120 000 millones, que de otro modo requerirían múltiples GPU discretas o una descarga considerable de la CPU, pueden ejecutarse íntegramente en la ruta de memoria de la GPU en una sola máquina, sin necesidad de dividir capas entre tarjetas ni paginar pesos a través de PCIe.

El sistema también incluye la NPU XDNA 2 de AMD, con 50 TOPS de aceleración de IA para tareas menos exigentes, Ethernet de 2,5 Gbps, Wi-Fi 6E y varios puertos USB 4.0. Para los profesionales que trabajan con datos confidenciales —ya sea en el ámbito jurídico, médico o financiero—, disponer de este nivel de capacidad de IA de forma totalmente autónoma y en las propias instalaciones supone una ventaja práctica significativa.

El conjunto de software CORSAIR AI

Instalar y configurar correctamente las herramientas de IA locales puede ser una de las partes más frustrantes del proceso: conflictos de dependencias, versiones de controladores, compatibilidad de marcos de trabajo... La suite de software CORSAIR AI es una herramienta de configuración guiada diseñada para eliminar esas dificultades. Te ayuda a elegir e instalar las herramientas adecuadas para tu sistema, desde marcos de trabajo de IA y aprendizaje automático hasta entornos de desarrollo y software creativo, todo ello adaptado a tu hardware.

JOIN OUR OFFICIAL CORSAIR COMMUNITIES

Join our official CORSAIR Communities! Whether you're new or old to PC Building, have questions about our products, or want to chat about the latest PC, tech, and gaming trends, our community is the place for you.